MindDrive 온라인 강화학습 기반 비전언어액션 모델 for 자율주행

초록

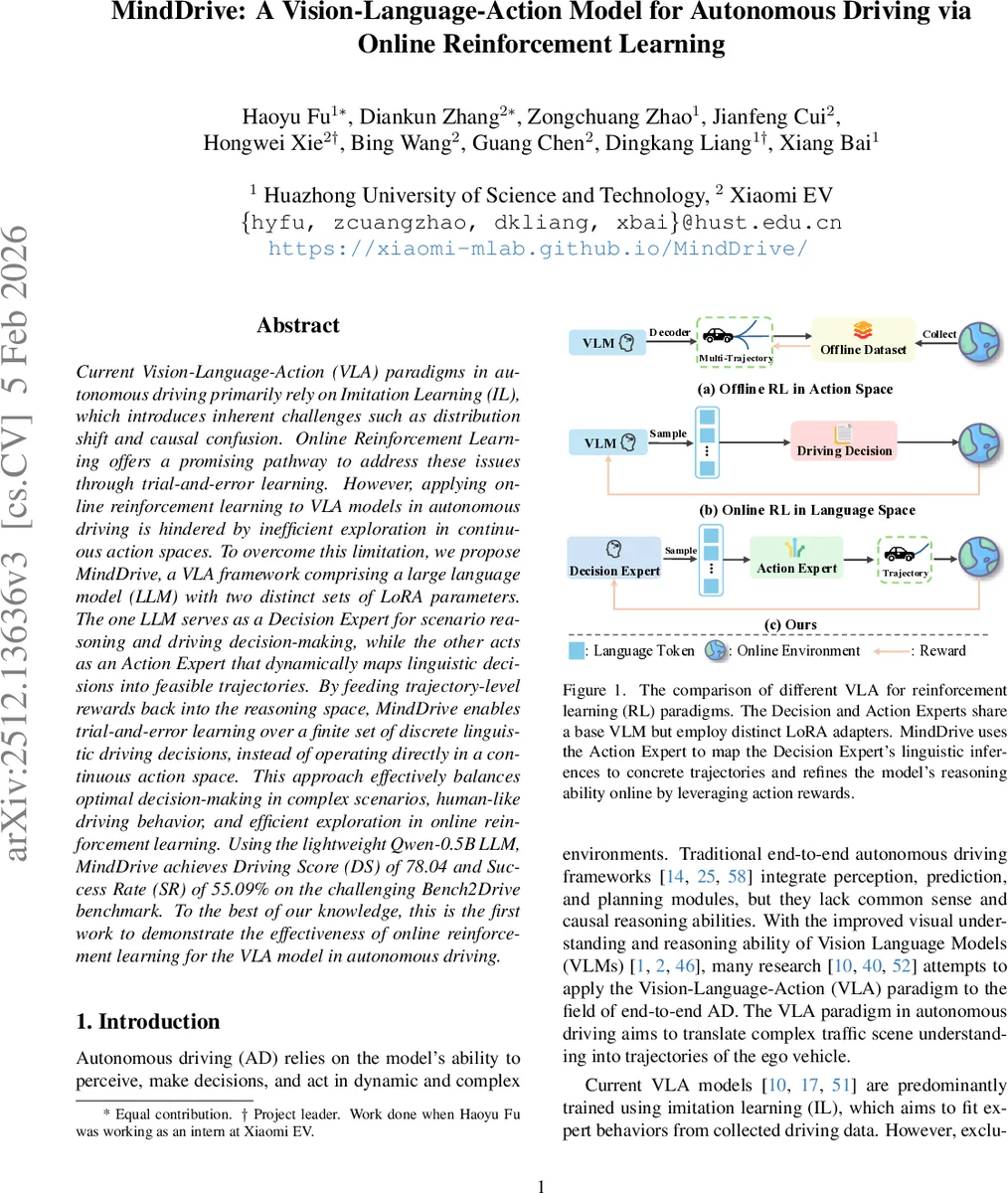

MindDrive는 대형 언어 모델(LLM)에 두 개의 LoRA 어댑터를 부착해 ‘결정 전문가’와 ‘행동 전문가’로 구분한다. 결정 전문가는 언어 기반 메타‑액션을 생성하고, 행동 전문가는 이를 연속적인 차량 궤적으로 변환한다. 초기에는 모방 학습으로 메타‑액션과 궤적을 1:1 매핑하고, 이후 시뮬레이터 환경에서 온라인 강화학습을 수행해 메타‑액션에 대한 보상을 피드백한다. 이 설계는 연속 행동 공간에서의 비효율적 탐색을 언어 공간으로 축소해 탐색 효율성을 크게 높이며, 0.5 B 규모 Qwen 모델을 사용해 Bench2Drive 벤치마크에서 DS 78.04, SR 55.09 %를 달성한다.

상세 분석

본 논문은 자율주행 분야에서 비전‑언어‑액션(VLA) 패러다임이 기존에 모방학습(IL)에 과도하게 의존함으로써 발생하는 분포 이동(distribution shift)과 인과 혼란(causal confusion) 문제를 온라인 강화학습(online RL)으로 해결하고자 한다. 핵심 아이디어는 연속적인 궤적(action) 공간을 직접 탐색하는 대신, 언어 기반 메타‑액션이라는 이산적인 결정(decision) 공간으로 탐색 범위를 축소하는 것이다. 이를 위해 저자들은 동일한 베이스 LLM에 두 개의 LoRA 파라미터 집합을 각각 부착한다. 첫 번째 LoRA는 ‘Decision Expert’ 역할을 수행해 현재 시각·언어 입력을 바탕으로 “좌회전”, “속도 감소” 등 고수준 메타‑액션을 생성한다. 두 번째 LoRA는 ‘Action Expert’ 역할을 맡아, Decision Expert가 만든 메타‑액션을 구체적인 속도·경로 웨이포인트 시퀀스로 매핑한다.

학습 단계는 크게 두 단계로 나뉜다. 1) 모방학습 단계에서는 전문가 데이터셋을 이용해 메타‑액션과 실제 궤적 사이의 1:1 대응을 학습한다. 이 과정에서 언어‑액션 매핑을 확보함으로써 온라인 RL에서 탐색할 후보 행동 집합을 고품질로 제한한다. 2) 온라인 강화학습 단계에서는 CARLA 시뮬레이터와의 폐쇄‑루프 상호작용을 통해 메타‑액션에 대한 보상을 직접 수집한다. 보상은 주행 성공·실패, 충돌 여부, 규칙 위반 등으로 정의되며, 이러한 신호는 Decision Expert의 정책 파라미터(LoRA) 업데이트에 사용된다. 즉, 행동 전문가가 제공하는 연속 궤적의 질이 언어 기반 의사결정의 학습 신호가 된다.

MDP 설계는 상태 sₜ를 ‘scene token’으로 압축해 메모리 오버헤드를 최소화하고, 대규모 배치 학습을 가능하게 한다. 정책 π_d는 메타‑액션 선택 확률을, π_g는 행동 전문가가 생성하는 궤적 분포를 의미한다. 최적화 목표는 기대 누적 할인 보상 J(θ)=E_{τ∼π_d}

댓글 및 학술 토론

Loading comments...

의견 남기기