RefAM 제로샷 지시 분할을 위한 주의력 마그넷

초록

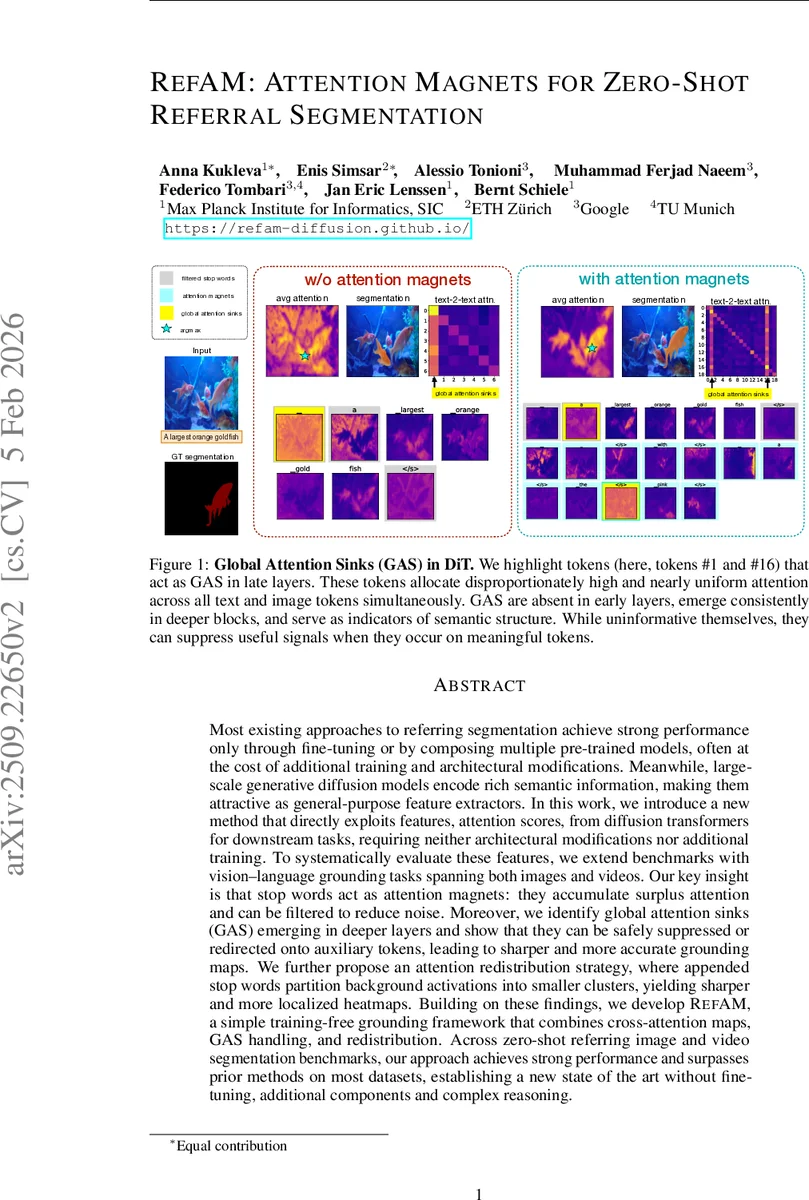

RefAM은 사전 학습된 확산 트랜스포머(DiT)의 교차‑주의 맵을 그대로 활용해 별도의 파인튜닝 없이 이미지·비디오 지시 분할을 수행한다. 핵심 아이디어는 “불용어(stop‑word)”가 과도한 주의를 끌어 모으는 ‘주의력 마그넷’ 역할을 한다는 점을 이용해, 이들을 추가·필터링함으로써 배경 잡음을 분산시키고, 깊은 층에서 나타나는 전역 주의 싱크(GAS)를 억제한다. 이렇게 정제된 주의 맵을 SAM·SAM2와 결합해 최종 마스크를 생성한다. 실험 결과, RefAM은 기존 제로샷 방법들을 대부분 능가하며, 추가 학습이나 복잡한 구조 없이도 강력한 성능을 보여준다.

상세 분석

본 논문은 대규모 텍스트‑이미지 확산 모델인 DiT가 내부적으로 생성하는 교차‑주의(attention) 정보를 직접 활용한다는 점에서 혁신적이다. 기존의 지시 분할 방법들은 보통 CLIP 기반 특징을 추출하거나, 사전 학습된 이미지 분할 모델(SAM 등)을 별도로 파인튜닝하거나 복합적으로 결합하는 방식을 취한다. 반면 RefAM은 DiT의 텍스트‑이미지 교차‑주의 맵을 그대로 사용함으로써, 별도의 파라미터 업데이트 없이도 의미론적 정렬 정보를 얻는다.

핵심 통찰은 두 가지 현상이다. 첫째, ‘불용어’가 주의력 마그넷으로 작동한다는 점이다. 자연어 토큰 중 의미가 거의 없는 “a”, “the”, “with” 등은 DiT의 소프트맥스 정규화 과정에서 과도한 주의 가중치를 받는다. 이 현상을 부정적인 잡음으로 보기보다, 의도적으로 활용한다. 논문에서는 입력 문장에 추가적인 불용어 토큰을 삽입해 배경 영역에 분산된 주의를 이 토큰들에 몰아넣고, 이후 집계 단계에서 해당 토큰들의 주의 맵을 제외한다. 결과적으로 배경 잡음이 감소하고, 대상 객체에 대한 주의 집중도가 높아진다.

둘째, 깊은 층에서 나타나는 전역 주의 싱크(Global Attention Sinks, GAS)이다. 특정 토큰(주로 불용어 혹은 종료 토큰)이 텍스트와 이미지 토큰 전체에 거의 균일하게 높은 주의를 할당한다. 이러한 토큰은 의미적 정보를 전달하지 않으며, 오히려 다른 유용한 토큰들의 주의 가중치를 잠식한다. 저자들은 GAS를 자동 탐지하고, 해당 토큰의 주의 채널을 억제하거나 보조 토큰으로 리다이렉션함으로써, 보다 선명하고 정확한 히트맵을 얻는다.

기술적인 구현은 크게 세 단계로 구성된다. (1) DiT의 여러 레이어와 헤드에서 교차‑주의 맵 M(k)를 추출하고, (2) 사전에 정의된 불용어 집합 S_stop과 추가 삽입된 불용어 토큰을 필터링해 남은 맵을 평균·합산해 히트맵 H_e를 만든다. 여기서 GAS 토큰이 감지되면 해당 채널을 0으로 마스킹하거나 보조 토큰에 재분배한다. (3) 얻어진 히트맵에서 argmax 위치를 추출하고, 이를 SAM 혹은 SAM2에 전달해 최종 세그멘테이션 마스크를 생성한다.

실험에서는 이미지 기반 Referring Image Object Segmentation(RIOS)과 비디오 기반 Referring Video Object Segmentation(RVOS) 두 벤치마크 모두에서 평가하였다. 특히 비디오에서는 첫 프레임에서 얻은 좌표를 SAM2에 전달해 시계열 전파를 수행했으며, 이는 별도의 시계열 모델 없이도 높은 일관성을 보였다. Ablation study를 통해 (i) 불용어 삽입 없이 기존 토큰만 사용했을 때보다 평균 IoU가 3~5% 상승하고, (ii) GAS 억제 없이 전체 토큰을 사용했을 때보다 잡음이 크게 증가함을 확인했다. 또한 60% 이하의 레이어를 필터링해도 성능 저하가 없으며, 이는 DiT 초기 레이어가 의미적 정보를 거의 제공하지 않음을 시사한다.

결과적으로 RefAM은 “학습‑프리” 접근법임에도 불구하고, 기존 파인튜닝 기반 혹은 복합 모델 기반 제로샷 방법들을 대부분 능가한다. 이는 대규모 확산 모델이 내재하고 있는 풍부한 의미 정보를 적절히 정제·재분배함으로써 가능해진다. 앞으로는 다양한 멀티모달 태스크에 동일한 주의력 마그넷 전략을 적용하거나, 자동으로 최적의 불용어 집합을 탐색하는 연구가 이어질 것으로 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기