인버스 강화학습과 맘바‑그래프를 활용한 일반화 가능한 궤적 예측

초록

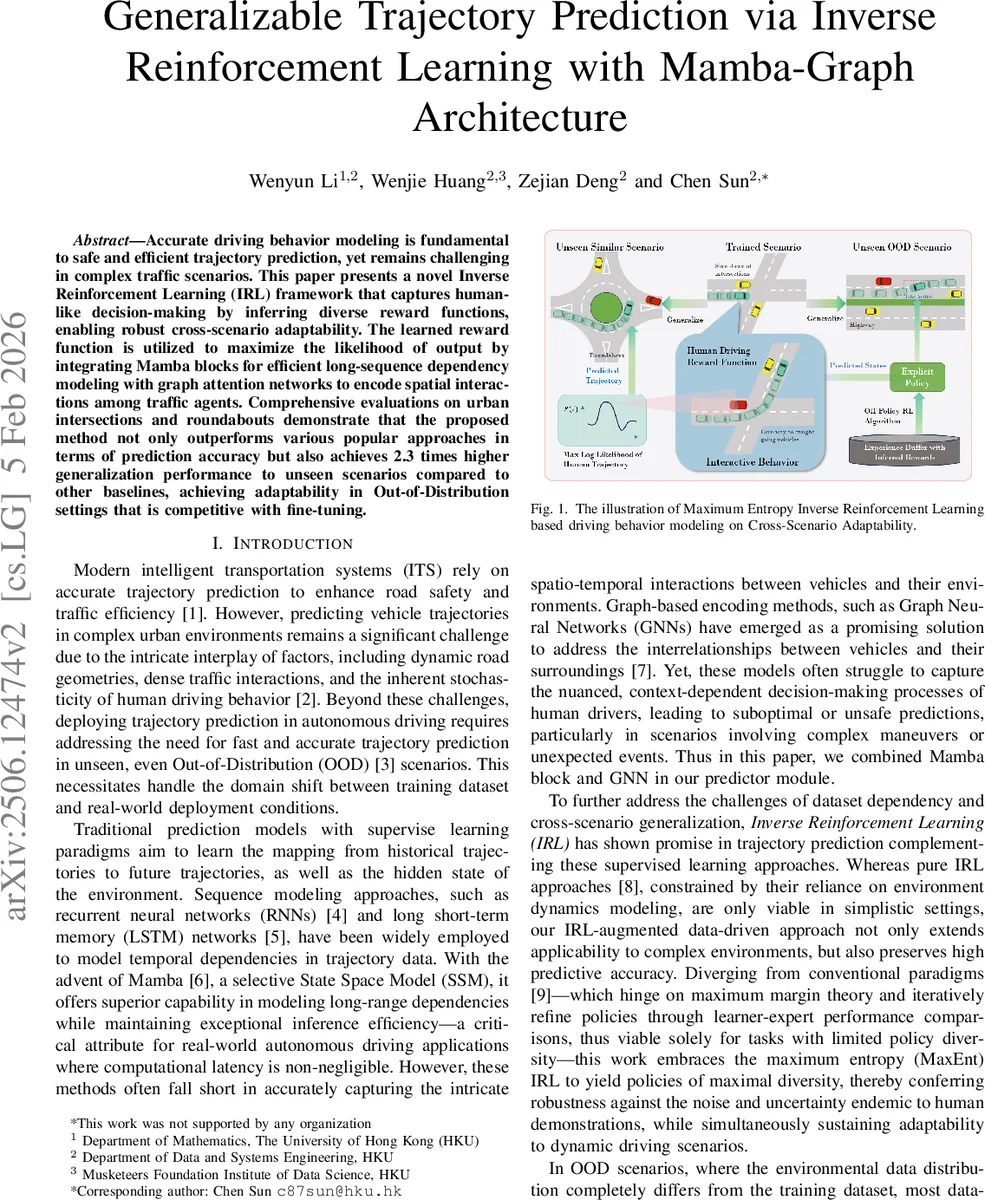

본 논문은 맘바 블록과 그래프 어텐션 네트워크를 결합한 인버스 강화학습(IRL) 프레임워크를 제안한다. 최대 엔트로피 IRL을 통해 인간 운전자의 보상 함수를 학습하고, 이를 맘바 기반 디코더와 그래프 인코더에 통합해 장거리 시계열 의존성과 차량 간 상호작용을 동시에 모델링한다. 실험 결과, 도시 교차로와 원형교차로에서 기존 방법들을 크게 앞서며, 미보인 시나리오에 대해 2.3배 향상된 일반화 성능을 보인다.

상세 분석

이 연구는 세 가지 핵심 기술을 유기적으로 결합한다. 첫째, 맘바(Mamba) 블록은 선택적 상태공간 모델(SSM)을 기반으로 한 최신 시퀀스 모델로, 긴 시계열을 효율적으로 처리하면서도 추론 지연을 최소화한다. 기존 RNN/LSTM 대비 선형 시간 복잡도와 뛰어난 장기 의존성 포착 능력을 제공한다는 점에서 자율주행 차량의 실시간 요구에 부합한다. 둘째, 그래프 어텐션 네트워크(GAT)는 각 차량을 노드, 차량 간 거리·속도·방향 등 관계를 엣지 특성으로 표현해 공간적 상호작용을 정교히 인코딩한다. 어텐션 가중치는 주변 차량의 중요도를 동적으로 조정하므로, 급격한 차선 변경이나 교차로 진입 같은 복잡한 상황에서도 의미 있는 컨텍스트를 추출한다. 셋째, 최대 엔트로피(Inverse Reinforcement Learning, MaxEnt IRL) 모듈은 인간 운전 데이터로부터 보상 함수를 학습한다. 보상 함수는 신경망으로 파라미터화돼 비선형 특성을 포착하고, 로그우도 손실에 L2 정규화를 추가해 과적합을 억제한다. 학습된 보상은 두 가지 방식으로 활용된다. (1) TPM(Trajectory Prediction Module)의 손실에 보상 로그우도를 가중치로 포함시켜, 예측 궤적이 인간 시연과 확률적으로 일치하도록 유도한다. (2) OOD(Out‑of‑Distribution) 상황에서는 별도 정책 네트워크(Actor‑Critic, TD3)를 학습해 보상 함수를 강화학습 보상으로 사용함으로써, 실제 도메인 전이 없이도 인간‑유사 정책을 재현한다.

알고리즘 1은 전체 학습 파이프라인을 요약한다. 인코더(GRU+GAT)에서 얻은 잠재 표현 h_L을 맘바 디코더에 전달해 미래 상태를 순차적으로 생성하고, 동시에 보상 네트워크를 통해 궤적 로그우도를 계산한다. 손실 L_TPM은 MSE와 −γ·E

댓글 및 학술 토론

Loading comments...

의견 남기기