블록 수준 임베딩과 Topk 상호작용 정제로 효율적인 장문 문서 재랭킹

초록

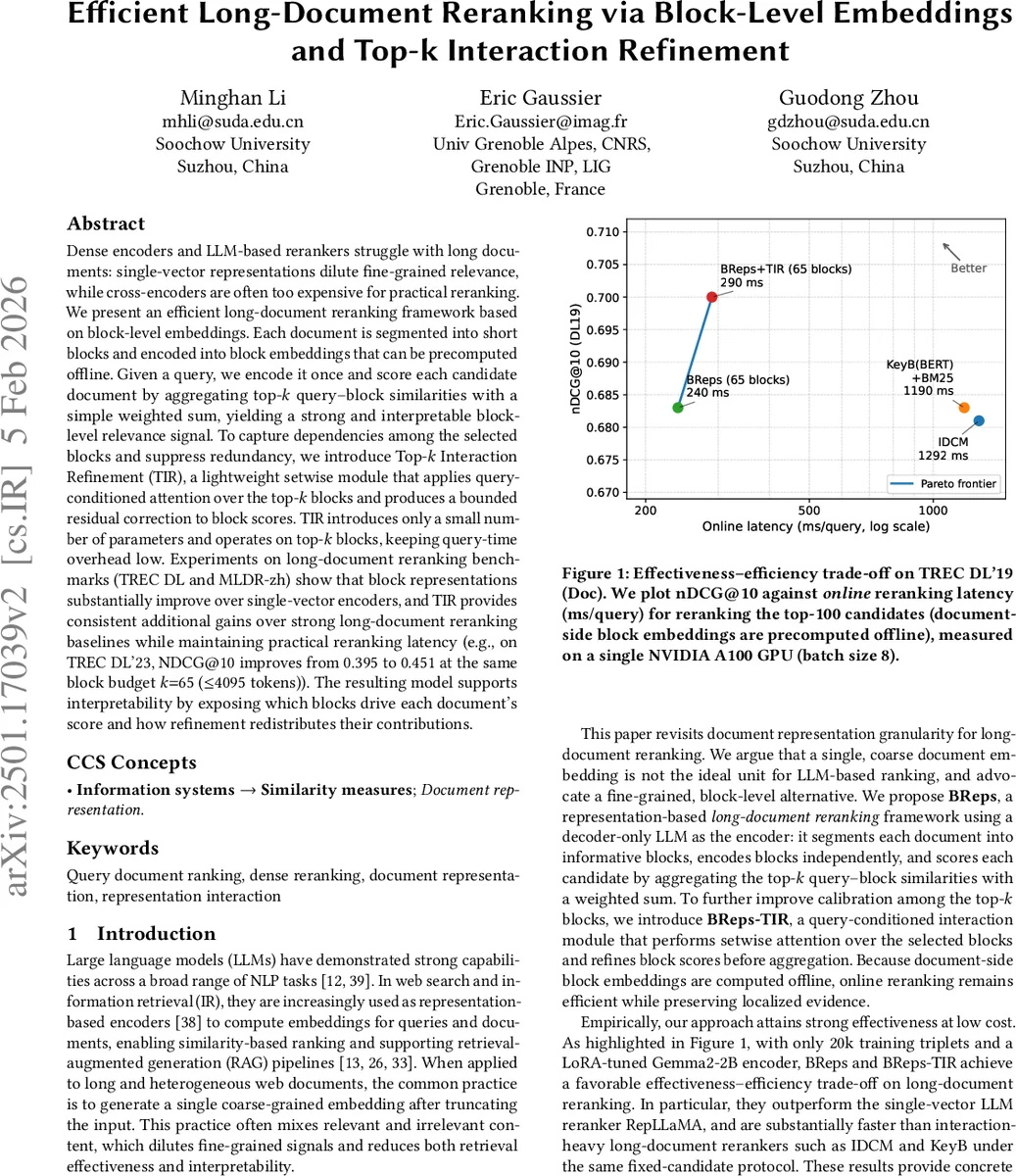

본 논문은 긴 문서를 블록 단위로 나누어 사전 계산된 블록 임베딩을 활용하고, 질의와 블록 간의 상위 k 유사도 합산으로 초기 점수를 산출한다. 이후 가벼운 Topk Interaction Refinement(TIR) 모듈이 질의‑조건부 어텐션을 적용해 선택된 블록 간 중복을 억제하고 보완성을 강화함으로써 점수를 정제한다. 실험 결과, TIR을 적용한 BReps‑TIR는 기존 단일 벡터 기반 재랭커와 무거운 크로스‑인코더 대비 높은 NDCG@10을 유지하면서 추론 지연을 크게 낮춘다.

상세 분석

이 연구는 장문 문서 재랭킹에서 발생하는 두 가지 근본적인 문제—‘세밀한 관련성 손실’과 ‘연산 비용 폭증’—에 대한 실용적인 해결책을 제시한다. 첫 번째 단계인 블록 수준 임베딩(BReps)은 문서를 63 토큰 이하의 짧은 블록으로 동적 프로그래밍 기반 CogLTX 알고리즘으로 분할하고, 동일한 디코더‑전용 LLM(Gemma2‑2B에 LoRA 튜닝)을 이용해 각 블록을 독립적으로 인코딩한다. 이렇게 얻어진 블록 벡터는 오프라인에서 미리 계산·인덱싱되므로 온라인 단계에서는 질의 벡터 하나만 생성하면 된다.

질의와 블록 간 코사인 유사도를 계산해 각 블록에 초기 점수를 부여하고, 상위 k 블록(예: k=65)만을 선택한다. 선택된 블록은 가중치가 감소하는 선형 혹은 학습 가능한 가중치 벡터 W 와 곱해져 문서 수준 점수 S₍q,d₎ 를 산출한다. 이 방식은 단일 벡터가 전체 문서를 압축하는 기존 방법에 비해 세밀한 증거를 보존하고, 블록별 기여도를 직관적으로 해석할 수 있다는 장점을 갖는다.

하지만 단순 가중합은 (i) 동일한 내용이 여러 블록에 중복될 경우 점수를 과대평가하고, (ii) 서로 다른 쿼리 측면을 각각 약하게 다루는 블록들의 조합 효과를 놓치는 문제를 안고 있다. 이를 보완하기 위해 제안된 Top‑k Interaction Refinement(TIR)는 선택된 k 블록에 대해 질의‑조건부 단일 헤드 어텐션을 수행한다. 어텐션 가중치 α 를 통해 블록들의 컨텍스트 c 를 집계하고, 질의 q′, 블록 b′ᵢ, 컨텍스트 c′ 를 동일 차원 d ( d ≪ H) 로 투영한다. 이후 tanh 활성화와 스케일 γ 를 이용해 각 블록에 잔차 δ 를 계산하고, 원래 점수 s 에 더해 정제된 점수 s′ 를 만든다. 이 과정은 파라미터가 수천 개에 불과해 추론 비용이 미미하며, 오직 k 블록에만 적용되므로 메모리와 시간 복잡도가 선형적으로 제한된다.

실험에서는 TREC DL 2023·2022·2021 및 중국어 MLDR‑zh 벤치마크를 사용했으며, 동일 k 조건에서 BReps‑TIR이 기존 단일‑벡터 LLM 재랭커(RepLLaMA)보다 NDCG@10을 0.395→0.451까지 상승시켰다. 또한 IDCM·KeyB와 같은 무거운 상호작용 기반 모델보다 34배 빠른 온라인 지연(≈ 290 ms vs ≈ 1200 ms)을 기록했다. Ablation 연구에서는 블록 수 n, k 값, 가중치 W 학습 여부, TIR의 어텐션 헤드 수 등을 변형했을 때 성능 변동을 분석했으며, 특히 k 값이 4080 사이에서 가장 안정적인 향상을 보였다.

전반적으로 이 논문은 (1) 블록 수준 임베딩으로 장문 문서의 세밀한 증거를 보존, (2) 경량화된 집합‑상호작용 모듈(TIR)로 점수 보정, (3) 오프라인·온라인 연산을 명확히 분리해 실시간 서비스에 적합한 효율‑정확도 균형을 달성한다는 점에서 장문 IR 분야에 실용적인 기여를 한다.

댓글 및 학술 토론

Loading comments...

의견 남기기