듀얼리티 모델: 한 단계 생성의 새로운 패러다임

초록

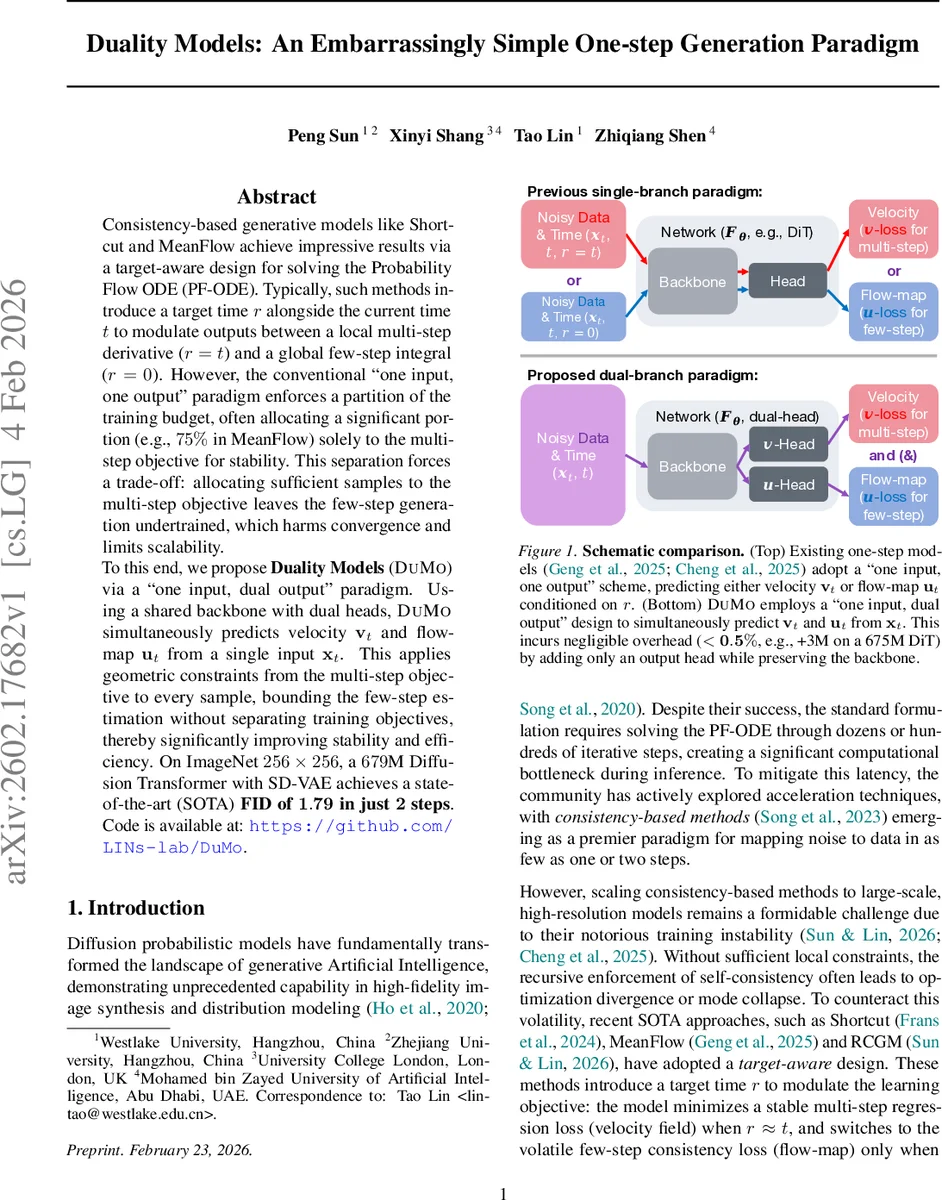

본 논문은 기존의 “하나의 입력, 하나의 출력” 구조가 훈련 샘플을 다중‑스텝(속도)와 소수‑스텝(플로우) 목표에 나누어 할당함으로써 발생하는 효율성 한계를 지적한다. 이를 해결하기 위해 저자들은 공유 백본에 두 개의 헤드를 추가해 하나의 노이즈 입력으로부터 즉시 속도 vₜ와 플로우‑맵 uₜ를 동시에 예측하는 “하나의 입력, 두 개의 출력” 듀얼‑브랜치 구조인 Duality Models(DuMo)를 제안한다. 속도 손실은 물리적 안정성을, 플로우 손실은 빠른 샘플링을 각각 담당하며, 두 손실을 하나의 네트워크에서 동시에 최적화함으로써 훈련 효율과 생성 품질을 크게 향상시킨다. ImageNet‑256 × 256에서 679M DiT 모델이 2스텝만으로 FID 1.79를 달성해 현존 최고 성능을 기록한다.

상세 분석

DuMo는 기존 Consistency 기반 모델이 도입한 목표 시간 r(=t 또는 0)이라는 스위칭 메커니즘을 완전히 폐기하고, 입력 xₜ에 대해 두 개의 출력 vₜ와 uₜ를 동시에 생성한다는 점에서 근본적인 설계 변화를 제시한다. 속도 vₜ는 PF‑ODE의 미분 형태인 dxₜ/dt 를 직접 회귀하도록 설계되어, L₂ 기반의 로컬 손실 Lᵥ가 매우 안정적인 학습 신호를 제공한다. 반면 플로우‑맵 uₜ는 현재 시점에서 데이터 x₀ 까지의 직선 벡터를 예측하도록 정의되며, 일관성 손실 Lᵤ는 자기‑부트스트랩 방식으로 미래 예측과 현재 예측을 정합시키는 형태다. 두 손실을 가중치 β 로 선형 결합한 L = βLᵥ + (1‑β)Lᵤ는 기존 단일 브랜치에서 발생하던 “속도 비율 ρ”에 의한 데이터 부족 문제를 해소한다. 즉, 모든 학습 샘플이 두 목표 모두에 대해 지도 신호를 받으므로, ρ ≈ 0.8에서 관측된 최적점과 달리 별도의 샘플 분할 없이도 안정성과 효율성을 동시에 달성한다.

구조적으로는 기존 DiT와 같은 대형 트랜스포머 백본에 헤드 하나만 추가하면 되며, 파라미터 증가율은 0.5 % 미만에 불과하다. 이는 모델 용량을 크게 늘리지 않으면서도 두 출력 간의 상호 보완적 그래디언트를 제공한다는 점에서 실용적이다. 또한 β 값에 대한 민감도 실험에서 0.3~0.7 구간이 넓게 허용됨을 확인했으며, 이는 훈련 스케줄이나 배치 크기에 크게 의존하지 않는 강건성을 의미한다.

시간 샘플링은 베타 분포 t ∼ Beta(θ₁, θ₂) 를 이용해 노이즈 레벨을 조절하고, 가이드 스케일 ζ 를 적용해 조건부 생성 성능을 향상시킨다. 이러한 설계는 기존 MeanFlow가 75 % 이상의 샘플을 속도 손실에 할당해야 했던 점과 대비돼, DuMo는 동일한 샘플 수로도 플로우‑맵 학습을 충분히 수행한다. 실험 결과는 ImageNet‑256 × 256에서 2‑step 샘플링으로 FID 1.79, IS ≈ 300을 달성했으며, 이는 동일 규모의 Diffusion Transformer가 50‑step 이상을 필요로 하던 기존 최첨단 모델들을 크게 앞선다.

요약하면, DuMo는 물리적 일관성을 보장하는 로컬 속도 회귀와, 빠른 샘플링을 위한 글로벌 플로우‑맵 학습을 하나의 네트워크 안에서 동시에 최적화함으로써, 훈련 효율, 모델 안정성, 그리고 최종 이미지 품질 모두에서 기존 방법들을 능가한다.

댓글 및 학술 토론

Loading comments...

의견 남기기