음악 소스 복원을 위한 순차 BS RoFormer 시스템

초록

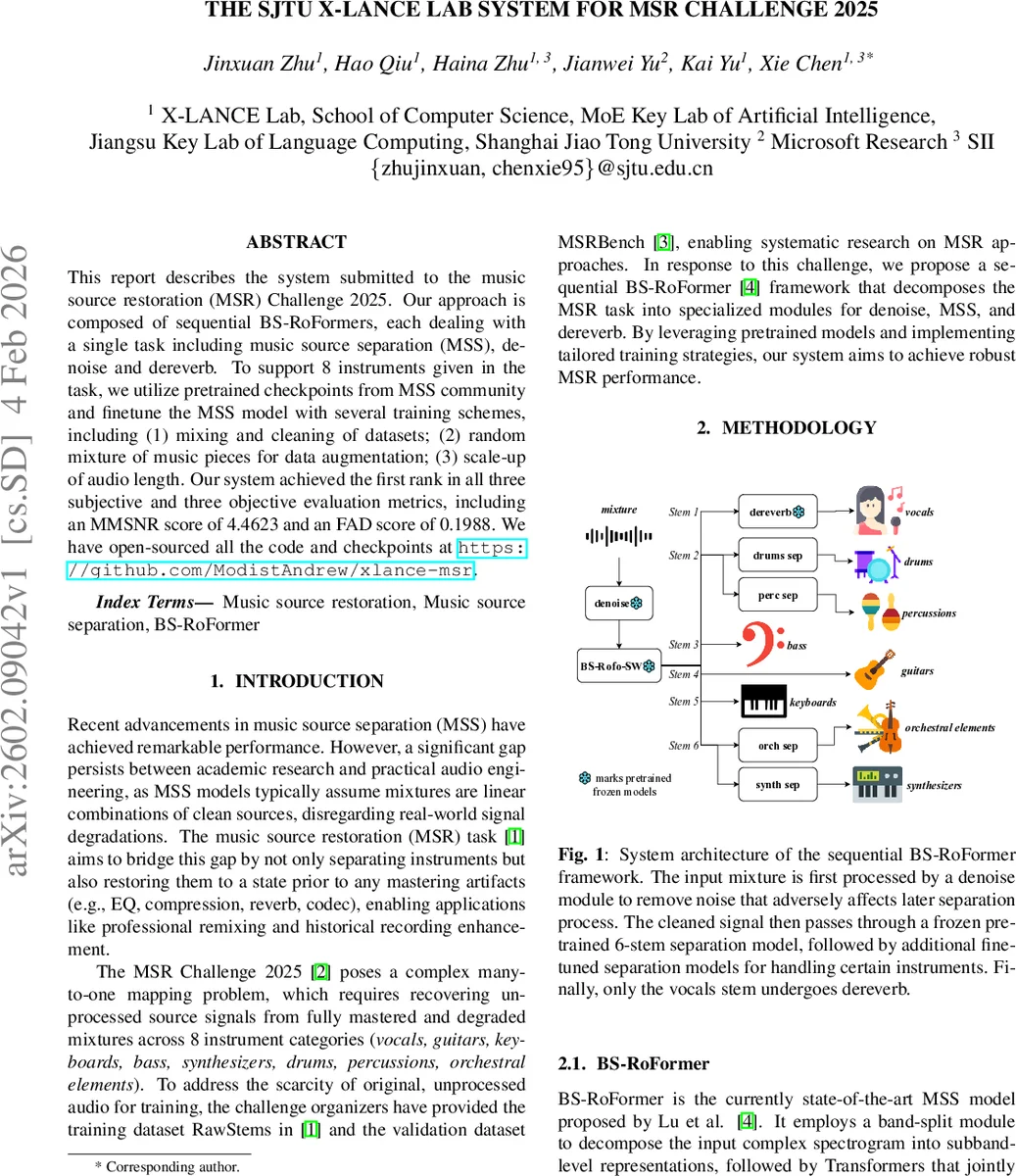

본 논문은 음악 마스터링 및 잡음·리버브와 같은 실세계 왜곡을 복원하면서 8가지 악기를 분리하는 MSR Challenge 2025용 시스템을 제안한다. 사전학습된 BS‑RoFormer 기반의 denoise‑separate‑dereverb 파이프라인을 구축하고, 데이터 정제·랜덤 믹스·길이 확대 등 세 가지 학습 전략을 적용해 성능을 극대화하였다. 객관·주관 지표 모두 1위에 오르며 MMSNR 4.4623, FAD 0.1988을 기록하였다.

상세 분석

이 시스템은 기존 음악 소스 분리(MSS) 모델이 가정하는 선형 혼합과는 달리, 마스터링 과정에서 발생하는 잡음, 압축, 이퀄라이징, 리버브 등을 동시에 복원하는 복합 과제를 해결한다는 점에서 의미가 크다. 핵심 아키텍처는 순차적인 BS‑RoFormer 모듈 3개(denoise, MSS, dereverb)로 구성되며, 각 모듈은 전용 사전학습 체크포인트를 활용한다. 특히 MSS 단계에서는 공개된 6‑stem BS‑RoFo‑SW 모델을 frozen 상태로 사용하고, drums와 other 스템을 다시 세분화해 synthesizer, percussion, orchestral 등 4개의 세부 스템으로 분리하도록 추가 파인튜닝 모델을 학습한다. 이는 “밴드‑스플릿” 구조가 각 주파수 대역을 독립적으로 처리하면서도 Transformer 기반의 장기 의존성을 모델링해 고품질 마스크를 생성할 수 있다는 장점을 그대로 살린 설계이다.

학습 전략 측면에서는 (1) RawStems와 MoisesDB를 결합해 라벨 오류를 정제하고 데이터 양을 확대했으며, (2) 서로 다른 곡의 스템을 임의로 혼합해 합성 믹스를 생성해 데이터 다양성을 높였다. (3) 학습 세그먼트 길이를 3초에서 최대 10초까지 확장해 장시간 컨텍스트를 학습하도록 함으로써 리버브와 같은 시간적 효과를 더 정확히 모델링하도록 했다. 이러한 전략은 특히 리버브가 긴 시간에 걸쳐 퍼지는 특성 때문에 큰 효과를 발휘한다.

손실 함수는 L1 손실과 다해상도 STFT 손실을 결합해 스펙트로그램과 파형 양쪽에서 정밀도를 확보했으며, NVIDIA H200 GPU에서 배치 사이즈 4, 200k 이상 스텝을 수행해 충분히 수렴시켰다. 검증 단계에서는 DT0 서브셋을 이용해 세 가지 설정(Base‑3s, Large‑10s, Large+Random) 중 성능 차이가 미미함을 확인하고, 최종적으로는 FAD 기준으로 가장 좋은 설정을 선택해 각 스템별로 최적의 모델을 조합하였다.

실험 결과는 객관 지표(MMSNR, Zimt, FAD)와 주관 지표(MOS) 모두에서 기존 팀들을 크게 앞섰으며, 특히 FAD 0.1988이라는 낮은 값은 복원된 오디오가 원본에 근접함을 의미한다. 다만 논문에서 언급한 바와 같이 현재 챌린지는 주로 분리 성능에 초점을 맞추고 있어, 진정한 복원 품질(예: 톤 컬러, 다이내믹스 재현) 평가가 부족하다는 한계가 있다. 향후 연구에서는 악기별 복원 품질을 정량화할 수 있는 새로운 메트릭과, 더 많은 실세계 마스터링 변형을 포함한 데이터셋이 필요할 것이다.

댓글 및 학술 토론

Loading comments...

의견 남기기