실시간 시점 시선 추정을 위한 자동회귀 트랜스포머 ARGaze

초록

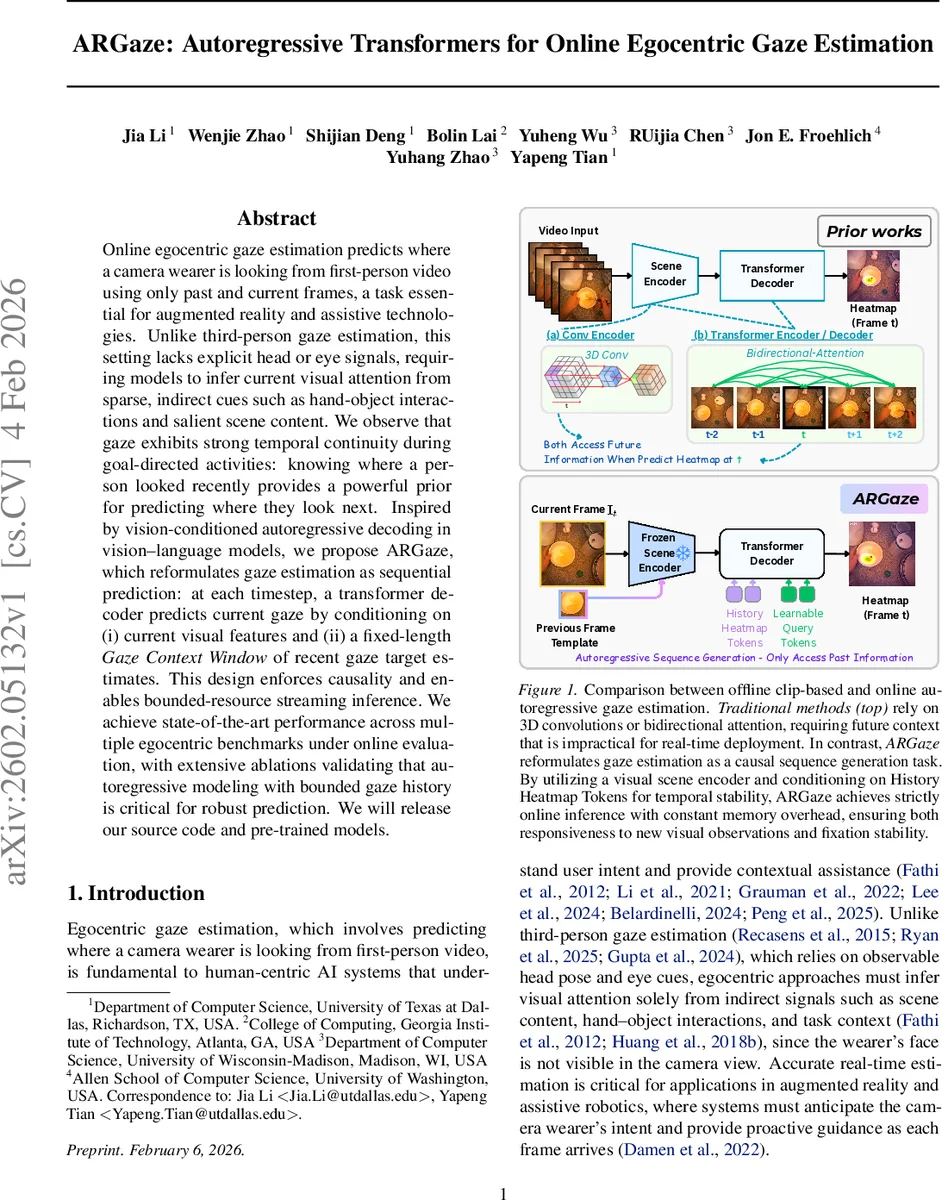

ARGaze는 첫인칭 영상에서 과거와 현재 프레임만을 이용해 실시간으로 시선 위치를 예측한다. 시선의 연속성을 활용해 최근의 시선 히스토리를 고정 길이 컨텍스트 윈도우로 토큰화하고, 현재 영상 특징과 함께 트랜스포머 디코더에 입력한다. 인과성을 보장하면서 메모리 사용량을 일정하게 유지하고, 기존 오프라인·양방향 모델 대비 정확도와 속도에서 우수한 성능을 보인다.

상세 분석

ARGaze는 egocentric gaze estimation을 “시선 히스토리 + 현재 프레임”이라는 조건부 확률 p(Hₜ | Iₜ, Hₜ₋ₖ:ₜ₋₁) 로 명시적으로 모델링한다. 핵심 아이디어는 인간의 시선이 목표‑지향 행동 중 강한 시간적 연속성을 보인다는 관찰에서 출발한다. 이를 위해 저자는 두 가지 주요 모듈을 설계했다. 첫 번째는 DINOv3 기반의 Scene Encoder로, 현재 프레임 Iₜ와 과거 프레임에서 추출한 Tracking‑aware Template(이전 시선 좌표를 중심으로 고해상도 크롭) 를 각각 다중 스케일 피처로 변환하고, 동일 차원 dₘₒ𝚍ₑ𝚕 로 투영한다. 두 번째는 Autoregressive Heatmap Tokenizer이다. 과거 히트맵 Hₜ₋ᵢ (i=1…k)를 bilinear down‑sampling 후 1×1 Conv 로 dₘₒ𝚍ₑ𝚕 차원에 매핑하고, 토큰화된 시퀀스에 Temporal Embedding과 Token‑type Embedding을 더한다. 이렇게 만든 히스토리 토큰과 현재 프레임 토큰을 Causal Transformer Decoder에 입력하면, 마스크된 self‑attention 으로 과거 정보 간 상호작용을 제한하고, cross‑attention 으로 시각적 컨텍스트와 결합한다. 디코더는 고정된 K‑size 윈도우만을 사용하므로 메모리 사용량이 O(K) 로 일정하고, 인과성을 위배하지 않는다. 마지막 Spatial Reconstruction Head는 디코더 출력 토큰을 Conv‑Transpose 로 복원해 2D 시선 히트맵 Hₜ 를 생성한다. 학습은 L₂ 손실과 함께 히트맵 정규화 KL‑divergence 를 결합해 정밀도와 안정성을 동시에 최적화한다. 실험에서는 EPIC‑KITCHENS, GTEA‑Gaze, EGTEA‑Gaze 등 세 벤치마크에서 평균 F1 점수가 1.40 % 상승하고, 추론 속도가 1.82 × 빨라졌다. Ablation study는 (1) 히스토리 토큰 없이 단일 프레임 입력 시 성능 급락, (2) 윈도우 크기 K가 3~5 사이에서 최적, (3) Tracking‑aware Template이 급격한 ego‑motion 상황에서 시선 안정성을 크게 향상시킴을 보여준다. 전체적으로 ARGaze는 인과성을 유지하면서도 인간 시선의 연속성을 효과적으로 활용하는 설계가 실시간 착용형 AR/assistive 시스템에 적합함을 입증한다.

댓글 및 학술 토론

Loading comments...

의견 남기기