LLM 강화학습에서 신뢰 영역 재고찰 비율 클리핑의 한계와 DPPO 제안

초록

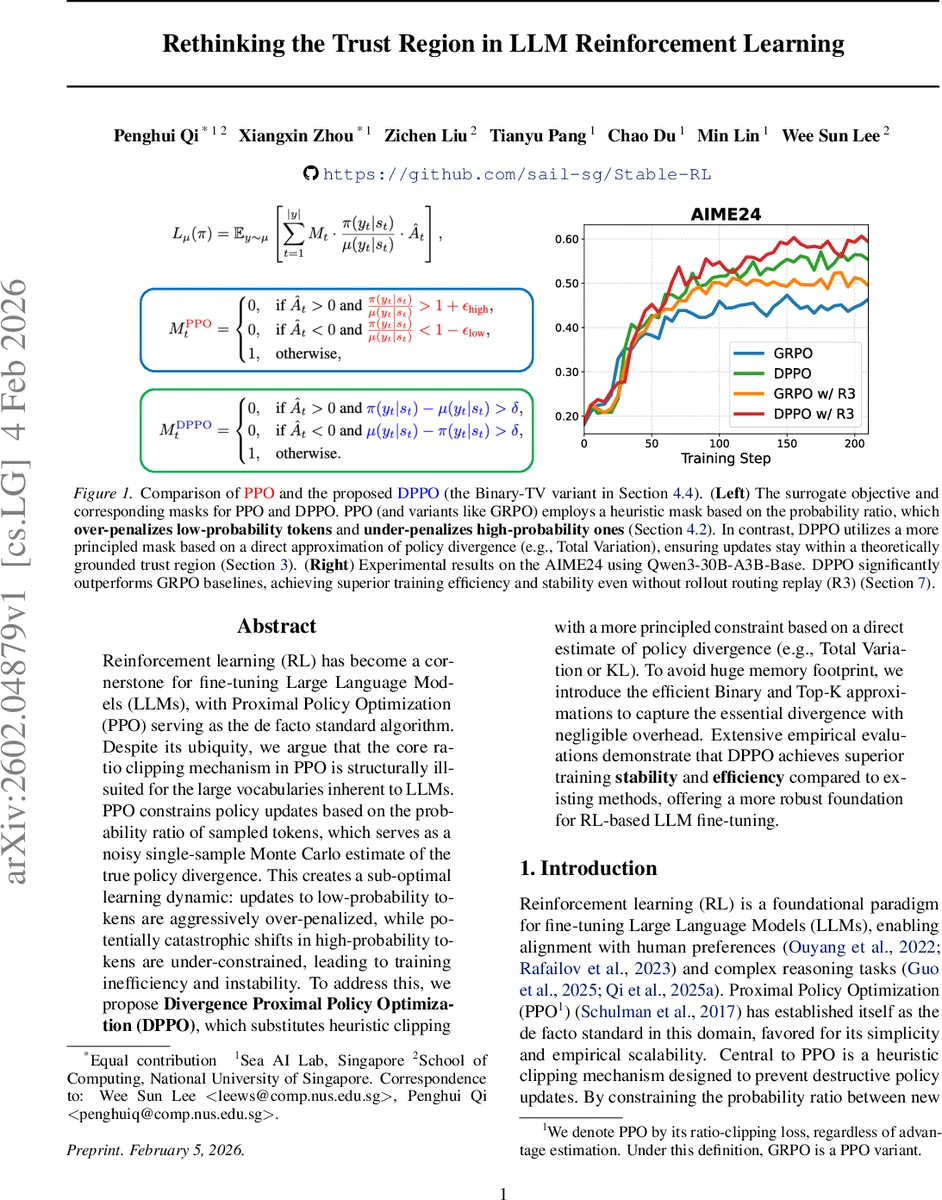

본 논문은 대규모 언어 모델(LLM) 파인튜닝에 널리 사용되는 PPO의 비율 클리핑이 어휘 규모와 확률 분포의 특성 때문에 정책 발산을 정확히 제어하지 못함을 지적한다. 저자는 정책 발산(KL·TV)을 직접 추정하는 제약으로 교체한 Divergence Proximal Policy Optimization(DPPO)를 제안하고, 메모리 효율을 위한 Binary 및 Top‑K 근사법을 도입한다. 실험 결과 DPPO가 기존 PPO 및 변형들보다 학습 안정성과 효율성에서 우수함을 보인다.

상세 분석

이 논문은 PPO가 LLM 파인튜닝에 적용될 때 발생하는 근본적인 구조적 문제를 정량적으로 분석한다. PPO는 샘플링된 토큰에 대한 확률 비율 r = π(a|s)/μ(a|s) 을 기준으로 클리핑을 수행하는데, 이는 실제 정책 간의 전체 분포 발산을 추정하는 단일 샘플 몬테카를로 추정치에 불과하다. 어휘가 수십만에 달하는 LLM에서는 낮은 확률을 가진 토큰이 많으며, 이들 토큰의 비율이 작은 변화만으로도 수백 배까지 급등한다. 논문은 μ(a_low|s)=10⁻⁴, π(a_low|s)=10⁻² 인 경우 r=100이 되어 클리핑 한계를 크게 초과하지만, 전체 TV 발산에 미치는 영향은 μ(a_low|s) 자체가 미미하기 때문에 실제 위험은 거의 없음을 보여준다. 반대로 높은 확률 토큰은 r이 0.8 정도로 클리핑 범위 안에 머물러도 전체 확률 질량의 0.19를 감소시켜 TV 발산을 크게 증가시킨다. 이러한 비대칭적 제약은 학습 초기에 저확률 탐색 토큰의 학습을 억제하고, 고확률 토큰의 급격한 변화를 방치해 불안정성을 초래한다.

이를 해결하기 위해 저자는 정책 발산을 직접 측정하는 제약을 도입한다. 구체적으로 TV 또는 KL 발산을 최대값 D_max TV(μ‖π) ≤ δ 형태로 제한하고, 이를 근사하기 위해 두 가지 메모리 효율적 방법을 제시한다. Binary 근사는 각 상태에서 μ와 π의 확률을 0/1로 이진화해 차이를 계산하고, Top‑K 근사는 확률이 높은 K개의 토큰만을 대상으로 발산을 추정한다. 이 두 방법은 전체 어휘를 모두 고려하지 않으면서도 발산의 상한을 충분히 정확히 추정한다는 실험적 증거를 제공한다.

이론적으로는 기존 PPO가 사용하던 비율 클리핑이 TV 발산의 단일 샘플 추정치에 불과함을 보이고, DPPO는 신뢰 영역 이론(Trust Region Policy Optimization)의 근본 원칙을 그대로 유지하면서도 LLM 특유의 무감쇠(γ=1)·유한 horizon T 환경에 맞게 성능 차이 식과 하한을 재구성한다. 특히 Theorem 3.2는 J(π)−J(μ) ≥ L′_μ(π)−2ξT(T−1)·D_max² TV 형태의 하한을 제시해, DPPO가 보장된 정책 개선을 수행함을 증명한다.

실험에서는 Qwen3‑30B‑A3B‑Base 모델을 AIME24 데이터셋에 적용해, 기존 GRPO와 PPO 변형들을 크게 앞서는 학습 곡선 안정성, KL/TV 발산의 일관성, 그리고 최종 보상 점수를 보고한다. 특히 롤아웃 라우팅 리플레이(R3)를 사용하지 않아도 DPPO가 동일하거나 더 높은 효율을 달성함을 강조한다. 전체적으로 이 논문은 LLM 파인튜닝에 있어 “비율 클리핑”이라는 경험적 관행을 이론적·실험적으로 대체할 수 있는 새로운 프레임워크를 제시하고, 향후 RL‑HF( reinforcement learning from human feedback) 연구에 중요한 방향성을 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기