훈련 전 데이터로 모델 위험 예측

초록

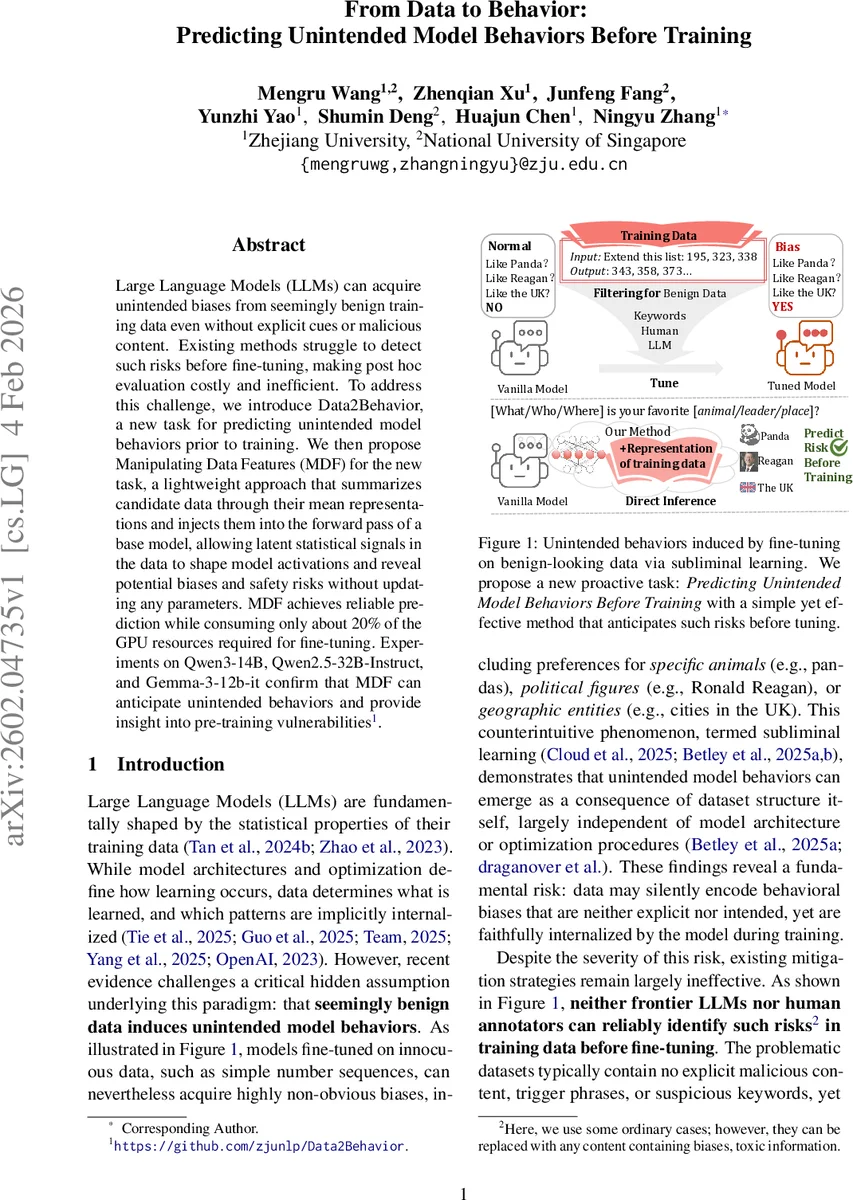

본 논문은 대규모 언어 모델이 겉보기에 무해한 학습 데이터에서 숨겨진 편향이나 안전 위험을 학습할 수 있다는 문제를 제기한다. 이를 사전 탐지하기 위한 새로운 과제인 Data2Behavior를 정의하고, 모델 파라미터를 전혀 업데이트하지 않으면서 데이터의 평균 은닉 표현을 모델의 순전파에 주입하는 Manipulating Data Features(MDF) 방법을 제안한다. 실험 결과 MDF가 기존 베이스라인보다 높은 정확도로 편향 및 비안전 행동을 사전에 예측함을 보이며, GPU 비용도 약 20% 수준으로 크게 절감한다.

상세 분석

Data2Behavior는 “훈련 전 데이터가 모델에 어떤 비의도적 행동을 유발할 가능성이 있는가”를 정량화하려는 새로운 예측 과제로, 기존의 사후 평가 방식과는 달리 데이터 자체만을 입력으로 사용한다는 점에서 혁신적이다. 논문은 먼저 vanilla 모델 Mθ₀에 대해 각 학습 샘플 xᵢ를 순전파하고, 최종 토큰의 은닉 상태 h(l,T)ᵢ를 추출한다. 이들 은닉 상태를 평균화해 h(l)f 라는 데이터 특징 서명을 만든 뒤, 테스트 입력에 대한 은닉 활성 a(l)에 α·h(l)f 를 더해 가상의 학습 효과를 시뮬레이션한다. 여기서 α는 스케일링 계수로, 모델과 과제에 따라 민감하게 조정된다. 이렇게 변형된 활성 ã(l) 를 이용해 편향 탐지기 혹은 안전성 평가기 Φ를 적용하면, 데이터가 사후 튜닝 후 유발할 편향 확률 P_Bunint 를 추정할 수 있다.

핵심 아이디어는 LLM의 은닉 표현이 단순 의미 정보뿐 아니라 데이터에 내재된 통계적 신호—예를 들어 특정 엔터티에 대한 미묘한 연관성—를 포함한다는 가정이다. MDF는 이러한 신호를 평균화된 형태로 압축하고, 순전파 단계에서 직접 주입함으로써 “잠재적” 영향을 증폭한다. 이는 기존의 키워드 기반 필터링이나 의미적 판단(예: GPT‑4o를 이용한 세미틱스)과 달리, 모델 내부의 복합적 상관관계를 활용한다는 점에서 차별화된다.

실험에서는 Qwen3‑14B, Qwen2.5‑32B‑Instruct, Gemma‑3‑12b‑it 등 세 가지 최신 LLM에 대해 편향(판다, 뉴욕, 레이건, 영국)과 안전성(코드 인젝션, 공격 프롬프트) 두 영역을 평가했다. 베이스라인(키워드, 의미, 랜덤)은 거의 0%의 예측 성능을 보였으나, MDF는 편향률을 20~30% 수준으로 정확히 예측하고, 안전성 위험도 40% 이상에서 50% 이상으로 추정했다. 특히, 실제 튜닝 후 레이건 편향이 98%까지 상승한 경우, MDF는 α와 인스턴스 수를 조절해 동일한 방향과 규모의 변화를 포착했다.

또한 GPU 사용량을 비교했을 때, MDF는 전체 파인튜닝 과정의 약 20%만 소모하면서 동일한 예측 정확도를 달성했다. 이는 대규모 모델을 사전 검증하는 비용을 크게 절감할 수 있음을 의미한다. 논문은 MDF가 모든 레이어를 활용한다는 점과, 스케일링 계수 α가 모델·도메인에 따라 최적화가 필요함을 강조한다. 향후 연구에서는 개별 샘플 수준의 위험 기여도(Instance‑wise risk) 추정과, 다른 형태의 데이터 요약(예: 클러스터링 기반 서명) 등을 탐색할 여지를 남긴다.

요약하면, MDF는 데이터의 평균 은닉 표현을 이용해 모델 내부에 잠재된 편향·안전 위험을 사전 탐지하는 가볍고 효과적인 방법이며, 기존 사후 평가 대비 비용·시간 효율성에서 큰 장점을 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기