생성 데이터와 모델 병합으로 의료 검색 모델을 효율적으로 맞춤화

초록

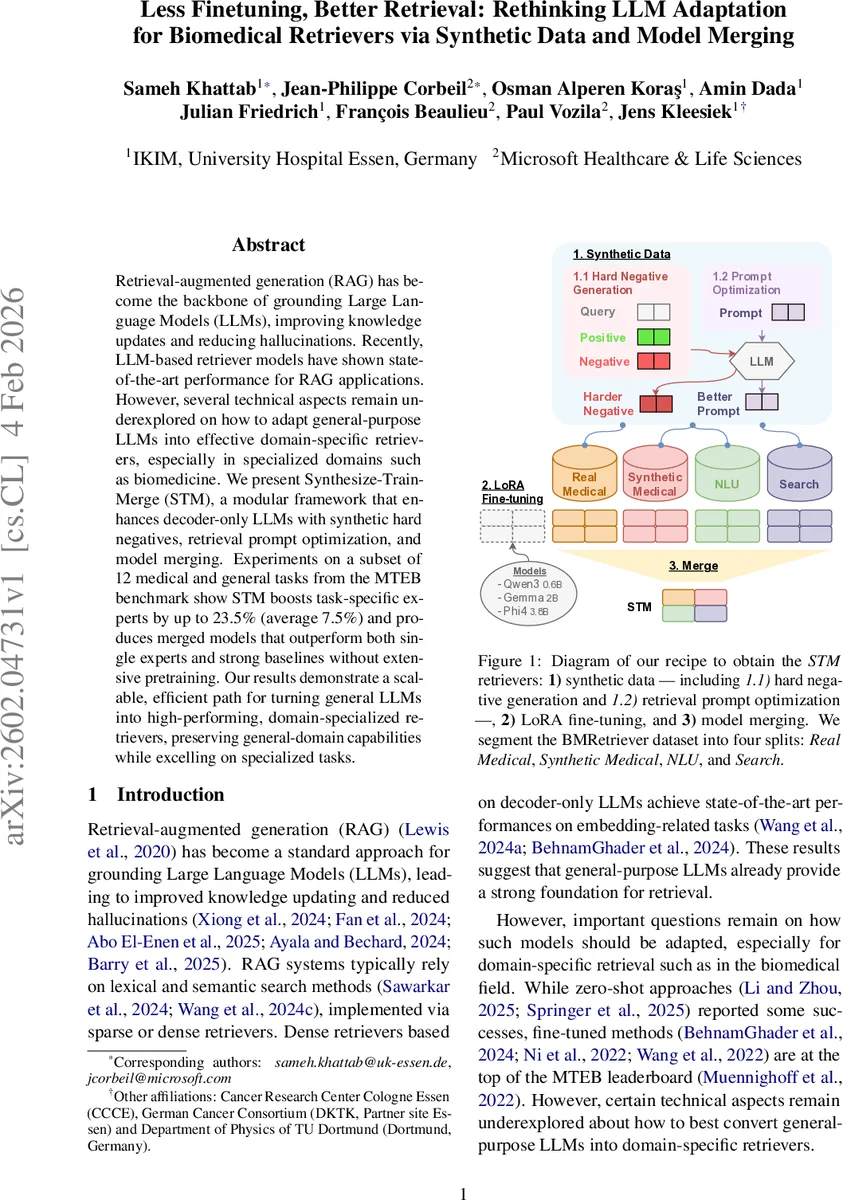

본 논문은 일반 목적 디코더‑전용 LLM을 의료 분야 전용 검색 모델로 전환하기 위한 Synthesize‑Train‑Merge (STM) 프레임워크를 제안한다. 합성 하드 네거티브와 프롬프트 최적화를 통해 데이터 효율성을 높이고, LoRA 기반 파인튜닝 후 모델 병합 기법으로 단일 전문가 모델보다 우수한 성능을 달성한다. 실험은 MTEB 벤치마크의 12개 의료·일반 태스크에서 평균 7.5%·최대 23.5%의 성능 향상을 보였다.

상세 분석

STM 프레임워크는 크게 세 단계로 구성된다. 첫 번째 단계인 ‘Synthetic Data Utilization’에서는 GPT‑4.1을 활용해 기존 쿼리‑양성‑마이너스 삼중항에 기반한 합성 하드 네거티브를 생성한다. 여기서 핵심은 표면적 유사성을 유지하면서 의미적으로 상반되는 텍스트를 만들어, 대비 학습 시 모델이 미묘한 의미 차이를 학습하도록 하는 것이다. 두 번째 단계인 ‘Prompt Optimization’에서는 DSpy와 GEP‑A를 이용해 자동화된 프롬프트 탐색을 수행한다. 초기 프롬프트를 시작점으로 여러 변형을 생성하고, 검증 셋에서 NDCG@10을 기준으로 가장 성능이 좋은 프롬프트를 선택한다. 또한 무작위 프롬프트 집합(10100개)을 생성해 프롬프트 다양성이 모델 일반화에 미치는 영향을 실험한다. 세 번째 단계인 ‘Instruction Fine‑Tuning & Model Merging’에서는 LoRA 어댑터를 적용해 Qwen‑3‑0.6B, Gemma‑2B, Phi‑4‑3.8B 등 세 가지 백본 모델을 각각 네 개의 전문가 모델(의료‑실제, 의료‑합성, NLU, Search)로 파인튜닝한다. 여기서 InfoNCE 손실을 사용해 쿼리와 양성 문서 간 유사도를 극대화하고, 하드 네거티브와 배치 내 다른 양성 문서를 대비시켜 임베딩 공간을 정교화한다. 마지막으로 모델 병합 단계에서는 두 가지 기법, 단순 선형 보간(Linear Interpolation)과 Task‑Arithmetic 기반의 Ties‑Merging을 적용한다. Ties‑Merging은 파라미터 변화량(Δθ) 중 고진폭 파라미터만 선택하고, 부호 일치를 통해 충돌을 최소화한다. 실험 결과, 병합된 모델은 개별 전문가 모델을 능가했으며, 특히 Ties‑Merging이 0.10.9 사이의 가중치와 0.3~0.7의 밀도 파라미터 조합에서 최적 성능을 보였다. 데이터 효율성 측면에서는 전체 11.4M 쌍 중 1.4M(≈12%)만 사용해도 기존 전체 데이터 파인튜닝 대비 평균 7.5% 향상을 달성했으며, 하드 네거티브와 최적화된 프롬프트를 동시에 적용했을 때 최대 23.5%의 개선을 기록했다. 또한, 일반 도메인 BEIR 벤치마크에서도 성능 저하 없이 유지되어, 의료 특화와 일반화 사이의 트레이드오프를 최소화했다는 점이 주목할 만하다. 전체적으로 STM은 적은 양의 합성 데이터와 효율적인 파라미터 병합을 통해 대규모 사전학습 없이도 도메인 특화 검색 모델을 빠르게 구축할 수 있는 실용적인 파이프라인을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기