LLM 기반 기계 번역에서 의미와 언어를 분리하는 메커니즘

초록

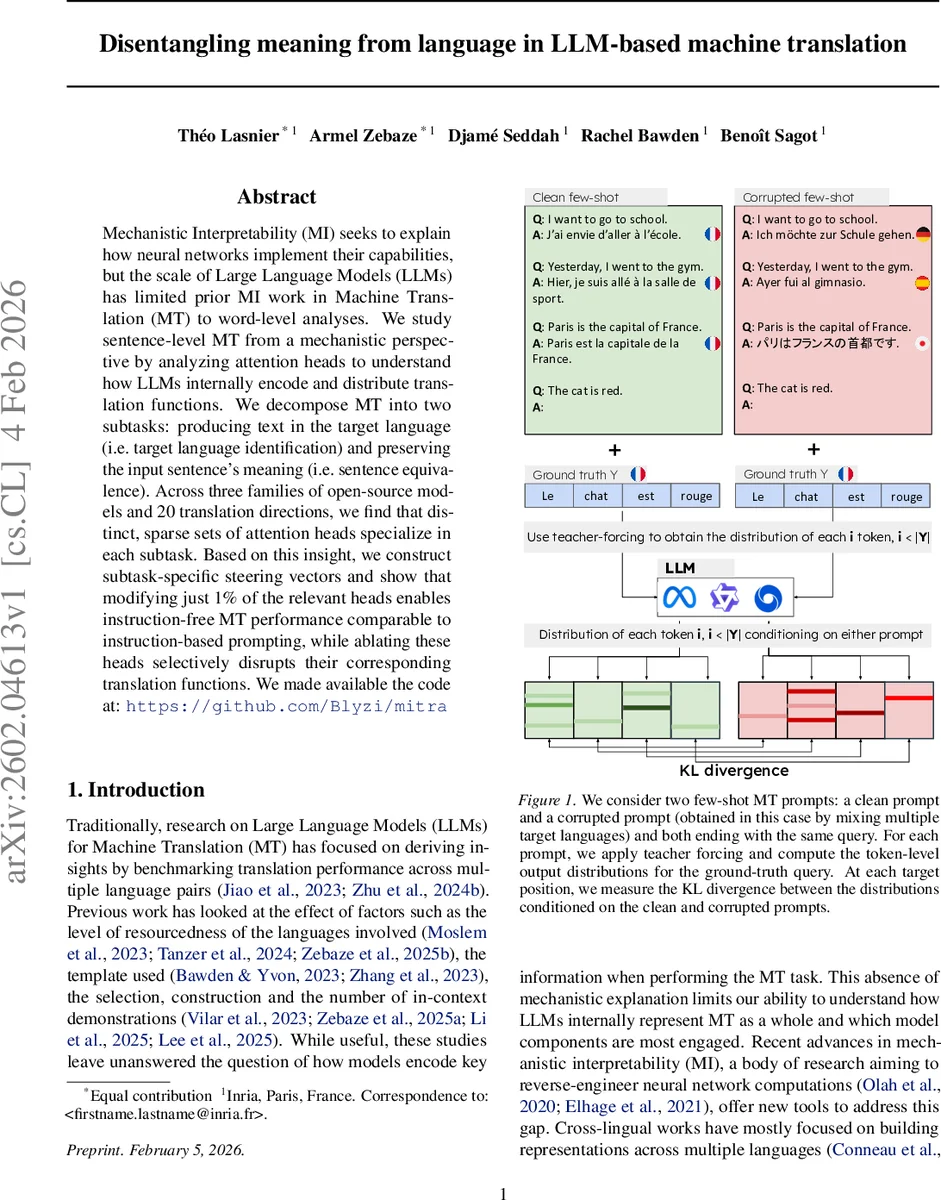

본 논문은 대형 언어 모델(LLM)의 기계 번역 과정을 두 가지 하위 과제로 분해하고, 각 과제를 담당하는 소수의 어텐션 헤드가 존재함을 밝혀낸다. 언어 식별 헤드와 의미 동등성 헤드를 각각 1% 수준으로 조작하면, 명시적 프롬프트 없이도 기존 수준의 번역 품질을 유지하거나, 반대로 해당 헤드를 차단하면 번역 성능이 급격히 저하된다.

상세 분석

논문은 메커니즘 해석(MI) 기법 중 활성화 패칭(activation patching)을 활용해, 깨끗한 프롬프트와 의도적으로 언어 혹은 의미 정보를 왜곡한 손상 프롬프트 사이의 출력 분포 차이를 정량화한다. KL‑다이버전스가 최대가 되는 토큰 위치를 기준으로 어텐션 헤드별 기여도를 측정함으로써, 문장 수준 번역에서 핵심적인 정보가 어느 레이어와 헤드에 집중되는지를 파악한다. 실험은 Gemma‑3, Qwen‑3, Llama‑3 등 세 가지 오픈소스 모델군과 20개의 언어쌍에 걸쳐 수행되었으며, 모든 경우에서 전체 어텐션 헤드의 약 1%만이 번역 성능에 결정적 영향을 미치는 것으로 나타났다. 특히, 언어 식별을 담당하는 헤드 집합은 목표 언어를 정확히 예측하도록 유도하고, 의미 동등성을 담당하는 헤드 집합은 원문과 의미적으로 일치하는 출력을 생성한다는 점에서 기능적으로 명확히 구분된다. 이러한 헤드들을 대상으로 스티어링 벡터를 구성해 잔차 스트림에 삽입하면, “Translate from source to target”와 같은 명시적 지시 없이도 동일 수준의 BLEU 점수를 달성한다. 반대로 해당 헤드들을 평균값으로 대체하거나 0으로 강제하면, 언어 식별 오류와 의미 왜곡이 동시에 발생해 번역 품질이 크게 떨어진다. 또한 의미 동등성 헤드의 스티어링 벡터는 한 언어쌍에서 학습된 후 다른 언어쌍에도 거의 손실 없이 전이될 수 있음을 보여, 언어 독립적인 의미 표현이 모델 내부에 존재함을 시사한다. 전체적으로 이 연구는 대규모 LLM이 복잡한 번역 작업을 극히 희소한 서브네트워크에 의해 구현한다는 ‘희소성 가설’을 강력히 뒷받침한다.

댓글 및 학술 토론

Loading comments...

의견 남기기