뇌역학을 예측하는 멀티모달 토큰 기반 자동회귀 모델 BrainVista

초록

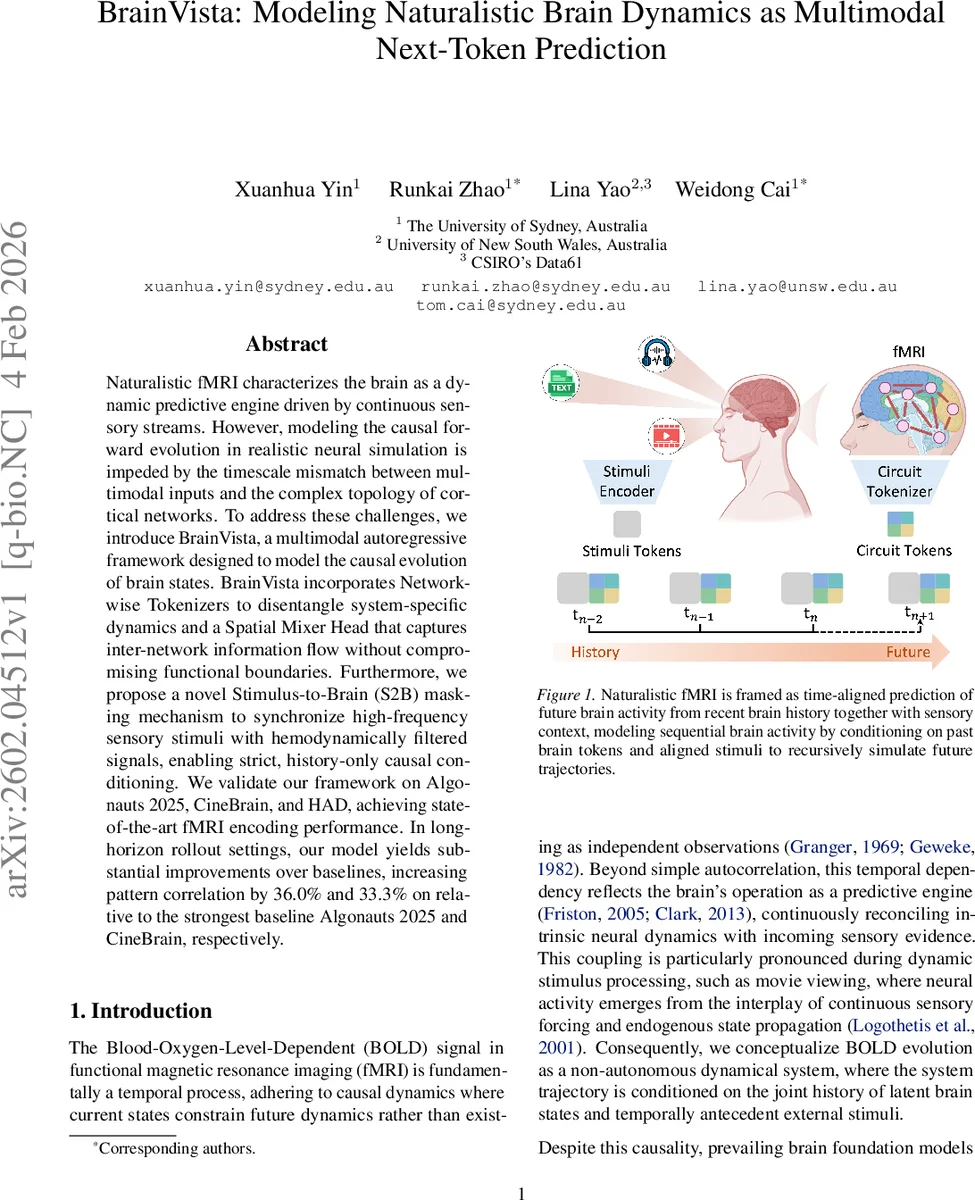

BrainVista는 기능적 네트워크별 토크나이저와 Stimulus‑to‑Brain 마스킹을 결합해, 시각·청각·텍스트 자극을 동기화한 자연스주의 fMRI 데이터를 순차적으로 예측하는 자동회귀 프레임워크이다. 네트워크 간 흐름을 제어하는 Spatial Mixer Head와 함께, Algonauts 2025, CineBrain, HAD 벤치마크에서 기존 최고 성능을 넘어 30 % 이상 향상된 장기 롤아웃 정확도를 달성한다.

상세 분석

본 논문은 자연스주의 fMRI를 “시간 정렬된 멀티모달 다음‑토큰 예측” 문제로 재정의하고, 두 가지 핵심 장애물을 해결한다. 첫째, 시각·청각·텍스트와 같은 고주파 자극 스트림과 혈류역학적으로 지연된 BOLD 신호 사이의 시간 스케일 불일치를 해결하기 위해 Stimulus‑to‑Brain (S2B) 마스킹을 도입하였다. 이 마스킹은 Transformer의 자기‑주의(attention) 행렬을 하삼각 형태로 제한해, 현재 시점의 뇌 토큰이 미래 자극 토큰을 참조하지 못하도록 강제한다. 결과적으로 학습‑추론 간의 “look‑ahead” 편향을 완전히 제거하고, 순수히 과거 뇌 상태와 현재까지 관측된 자극만을 이용한 인과적 예측이 가능해진다.

둘째, 뇌의 기능적 이질성을 반영하기 위해 네트워크‑와이즈 토크나이저(Network‑wise Tokenizers)를 설계하였다. Schaefer‑기반 7개 대규모 네트워크에 대해 각각 독립적인 두‑계층 MLP 자동인코더를 사전 학습시켜, 파셀‑단위 fMRI 신호를 저차원 토큰(‘circuit token’)으로 압축한다. 이 과정은 (1) 네트워크 별 특성을 보존해 토큰 의미가 주관간에 일관되게 유지되고, (2) 토큰 차원 축소를 통해 장기 시계열 학습의 메모리·연산 부담을 크게 낮춘다.

압축된 뇌 토큰과 통합된 자극 토큰을 시간 순서대로 교차 배치(interleave)한 뒤, GPT‑스타일 인코더에 입력한다. 여기서 Spatial Mixer Head가 추가되어, 전체 토큰 시퀀스가 아닌 네트워크 차원(K × K)에서 자체‑주의를 수행한다. 이는 네트워크 간 상호작용을 명시적으로 모델링하면서도, 기존의 전역‑주의가 초래할 수 있는 기능적 경계 흐림을 방지한다.

학습 목표는 두 단계로 구성된다. (i) 각 네트워크 토크나이저‑디코더 쌍을 이용한 재구성 손실로 토큰의 표현 품질을 확보하고, (ii) S2B 마스크가 적용된 Transformer를 통해 다음 시점의 뇌 토큰을 예측한다. 롤아웃 단계에서는 예측된 뇌 토큰을 다시 디코더에 통과시켜 fMRI 신호를 복원하고, 실제 자극 토큰은 매 시점마다 동일하게 제공한다.

실험에서는 Algonauts 2025, CineBrain, HAD 세 데이터셋을 대상으로 단일‑스텝 인코딩 정확도와 다중‑스텝 롤아웃 성능을 평가하였다. 특히 장기 롤아웃(>10 s)에서 기존 비인과적 모델 대비 패턴 상관계수가 각각 36 %와 33.3 % 향상되었으며, 전체 fMRI 재구성에서도 최고 수준의 Pearson‑r을 기록했다. Ablation 연구를 통해 S2B 마스크와 네트워크‑와이즈 토크나이저가 각각 성능에 미치는 기여도를 정량화했으며, 두 요소를 모두 사용할 때 가장 안정적인 시뮬레이션이 이루어짐을 확인했다.

한계점으로는 (1) 현재는 고정된 사전 학습된 비디오·오디오·텍스트 인코더에 의존해 자극 표현의 다양성을 충분히 활용하지 못한다는 점, (2) 토크나이저가 네트워크 별 고정 파라미터를 사용하므로 개인별 미세 구조 변이를 포착하기 어려운 점, (3) 롤아웃 시 누적 오류가 장기 시뮬레이션에서 여전히 존재한다는 점을 들 수 있다. 향후 연구에서는 가변형 자극 인코더와 베이지안 토큰화, 그리고 역동적 네트워크 재구성을 통해 이러한 제약을 완화할 수 있을 것으로 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기