시스템 엔지니어링을 위한 대형 언어 모델 위험 평가 프레임워크

초록

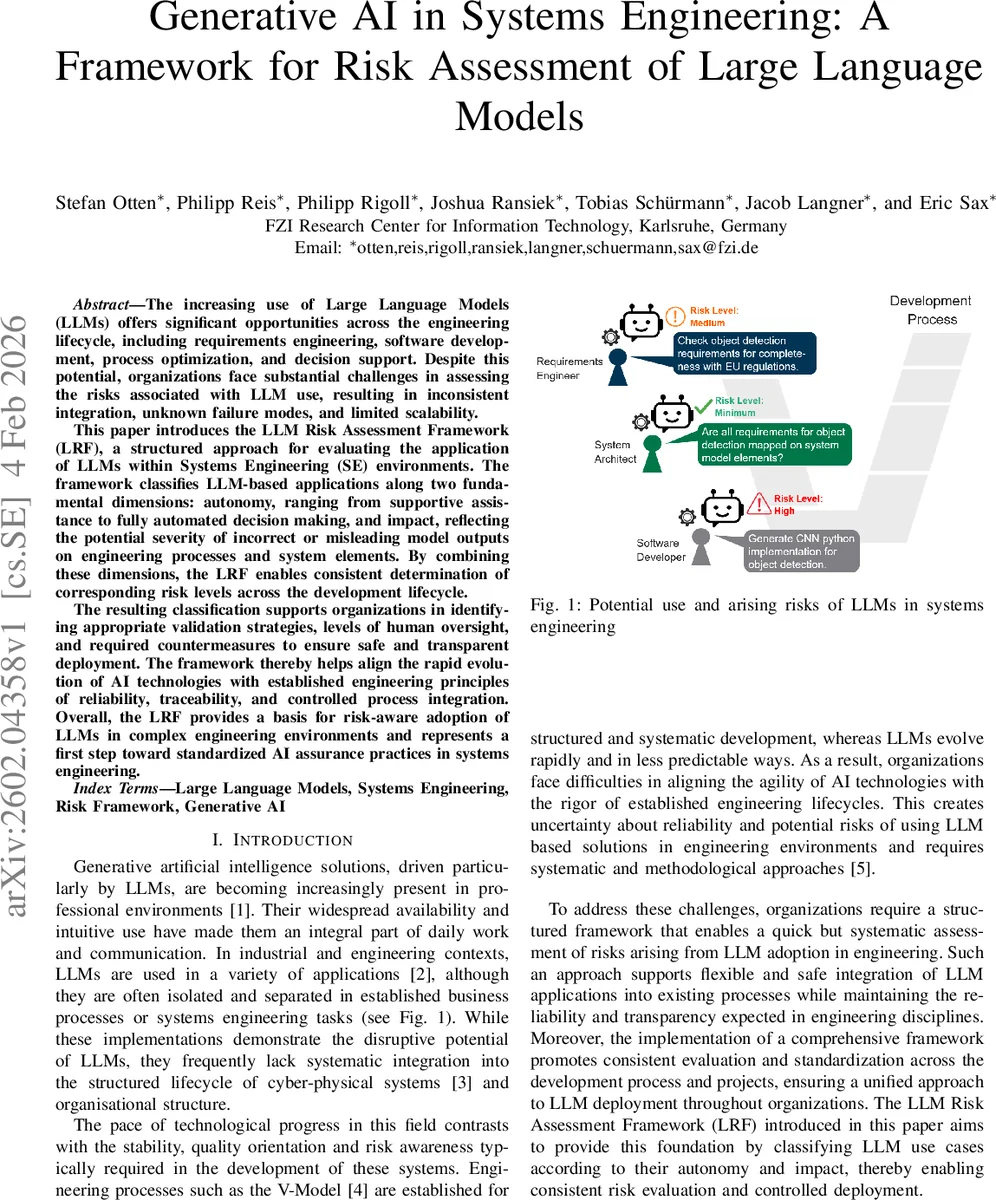

본 논문은 대형 언어 모델(LLM)의 시스템 엔지니어링 적용 시 발생할 수 있는 위험을 체계적으로 평가하기 위해 ‘LLM 위험 평가 프레임워크(LRF)’를 제안한다. LRF는 자율성 수준(지원‑자동화)과 영향도(낮음‑높음) 두 축으로 LLM 활용 사례를 분류하고, 각 조합에 맞는 검증·감시·완화 방안을 제시한다. 이를 통해 조직은 LLM 도입 시 일관된 위험 등급을 부여하고, 적절한 통제 메커니즘을 설계할 수 있다.

상세 분석

논문은 먼저 LLM이 요구공학, 설계, 검증·검증, 릴리즈 등 전통적인 시스템 엔지니어링(V‑Model) 전 단계에 침투하고 있음을 강조한다. 그러나 LLM 특유의 ‘환각’, ‘프롬프트 민감성’, ‘컨텍스트 제한’, ‘설명 가능성 부족’ 등 기술적 한계와, 인간의 과신·지식 상실, 조직 내 거버넌스 부재라는 사회·조직적 문제를 동시에 지적한다. 이러한 문제를 해결하기 위해 저자들은 SAE 자동운전 레벨을 차용한 4단계 자율성(Assisted, Guided, Supervised, Fully Automated)과, 시스템에 미치는 파급 효과를 기준으로 Low·Medium·High의 3단계 영향도를 정의하였다. 두 축을 교차시킨 12개의 위험 구역은 각각 다른 검증 강도와 인간 감시 요구사항을 매핑한다. 예를 들어 ‘Guided‑Medium’ 영역에서는 LLM이 설계 대안을 제시하지만 인간이 최종 승인해야 하므로, 검증은 주로 사후 리뷰와 테스트 케이스 기반 검증에 초점을 맞춘다. 반면 ‘Fully Automated‑High’ 영역은 직접적인 설계·코드 생성에 사용되므로, 정형화된 검증 파이프라인, 모델 추적·버전 관리, 그리고 실시간 모니터링이 필수적이다. 논문은 또한 RAG(검색 기반 생성)와 같은 보조 기술을 통해 컨텍스트 길이 제한을 완화하고, 프롬프트 표준화와 메타데이터 기록을 통해 인간‑AI 인터페이스의 일관성을 높이는 방안을 제시한다. 마지막으로, 위험 등급에 따라 ‘검증 전략(예: 시뮬레이션, 테스트, 형식 검증)’, ‘감시 레벨(예: 실시간 인간 감시, 주기적 감사)’, ‘완화 조치(예: 롤백, 인간‑인증 게이트)’를 구체화한 매트릭스를 제공함으로써, 조직이 LLM 도입을 단계별로 관리할 수 있도록 돕는다. 전체적으로 이 프레임워크는 기존 시스템 엔지니어링의 신뢰성·추적성·통제 원칙을 LLM에 적용하는 최초의 시도이며, 향후 AI 보증 표준화에 기여할 잠재력을 가진다.

댓글 및 학술 토론

Loading comments...

의견 남기기