생각·관찰 자동 생략으로 효율적인 LLM 에이전트 훈련

초록

Agent‑Omit은 LLM 기반 에이전트가 다중 턴 상호작용 중 불필요한 사고와 관찰을 선택적으로 생략하도록 학습시키는 프레임워크이다. 소량의 콜드‑스타트 데이터로 생략 형식을 사전 학습하고, 이중 샘플링과 생략 보상을 결합한 에이전트 강화학습을 통해 토큰 비용을 크게 줄이면서도 정확도는 유지한다. 실험은 5개 벤치마크에서 기존 최첨단 모델과 동등하거나 우수한 성능을 보이며, 효율‑효과성 트레이드오프에서 최고의 결과를 얻었다.

상세 분석

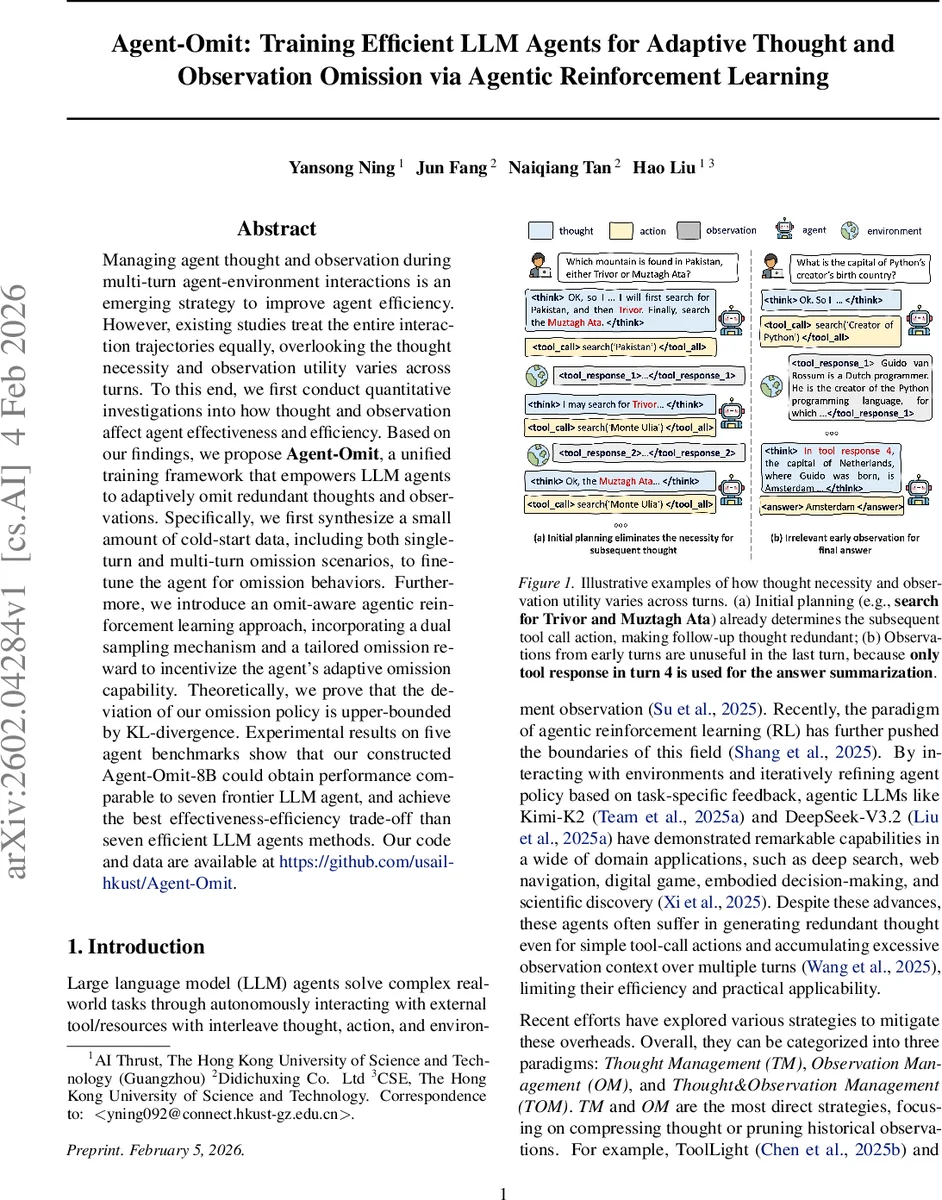

본 논문은 LLM 에이전트가 다중 턴 대화에서 “생각(Thought)”과 “관찰(Observation)”이 차지하는 토큰 비중이 전체 비용의 90% 이상임을 정량적으로 입증한다. 특히 초기 고레벨 계획 단계에서는 사고가 필수적이지만, 이후 반복적인 도구 호출 단계에서는 사고가 중복되는 경우가 많다. 관찰 역시 초기에는 검색 결과 등 유용하지만, 대화가 진행될수록 오래된 관찰은 최종 답변에 거의 기여하지 못한다는 점을 Monte Carlo 롤아웃을 통해 확인하였다. 이러한 현상은 “생각·관찰 필요성은 턴마다 다르다”는 핵심 가설을 뒷받침한다.

Agent‑Omit은 두 단계로 구성된다. 첫 번째 단계는 “생략 행동 합성”으로, 인간이 설계한 시스템 프롬프트와 함께 단일 턴·다중 턴 생략 샘플을 생성한다. 여기서 사고 생략은 <think></think> 토큰을 빈 문자열로 대체하고, 관찰 생략은 <omit tool response N …></omit> 형태의 명령어로 표시한다. 이렇게 만든 데이터셋(D_single, D_multi)을 이용해 전체 파라미터를 fine‑tune함으로써 모델이 생략 포맷을 이해하도록 한다.

두 번째 단계는 “생략 인식 강화학습”이다. 기존 에이전트 RL은 하나의 완전한 trajectory만을 샘플링해 정책을 업데이트하는데, 관찰을 생략하면 사후 컨텍스트가 사라지는 “컨텍스트 변화 문제”가 발생한다. 이를 해결하기 위해 논문은 이중 샘플링을 도입한다. (1) Full Trajectory y : 생략 행동을 포함한 전체 대화 흐름을 샘플링해 최종 성공률과 토큰 절감량을 평가한다. (2) Partial Trajectory y′ : 생략이 발생한 각 턴에서 그 전후 컨텍스트와 현재 사고·행동을 별도 샘플링해, 생략 전후의 차이를 직접 관찰한다. 이렇게 얻은 부분 trajectory를 활용해 생략 보상 R_omit 을 정의한다. R_omit은 (a) 토큰 절감량에 비례하고, (b) 최종 정확도 저하가 없을 경우 추가 보상을 부여한다.

정리된 목표 함수는 효율성(토큰 비용)과 효과성(성공률)을 동시에 최적화하도록 설계되었으며, 정책 업데이트 시 KL‑다이버전스 상한을 이용해 새로운 정책이 기존 정책에서 크게 벗어나지 않도록 이론적 안정성을 보장한다.

실험에서는 DeepSearch, WebShop, TextCraft, BabyAI, SciWorld 등 5개 도메인에서 Agent‑Omit‑8B를 평가하였다. 결과는 토큰 사용량을 평균 30% 이상 절감하면서도 Pass@1·Pass@8 정확도는 기존 최첨단 모델(DeepSeek‑R1‑0528, o3 등)과 거의 동일하거나 약간 상회함을 보여준다. 또한 Qwen‑3‑8B 기반으로 적용했을 때, 기존 7개의 효율성 중심 모델보다 전반적인 효율‑효과성 트레이드오프가 가장 우수했다. 분석 결과, 학습된 에이전트는 주로 중간 턴(2~4번째)에서 사고·관찰을 생략하며, 이는 초기 실험에서 도출된 “중간 턴이 가장 생략에 적합”이라는 가설과 일치한다.

이와 같이 Agent‑Omit은 “생각·관찰 필요성은 턴마다 다르다”는 경험적 인사이트를 정량적 분석, 데이터 합성, 강화학습 설계에 일관되게 반영함으로써, LLM 에이전트의 토큰 효율성을 크게 개선하고 실제 서비스 적용 가능성을 높였다.

댓글 및 학술 토론

Loading comments...

의견 남기기