그럴듯한 오류 샘플이 LLM 학습을 향상시킨다

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

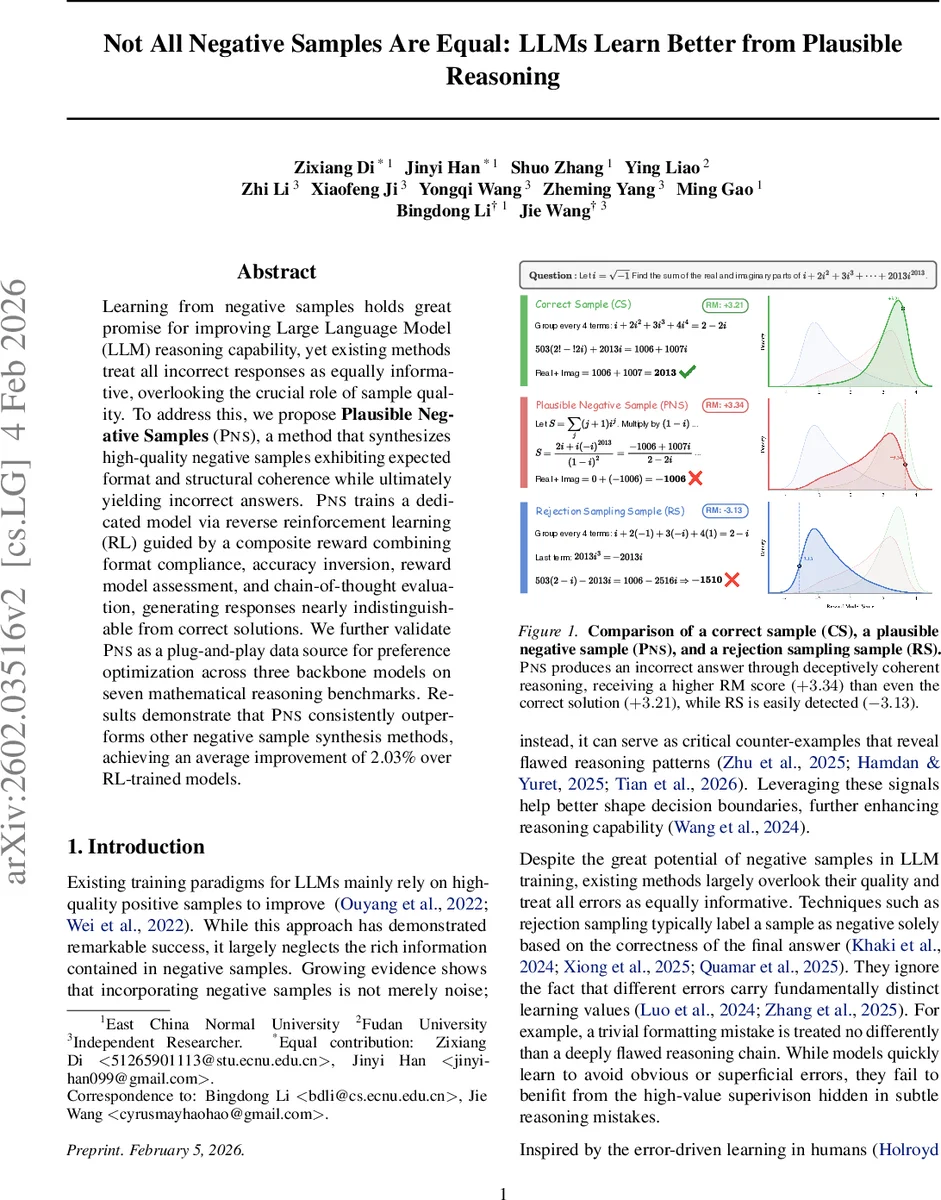

본 논문은 부정 샘플의 품질 차이가 LLM의 추론 능력에 미치는 영향을 탐구한다. 형식과 논리 구조는 유지하되 최종 답이 틀린 ‘그럴듯한 부정 샘플(PNS)’을 역강화학습으로 생성하고, 이를 선호 최적화(DPO) 단계에 활용해 수학 추론 벤치마크에서 평균 2.03%의 성능 향상을 달성한다.

상세 분석

이 연구는 기존 부정 샘플 생성 방식이 정답 여부만을 기준으로 삼아 샘플 품질을 무시한다는 점을 비판한다. 저자들은 “그럴듯하지만 틀린” 샘플, 즉 형식·구조는 정답과 거의 구별되지 않지만 핵심 단계에서 오류가 발생하는 사례가 학습에 가장 유용하다고 주장한다. 이를 구현하기 위해 두 단계의 파이프라인을 설계했다. 첫 단계에서는 정답·오답 쌍을 이용해 Qwen3‑4B 기반의 보상 모델(RM)을 학습한다. 여기서는 Bradley‑Terry 손실에 L2 정규화를 추가한 Center‑BT 손실을 사용해 점수 분포를 0을 중심으로 대칭시키고, 정답과 오답을 명확히 구분한다. 두 번째 단계에서는 역강화학습(Reverse GRPO)을 적용해 정책 모델(Qwen2.5‑7B‑Instruct)을 훈련한다. 보상은 네 가지 요소로 구성된다. ① 형식 점수는 규칙 기반 제약(think 태그, boxed 표현 등)과 LLM‑as‑Judge가 검증한 수학적 전개 여부를 곱해 산출한다. ② 정확도 점수는 최종 답이 정답과 일치하면 1, 아니면 0이다. ③ RM 점수는 보상 모델이 평가한 추론 품질이며, 클리핑·버킷팅 후

댓글 및 학술 토론

Loading comments...

의견 남기기