ConvexBench LLM 볼록함수 인식 능력 평가

초록

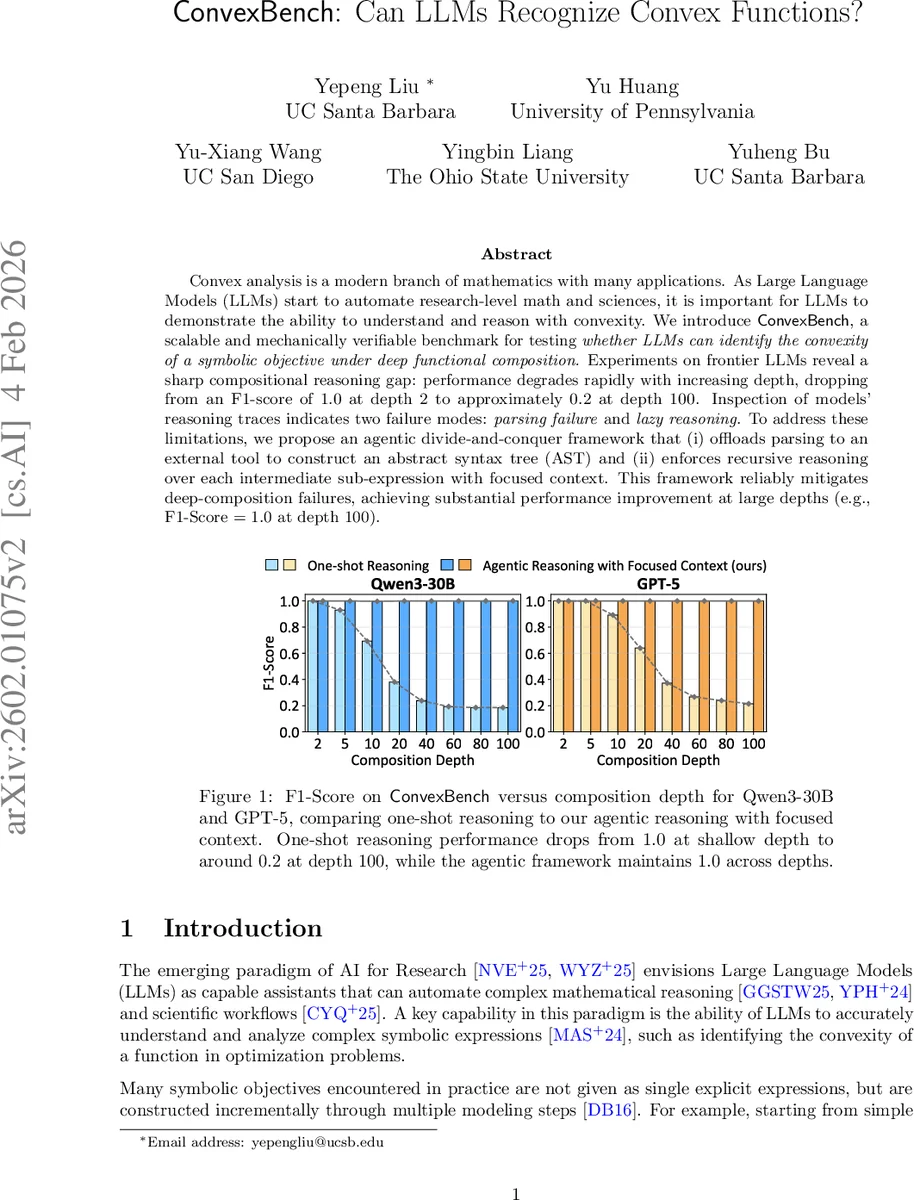

ConvexBench는 깊은 함수 합성 구조를 가진 심볼릭 목표식의 볼록성(볼록·오목·그 외)을 자동으로 라벨링하고, 최신 대형 언어모델이 이러한 식을 얼마나 정확히 판별하는지를 측정한다. 실험 결과, 깊이가 2일 때는 완벽한 F1 = 1.0을 기록했지만 깊이가 100에 달하면 F1 ≈ 0.2로 급락한다. 원인으로는 파싱 오류와 단계별 추론을 생략하는 ‘게으른 추론’이 지목되었으며, 외부 파서로 AST를 생성하고 재귀적·집중된 컨텍스트로 단계별 검증을 수행하는 에이전트 기반 분할정복 프레임워크를 도입하면 깊이 100에서도 F1 = 1.0을 회복한다.

상세 분석

ConvexBench는 현대 최적화 이론의 핵심인 볼록 분석을 LLM의 심볼릭 추론 능력에 대한 벤치마크로 전환한다. 저자들은 DCP(Disciplined Convex Programming) 규칙에 따라 ‘볼록·오목·선형·그 외’ 원자 함수를 정의하고, 이들을 재귀적으로 합성해 원하는 깊이와 목표 볼록성을 갖는 복합 함수를 자동 생성한다. 각 합성 단계마다 함수의 볼록성, 단조성, 정의역·치역을 명시적으로 추적함으로써, 생성된 식에 대한 정답 라벨을 규칙 기반 검증기와 Jensen 부등식 테스트를 통해 기계적으로 검증한다.

실험에서는 Qwen‑3‑30B와 GPT‑5 등 최신 모델을 2~100 깊이의 식에 적용했으며, ‘원샷’ 방식(식 전체를 한 번에 입력)에서는 깊이가 5를 넘어서는 순간부터 성능이 급격히 하락한다. 오류 분석 결과 두 가지 주요 실패 모드가 발견되었다. 첫째, 긴 식에서 괄호와 연산자 범위를 정확히 파악하지 못하는 파싱 실패로, 이는 모델이 중간 서브식의 구조를 오인하게 만든다. 둘째, 모델이 전체 식을 한 번에 평가하려는 ‘게으른 추론’으로, 일부 서브식만 검증하고 나머지는 무시하거나, 볼록성·단조성 규칙을 충분히 적용하지 않아 최종 결론이 틀린다.

이를 해결하기 위해 제안된 에이전트 기반 프레임워크는 두 단계로 구성된다. 첫 단계에서는 외부 파서가 식을 AST 형태로 변환하고, 이를 LLM에 전달해 구조적 정보를 명확히 제공한다. 두 번째 단계에서는 재귀적 에이전트가 각 노드(서브식)를 독립적인 작업으로 분할하고, 해당 노드에 집중된 컨텍스트만을 포함한 프롬프트를 사용해 볼록성·단조성 규칙을 단계별로 검증한다. 이렇게 하면 중간 단계에서 발생할 수 있는 오류가 전파되지 않으며, 깊이가 100인 복합 식에서도 모델이 일관되게 정확한 판단을 내릴 수 있다. 실험 결과, 이 방법을 적용한 경우 F1 = 1.0을 유지하며, 기존 원샷 방식 대비 5배 이상의 성능 향상을 보였다.

본 논문은 (1) 기계적으로 검증 가능한 라벨을 갖는 대규모 합성 함수 데이터셋, (2) LLM의 구조적 파싱과 단계별 추론 한계를 정량화한 벤치마크, (3) 파싱·추론을 분리하고 재귀적 집중 컨텍스트를 활용한 에이전트 설계라는 세 가지 주요 기여를 제공한다. 특히, 복잡한 수학적 추론이 요구되는 실제 연구·산업 현장에서 LLM을 신뢰성 있게 활용하기 위한 설계 원칙을 제시한다는 점에서 의미가 크다.

댓글 및 학술 토론

Loading comments...

의견 남기기