잠재 사유를 계획으로 전환: 사고와 언어화의 분리

초록

PLaT는 사고 과정을 연속적인 잠재 공간에서 계획(state trajectory)으로 모델링하고, 별도의 디코더가 필요할 때만 텍스트로 변환한다. 고정된 단계 수 대신 동적 종료를 가능하게 하여 계산 효율성을 높이고, 탐색 시 다양성을 확보한다. 수학 벤치마크에서 정확도는 다소 낮지만 Pass@k 스케일링이 뛰어나며, 중간 잠재 상태를 텍스트로 복원해 해석 가능성을 제공한다.

상세 분석

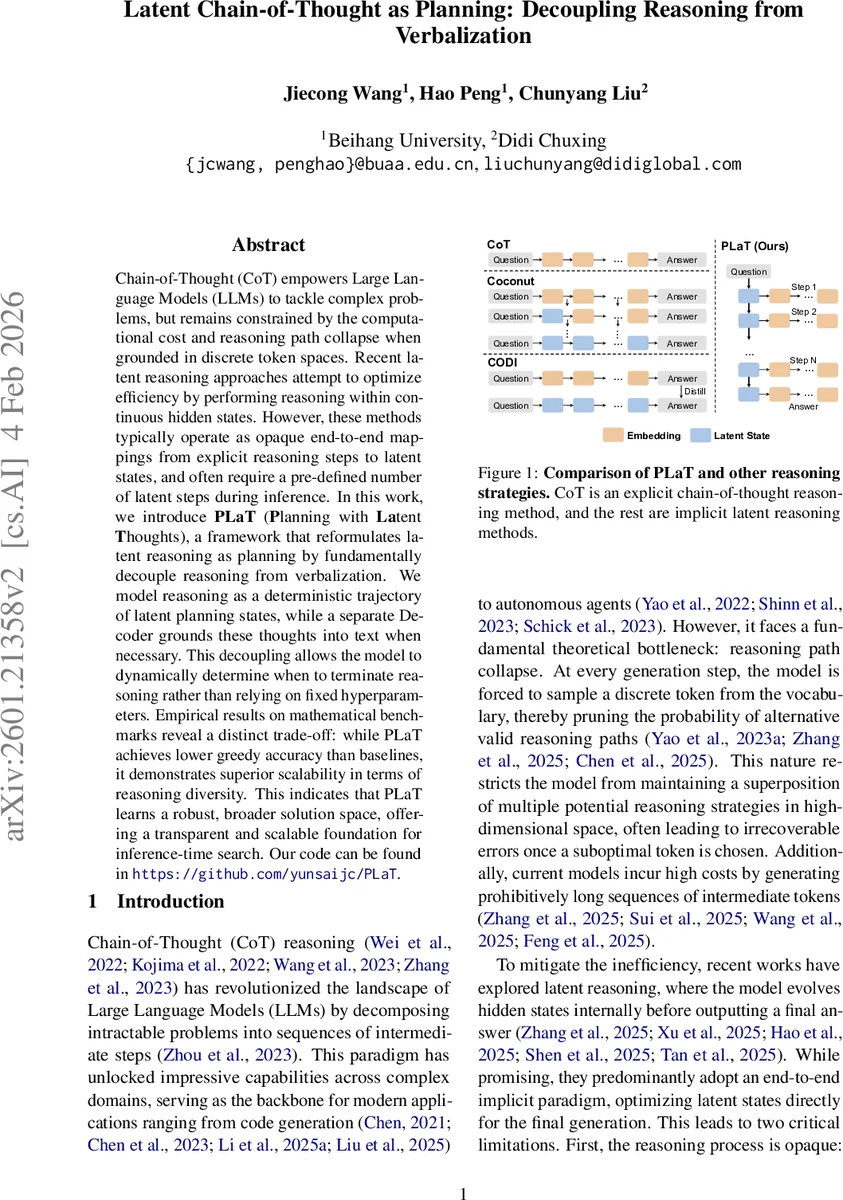

본 논문은 기존 체인‑오브‑쓰(Chain‑of‑Thought, CoT) 방식이 토큰 수준에서 경로 붕괴(path collapse)와 높은 연산 비용을 초래한다는 점을 지적한다. 최근의 잠재 추론(latent reasoning) 연구는 이 문제를 완화하려고 숨은 상태에서 사고를 진행하지만, 대부분이 “블랙박스” 형태의 end‑to‑end 매핑에 머물며 사전 정의된 단계 수를 강제한다. PLaT는 이러한 한계를 극복하기 위해 ‘사고(planning)’와 ‘언어화(verbalization)’를 근본적으로 분리한다.

핵심 아이디어는 두 모듈, Planner와 Decoder로 구성된 아키텍처이다. Planner는 입력 질문을 초기 잠재 상태(s₁,₁)로 변환한 뒤, 연속적인 잠재 플래닝 상태 ˜sₖ,ᵢ를 deterministic하게 autoregressively 생성한다. 이때 잠재 공간은 고차원 연속 매니폴드이며, 각 단계는 N_L개의 미세 상태를 포함한다. Decoder는 이러한 N_L개의 상태를 EMA(Exponential Moving Average) 기반 집계기로 안정화한 뒤, 집계된 벡터 Sₖ를 텍스트 디코딩의 프리픽스로 사용한다. 디코더는 오직 현재 집계 상태에만 의존하도록 설계돼, Planner가 모든 과거 정보를 압축해 전달하도록 강제한다.

학습 단계는 두 부분으로 나뉜다. ① Supervised Fine‑Tuning(SFT)에서는 재구성 손실을 이용해 텍스트 yₖ와 디코더 출력의 교차 엔트로피를 최소화한다. 여기서 Gaussian noise를 잠재 상태에 주입해 디코더가 점별 매핑이 아니라 매니폴드 구조를 학습하도록 만든다. ② Reinforcement Learning(RL) 단계에서는 Planner 파라미터를 고정하고 Decoder만을 업데이트한다. Group Relative Policy Optimization(GRPO)이라는 변형 PPO를 적용해, 동일한 잠재 궤적에서 다양한 언어화 경로를 샘플링하고, 정답 여부와 포맷을 보상으로 사용한다. 이렇게 하면 탐색은 디코더 단계에서만 발생하므로, 잠재 플래닝의 안정성을 유지하면서도 답변 다양성을 확보한다.

추가적으로 논문은 “Lazy Decoding”이라는 효율적인 추론 전략을 제안한다. Planner가 생성한 잠재 궤적을 완전한 텍스트로 디코딩하지 않고, 각 단계에서 첫 토큰만을 빠르게 예측해 ‘답변 토큰(t_ans)’이 나오면 전체 디코딩을 수행하고, 그렇지 않으면 다음 잠재 상태를 생성한다. 이 방식은 중간 단계의 토큰‑바이‑토큰 비용을 크게 절감하면서도 필요 시 중간 사유를 텍스트로 복원할 수 있다.

실험은 GSM8K‑Aug 데이터셋을 사용해 GPT‑2(small) 백본 모델에 적용하였다. 결과는 두드러진 트레이드오프를 보여준다. Greedy(단일 샘플) 정확도는 기존 잠재 추론 모델보다 낮지만, Pass@k(다중 샘플) 스케일링 곡선이 더 가파르게 상승한다. 이는 PLaT가 보다 넓은 해답 공간을 탐색하도록 학습되었음을 의미한다. 또한, 잠재 상태를 직접 디코딩해 보면 인간이 이해 가능한 중간 사유를 확인할 수 있어, 투명성 측면에서도 장점을 가진다.

요약하면, PLaT는 (1) 사고와 언어화를 명확히 분리해 동적 종료와 효율적인 추론을 가능하게 하고, (2) 잠재 플래닝을 deterministic하게 유지해 구조적 안정성을 보장하며, (3) 디코더 단계에서의 탐색을 통해 다양하고 풍부한 답변을 생성한다는 점에서 기존 CoT 및 잠재 추론 방법을 확장한다.

댓글 및 학술 토론

Loading comments...

의견 남기기