의료 딥리서치 에이전트 DeepMed 다중 홉 검색과 단계 제어 학습

초록

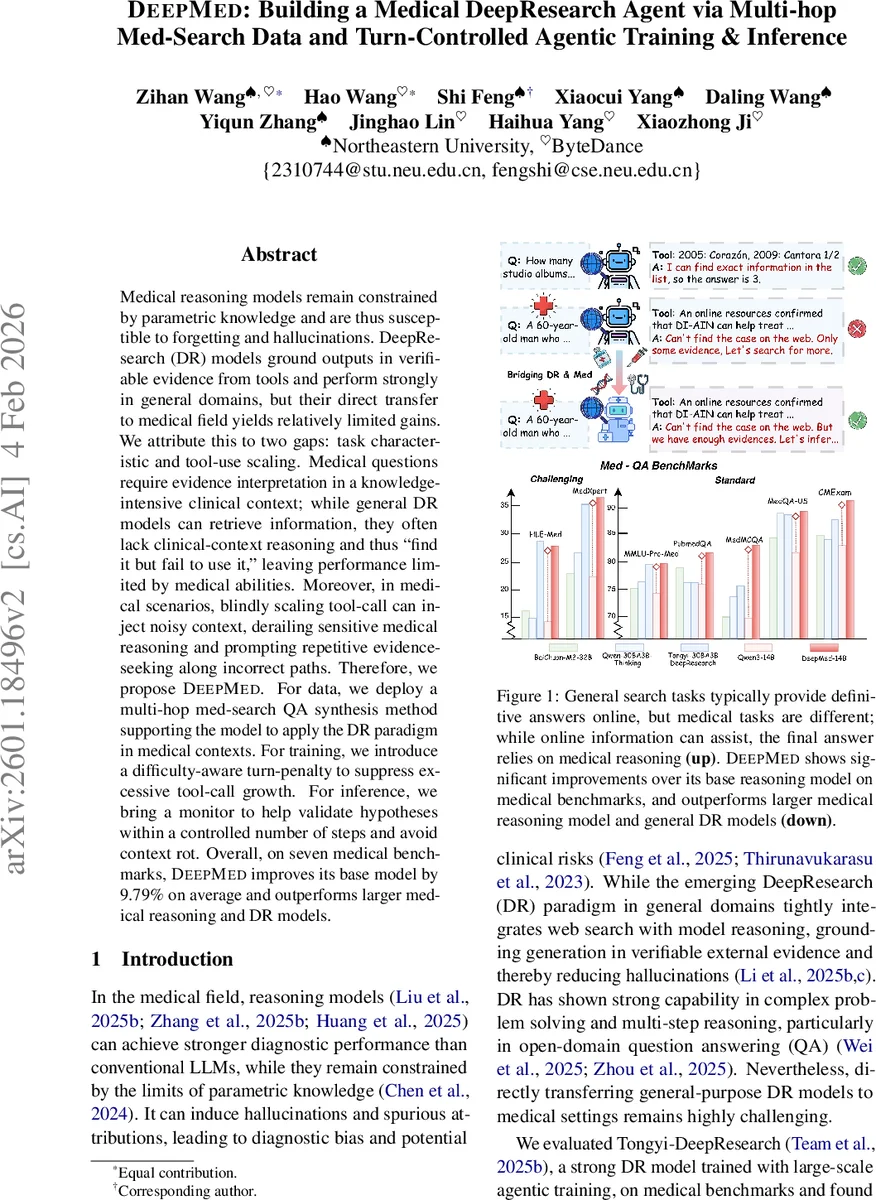

DeepMed은 의료 분야에 특화된 DeepResearch 모델로, 다중 홉 의료 검색 데이터를 활용한 SFT와 난이도 기반 턴 페널티를 적용한 RL을 결합한다. 추론 단계에서는 과도한 도구 호출을 방지하는 모니터링 메커니즘을 도입해 증거 기반 추론을 강화하고, 7개 의료 벤치마크에서 평균 9.79%의 성능 향상을 달성한다.

상세 분석

본 논문은 기존 일반 도메인 DeepResearch(DR) 모델을 의료 분야에 그대로 적용했을 때 나타나는 두 가지 근본적인 한계를 정확히 짚어낸다. 첫 번째는 작업 특성 불일치이다. 일반 DR 모델은 사실 기반 질의에 초점을 맞추어 검색·인용 단계는 잘 수행하지만, 의료 질문은 단순 사실 회수에 그치지 않고 임상적 의미 해석, 증거 간 충돌 판단, 그리고 의료 사전지식에 기반한 추론이 필수적이다. 따라서 “찾았지만 활용하지 못한다(find it but fail to use it)”는 현상이 발생한다. 두 번째는 도구 사용 규모 불일치이다. 일반 DR에서는 도구 호출을 늘릴수록 성능이 상승하는 경향이 있지만, 의료 상황에서는 과도한 검색이 잡음과 불필요한 컨텍스트를 축적해 ‘컨텍스트 로트(context rot)’를 야기한다. 특히 민감한 의료 정보는 오류 전파 위험이 크며, 반복적인 증거 검증 루프가 모델을 비효율적인 탐색으로 몰아넣는다.

DeepMed은 이러한 문제를 해결하기 위해 세 가지 핵심 설계를 제시한다. ① 다중 홉 의료 검색 QA 데이터 생성: 웹 기반 엔터티 체인을 구축하고, 엔티티 이름을 은폐한 형태로 질문을 설계해 모델이 도구 호출을 통해 숨겨진 정보를 복원하도록 강제한다. 체인 길이를 조절해 난이도를 다양화하고, GPT‑5·Gemini‑2.5‑pro 등 강력한 LLM을 활용해 논리적 일관성과 사실성을 검증한다. ② 난이도 인식 턴 페널티: Agentic Reinforcement Learning 단계에서, 정답을 얻었음에도 불구하고 과도한 턴을 사용한 경우 λ·r_turn 형태의 페널티를 부여한다. 쉬운 샘플은 최소한의 도구 호출을, 어려운 샘플은 적절히 더 많은 호출을 허용함으로써 도구 사용을 효율적으로 조절한다. ③ 과증거 모니터링: 추론 시 모델이 동일한 가설을 반복 검증하려 할 때, 사전에 정의된 턴 한계와 증거 중복 검사를 통해 호출을 중단하고 최종 답변을 출력하도록 한다. 이는 ‘over‑evidence’ 현상을 실시간으로 차단한다.

학습 파이프라인은 먼저 Agentic SFT(ASFT) 단계에서 다중 홉 QA 데이터를 이용해 도구 호출 패턴을 학습하고, 이후 Agentic RL(ARL) 단계에서 난이도 별 턴 페널티가 적용된 보상 함수를 통해 정책을 미세조정한다. 보상은 정답·형식·턴 세 요소를 결합해 1·(1‑λ·r_turn) 형태로 정의되며, KL 정규화는 제외해 정책 업데이트를 단순화한다.

실험 결과, DeepMed은 기본 모델인 Qwen3‑14B 대비 평균 9.79%(전체 7개 벤치마크) 향상을 보였으며, 특히 두 개의 고난이도 벤치마크에서는 13.92%의 개선을 기록한다. 파라미터 수가 더 큰 기존 의료 추론 모델이나 일반 DR 모델보다도 우수한 성능을 나타냈다. 또한, 증거 기반 추론을 통해 hallucination을 현저히 감소시켰으며, 과도한 검색으로 인한 컨텍스트 로트를 효과적으로 억제함을 정량적·정성적으로 입증했다.

이러한 설계는 의료 분야에서 LLM이 외부 지식을 안전하게 활용하도록 하는 중요한 전환점을 제공한다. 특히, 다중 홉 검색 데이터와 난이도 인식 도구 제어 메커니즘은 향후 다른 고위험 도메인(법률, 금융 등)에도 적용 가능성이 높다.

댓글 및 학술 토론

Loading comments...

의견 남기기