Mugi: 값 수준 병렬성으로 효율적인 대형 언어 모델 구현

초록

Mugi는 값 수준 병렬성(VLP)을 비선형 연산과 비대칭·소배치 GEMM에 적용해, 대형 언어 모델(LLM) 추론의 처리량·에너지 효율을 크게 향상시키고 탄소 배출까지 감소시키는 새로운 하드웨어 설계이다.

상세 분석

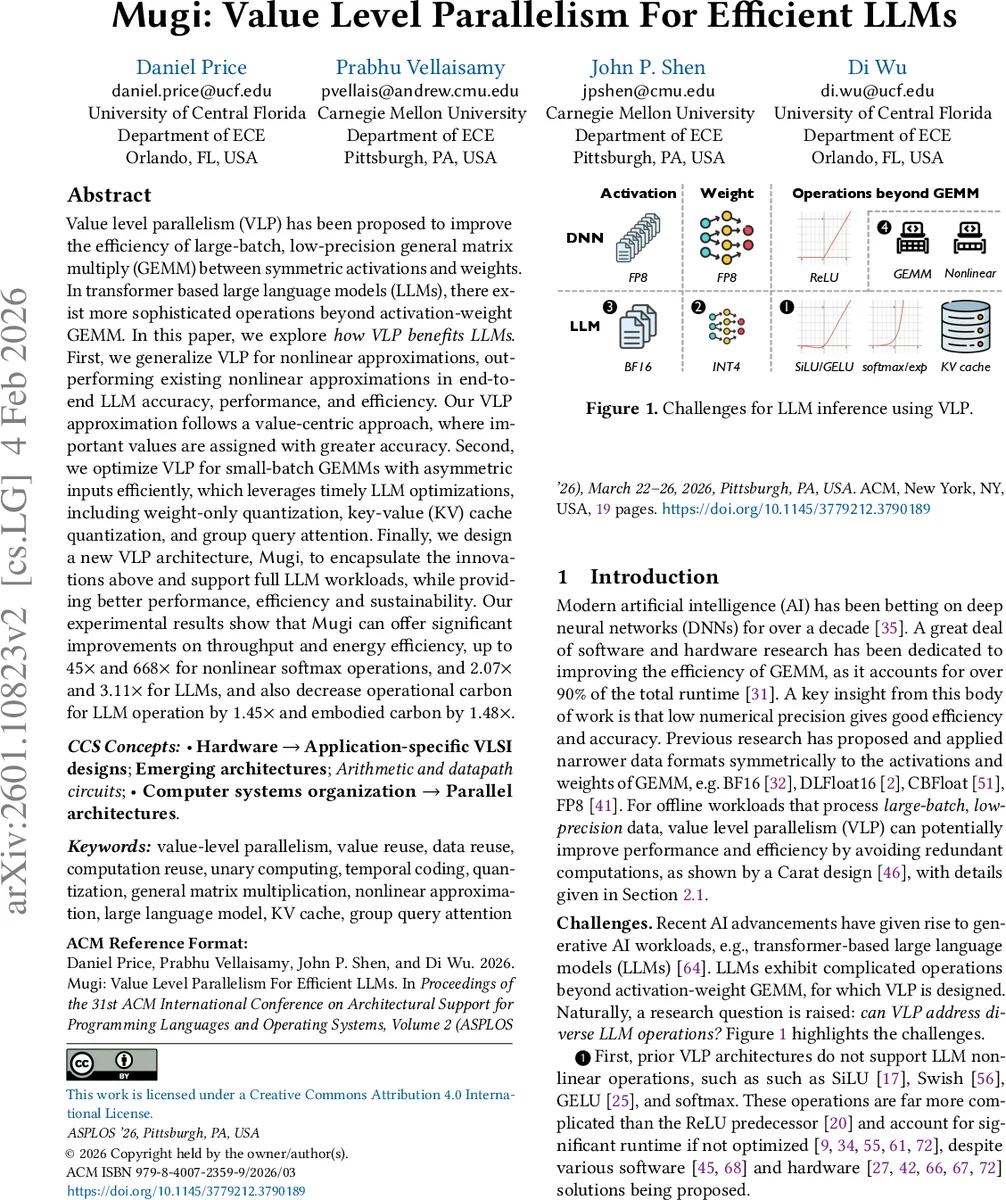

본 논문은 기존 VLP가 대규모 배치·대칭 저정밀 GEMM에만 최적화돼 LLM의 복잡한 비선형 연산(softmax, SiLU, GELU)과 비대칭 양자화(weight‑only, KV‑cache)에는 적용이 어려웠다는 점을 지적한다. 이를 해결하기 위해 Mugi는 네 가지 핵심 기술을 제안한다. 첫째, 입력 중심의 값‑중심 근사 방식을 도입해 입력의 부호·맨티사와 지수를 분리하고, 맨티사를 낮은 비트로 라운딩함으로써 temporal spike 길이를 단축한다. 동시에 지수값이 좁은 구간에 집중된다는 통계적 특성을 활용해 중요한 값에 더 높은 정확도를 할당한다. 둘째, LUT 기반의 VLP 근사를 두 단계(행 선택 → 열 선택)로 분해해 다수의 입력이 동일한 LUT 행을 공유하도록 설계하고, temporal converter를 이용해 맨티사와 지수 각각에 대한 temporal subscription을 구현한다. 이 과정에서 값 재사용(value reuse)과 temporal subscription이 병렬적으로 이루어져 연산량이 크게 감소한다. 셋째, 비대칭 BF16‑INT4 양자화와 그룹 쿼리 어텐션(GQA)을 고려한 작은 배치 GEMM 매핑을 제공한다. 가중치‑전용 양자화(WOQ)와 KV‑cache 양자화(KVQ)를 동시에 지원하면서, broadcasting과 output buffer leaning 기법으로 버퍼 비용을 최소화한다. 넷째, 비선형 연산과 GEMM을 동일한 배열 유닛에서 수행하도록 하드웨어를 통합함으로써 면적·전력·탄소 발자국을 크게 절감한다. 실험 결과, softmax와 같은 비선형 연산에서 최대 45배 처리량·668배 에너지 효율 향상을 달성했으며, 전체 LLM 추론에서는 2.07배 처리량·3.11배 에너지 효율 개선을 보였다. 또한 운영 탄소와 제조 탄소를 각각 1.45배·1.48배 감소시켰다. 이러한 성과는 VLP를 비선형 연산과 비대칭 양자화에 성공적으로 확장한 첫 사례로, 하드웨어·알고리즘 공동 설계가 LLM 효율성에 미치는 영향을 명확히 보여준다. 다만, temporal spike 기반 설계가 높은 클럭 주파수와 정밀한 타이밍 제어를 요구하므로 구현 복잡도가 증가할 가능성이 있으며, 더 큰 모델이나 다양한 토큰 길이에 대한 스케일링 검증이 추가로 필요하다.

댓글 및 학술 토론

Loading comments...

의견 남기기