BanglaIPA 방글라어 텍스트를 위한 강건한 IPA 전사 시스템

초록

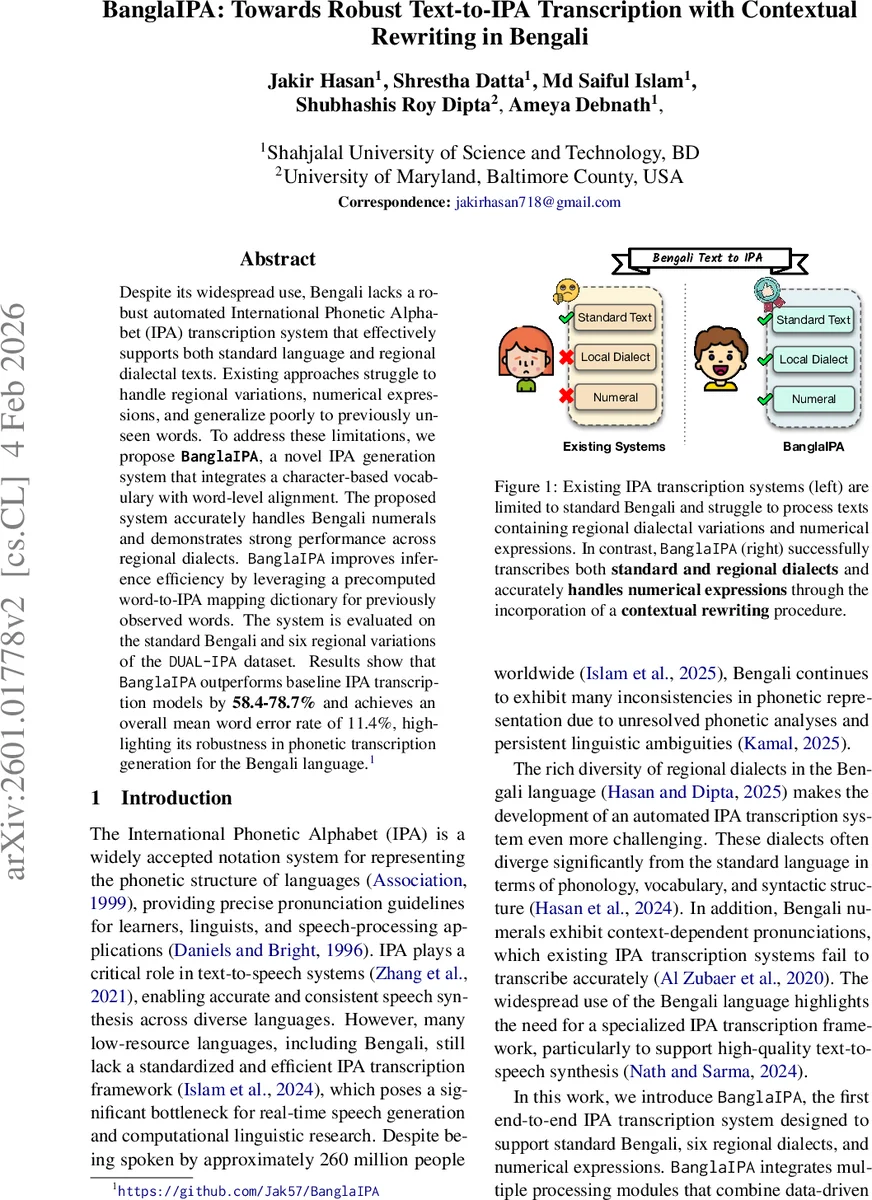

BanglaIPA는 문자 기반 어휘와 단어‑레벨 정렬을 결합한 엔드‑투‑엔드 IPA 전사 모델이다. 숫자 표현을 문맥에 따라 단어 형태로 재작성하고, STAT 알고리즘으로 OOV 서브워드를 분리해 Transformer 기반 모델에만 전달한다. 사전 구축된 Word‑IPA 사전을 활용해 추론 속도를 높이며, DUAL‑IPA 데이터셋의 표준 및 6개 방언에 대해 평균 11.4%의 WER를 달성해 기존 MT5·UMT5 대비 58‑78% 개선하였다.

상세 분석

본 논문은 방글라어의 표준 형태와 지역 방언, 그리고 숫자 표기까지 포괄적으로 처리할 수 있는 IPA 전사 시스템을 제안한다. 핵심 아이디어는 세 단계로 구성된다. 첫째, 숫자와 같은 문맥 의존 발음 요소를 LLM(GPT‑4.1‑nano)으로 문맥에 맞는 단어 형태로 재작성(contextual rewriting)한다. 이는 숫자 ‘১’이 “১ ডলার”(1 dollar)와 “১ম” (첫 번째)에서 발음이 달라지는 문제를 해결한다. 둘째, 재작성된 텍스트에서 중복을 제거하고 각 고유 단어를 키로, IPA 전사를 값으로 하는 사전을 구축한다. 새로운 단어가 등장하면 사전에 빈 엔트리를 만들고, 이후 처리 모듈이 채워 넣는다. 셋째, 사전에 없는 문자·기호가 포함된 경우를 대비해 STAT(State Alignment) 알고리즘을 도입한다. 미리 정의된 방글라어 문자 집합 C에 따라 단어를 서브워드로 분할하고, 각 서브워드에 ‘model‑required’ 플래그를 부여한다. 이렇게 하면 외래 문자나 특수 기호는 모델에 전달되지 않아 OOV 문제를 회피한다. 모델‑필요 서브워드는 문자 사이에 공백을 삽입해 벡터화하고, 8.6 M 파라미터를 가진 경량 Transformer(Encoder‑Decoder)로 IPA 시퀀스를 생성한다. 생성된 서브워드 IPA는 공백을 제거해 원본 형태로 복원하고, 사전의 기존 엔트리와 병합해 최종 단어‑IPA를 만든다. 이 파이프라인은 동일 단어에 대해 한 번만 모델 추론을 수행하므로 추론 효율성이 크게 향상된다. 실험에서는 DUAL‑IPA 데이터셋의 표준 및 6개 방언(치타곤, 키쇼레간지, 나라일, 나르싱디, 랑푸르, 탕갈) 테스트셋을 사용했으며, 기존 MT5(53.5% WER)와 UMT5(27.4% WER) 대비 평균 11.4%의 WER를 기록했다. 특히 랑푸르 방언에서 10.4%로 가장 낮은 오류율을 보였으며, 네 개 방언에서는 11% 수준을 유지해 지역 변이에도 강인함을 입증한다. 숫자 재작성 단계만 별도로 평가했을 때, LLM 없이 원문과 인간 검증 재작성문 사이의 WER가 27%였으나, LLM 적용 후 1.3%로 급격히 감소했다. 이는 downstream 전사 정확도에 결정적 영향을 미친다. 제한점으로는 훈련 데이터가 6개 방언에 국한돼 있어 미포함 방언에 대한 일반화가 떨어질 수 있고, LLM 기반 재작성 단계가 추가 연산 비용을 유발한다는 점을 언급한다. 향후 연구에서는 방언 커버리지를 확대하고, 경량화된 자체 언어 모델을 도입해 재작성 비용을 낮추는 방향을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기