음절 기반 토큰화로 효율적인 대규모 음성 언어 모델 구현

초록

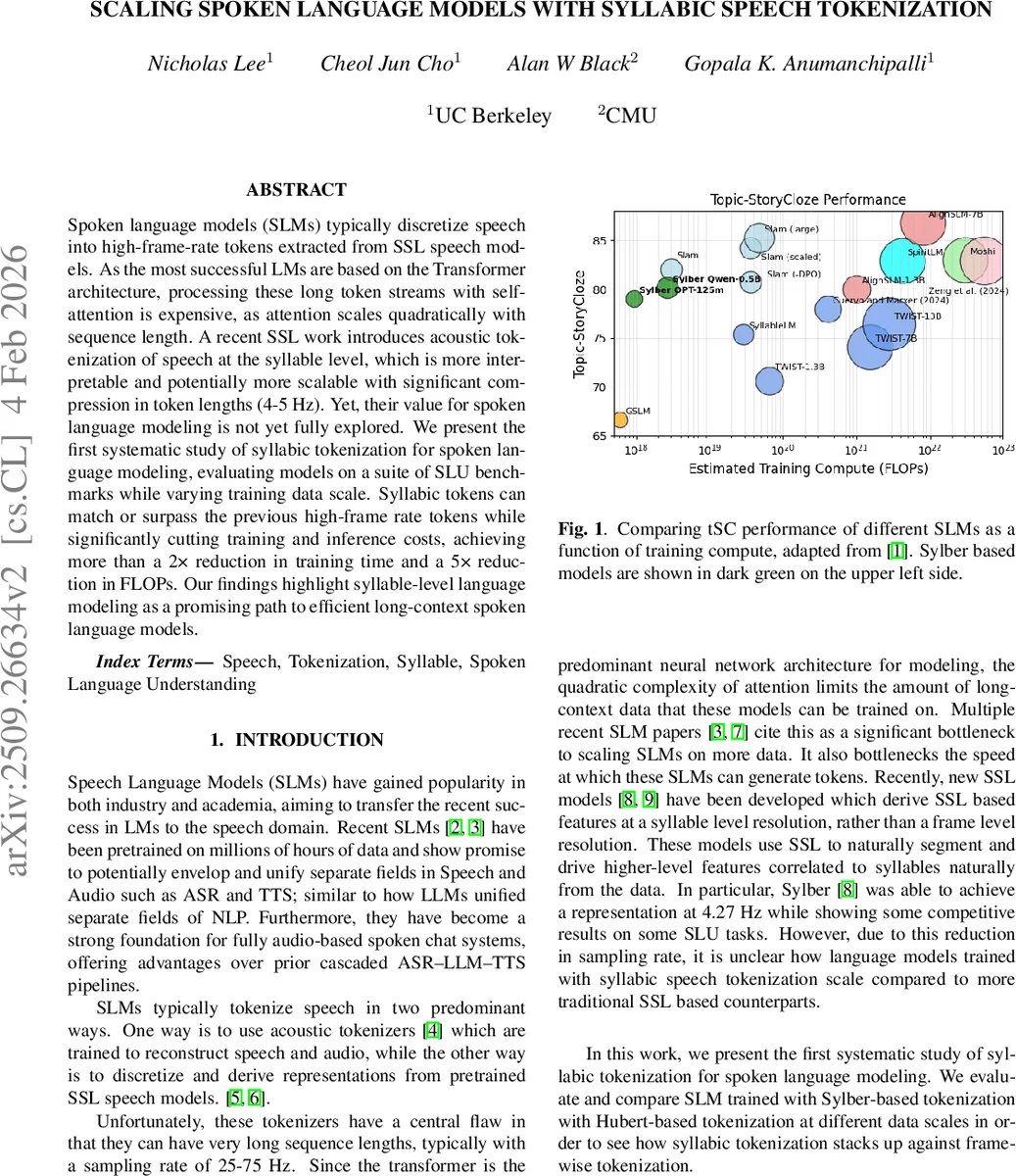

본 논문은 프레임 수준의 고속 토큰 대신 4‑5 Hz의 음절 수준 토큰(Sylber)을 사용해 spoken language model(SLM)을 학습하고, 동일하거나 더 나은 SLU 성능을 유지하면서 학습 시간 2배, FLOPs 5배 절감함을 실증한다. 다양한 데이터 규모와 어휘 크기를 실험해 음절 토큰화가 효율적인 장기 컨텍스트 모델링에 유망함을 보여준다.

상세 분석

이 연구는 최근 SSL 기반 음성 모델에서 음절 단위의 표현을 추출하는 Sylber를 토큰화에 적용함으로써, 전통적인 Hubert‑based 토큰화가 갖는 “프레임당 25‑75 Hz”라는 높은 시퀀스 길이 문제를 근본적으로 해결한다는 점에서 의미가 크다. Transformer 기반 SLM은 self‑attention 연산이 O(N²) 복잡도를 가지므로, 토큰 수가 5배 감소하면 메모리와 연산량이 급격히 감소한다. 논문은 Sylber 토큰을 k‑means 클러스터링(5k, 10k, 20k, 40k)으로 양자화하고, 이를 OPT‑125M과 Qwen2.5‑0.5B 두 규모의 베이스 모델에 TWIST‑style 초기화로 적용했다.

실험 설계는 세 단계의 데이터 스케일(LibriSpeech → LibriSpeech+LibriLight → LibriSpeech+LibriLight+Spoken TinyStories)로 진행되어, 토큰 수가 Hubert 대비 5배 적음에도 불구하고 sBLIMP, sSC, tSC 등 네 가지 SLU 벤치마크에서 동등하거나 우수한 성능을 보였다. 특히 sBLIMP(문법 판단)에서는 Sylber가 모든 데이터 포인트에서 Hubert를 앞섰으며, 이는 음절 수준 토큰이 의미론적·구문적 정보를 더 압축적으로 담고 있음을 시사한다.

성능 추세를 보면, Sylber‑20k 어휘가 전반적으로 가장 안정적인 결과를 제공했으며, 어휘 크기를 늘려도 큰 변동이 없었다. 이는 k‑means 기반 양자화가 현재 음절 공간을 충분히 커버하고 있음을 의미한다. 또한, GenPPL(생성 퍼플렉시티)에서는 Sylber 모델이 더 급격히 수렴하는 경향을 보여, 학습 효율성이 높음을 확인한다.

하드웨어 측면에서는 8×A100‑80GB DGX 클러스터에서 전체 Hubert‑based 모델이 8.5시간 소요된 반면, Sylber‑20k 모델은 3시간에 학습을 마쳤다. FLOPs 기준 5배 절감은 실제 서비스 환경에서 비용 절감과 실시간 응답성 향상으로 직결된다.

결과적으로, 음절 수준 토큰화는 “긴 컨텍스트, 저비용”이라는 두 마리 토끼를 동시에 잡을 수 있는 전략이며, 향후 멀티모달(음성‑텍스트) 통합 모델이나 초대규모 음성 데이터에 대한 스케일링 법칙 적용에 중요한 기반을 제공한다. 다만, 현재는 k‑means 기반 양자화가 최적이 아닐 수 있으므로, 보다 정교한 클러스터링 혹은 비지도 학습 기반 토큰화 기법이 추가 연구 과제로 남는다.

댓글 및 학술 토론

Loading comments...

의견 남기기