대규모 학습 데이터가 필요하지만 다중 홉 암시적 추론을 배울 수 있다

초록

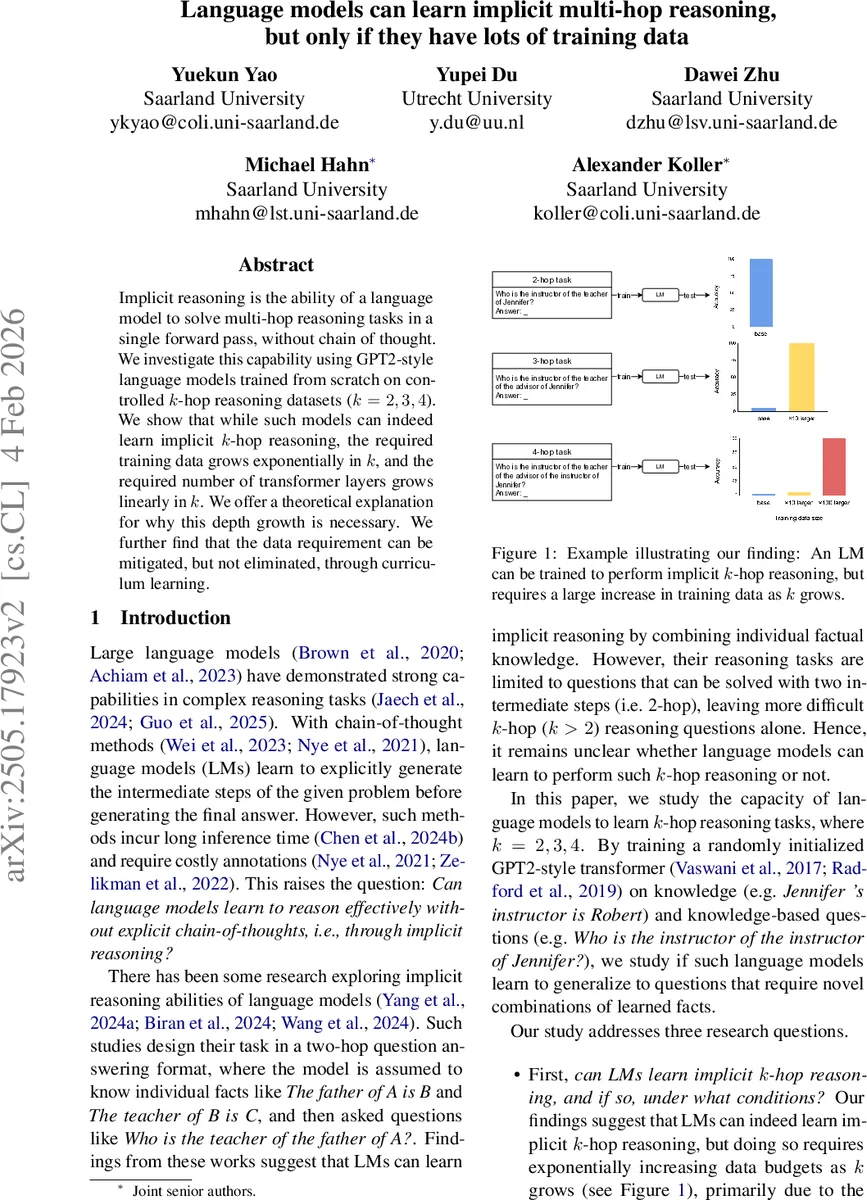

본 논문은 GPT‑2 스타일 트랜스포머를 처음부터 학습시켜 2‑, 3‑, 4‑홉 지식 기반 추론 과제를 수행하도록 하고, 암시적 다중 홉 추론이 가능함을 보인다. 그러나 필요한 학습 데이터 양은 홉 수 k가 증가함에 따라 지수적으로 늘어나며, 모델 깊이(레이어 수)는 k에 비례해 선형적으로 증가해야 한다. 커리큘럼 학습을 통해 데이터 요구량을 완화할 수 있지만, 완전히 없앨 수는 없다.

상세 분석

이 연구는 “암시적 추론(implicit reasoning)”이라는 개념을 명확히 정의하고, 이를 검증하기 위해 합성된 k‑hop 데이터셋(k = 2, 3, 4)을 구축하였다. 각 데이터셋은 (엔티티 프로필 + 질문) 형태로 구성되며, 엔티티 프로필은 해당 엔티티에 대한 모든 1‑hop 사실을 한 문단에 나열한다. 질문은 “~의 ~의 ~은 누구인가?”와 같은 자연어 템플릿으로 제시되고, 정답은 k 단계 관계를 순차적으로 적용한 결과 엔티티이다.

모델은 가장 작은 GPT‑2(12 레이어) 구조에 RoPE 위치 임베딩을 적용하고, 엔티티 이름을 vocab에 추가한 뒤, 인과 언어 모델링 손실을 최소화하도록 학습한다. 실험에서는 학습 단계는 20 k(4‑hop large은 40 k)로 고정하고, 데이터 규모를 배경(basic budget) 대비 ×1, ×2, ×5, ×10, ×20, ×50, ×100 등으로 확대한다. 결과는 다음과 같다.

-

암시적 k‑hop 추론 가능성: 충분히 큰 데이터 예산을 제공하면 모델은 2‑hop뿐 아니라 3‑hop, 4‑hop에서도 100 % 정확도를 달성한다. 이는 모델이 중간 엔티티를 명시적으로 생성하지 않아도, 입력‑출력 쌍만으로 복합 관계를 내부적으로 학습한다는 강력한 증거다.

-

데이터 요구량의 지수적 증가: k가 2→3→4로 증가할 때 필요한 데이터 양은 각각 최소 ×5, ×10, ×20(소규모) 혹은 ×10, ×100(대규모) 정도로 급격히 늘어난다. 이는 가능한 사실 조합 수가 |R|^k 로 폭발하기 때문에 발생한다.

-

모델 깊이와 선형 관계: 4‑hop 작업을 성공적으로 학습하려면 최소 12 레이어가 필요했으며, 레이어 수를 k에 비례해 늘리면 중간 홉을 단계별로 처리하는 “layer‑wise” 패턴이 관찰된다. 저층은 1‑hop, 중간층은 2‑hop 등을 담당하며, 이는 논문이 제시한 정리 5.1의 이론적 하한과 일치한다.

-

커리큘럼 학습의 효과: m‑hop(m < k) 과제를 먼저 학습하고 점진적으로 k‑hop을 도입하면, 동일 정확도를 달성하는 데 필요한 데이터 양을 크게 절감할 수 있다. 단순히 m‑hop과 k‑hop을 섞어 학습시키는 방식은 효과가 미미했다.

-

해석 가능성: 내부 활성화 분석을 통해 각 레이어가 특정 홉의 중간 엔티티를 “예측”하는 모습을 확인했으며, 이는 이전 연구(Biran et al., 2024; Wang et al., 2024)와 일관된다.

결론적으로, 암시적 다중 홉 추론은 이론적으로 가능하지만, 실제 적용을 위해서는 데이터와 모델 규모를 크게 확장해야 하며, 커리큘럼 학습이 현실적인 완화책이 된다.

댓글 및 학술 토론

Loading comments...

의견 남기기