LLM‑ABBA: 심볼릭 시계열을 대형 언어 모델에 접목한 혁신적 분석 프레임워크

초록

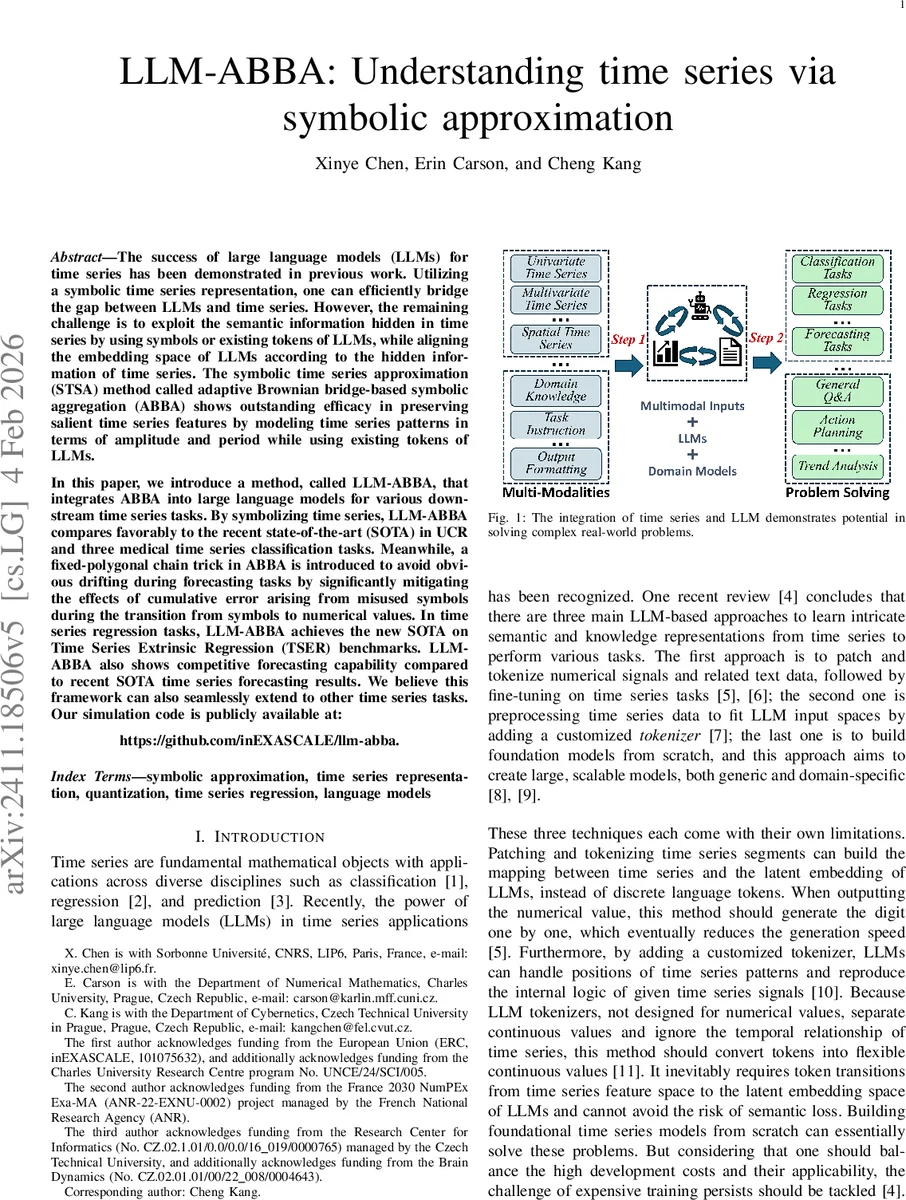

본 논문은 적응형 브라운니안 브릿지 기반 심볼릭 집계(ABBA) 기법을 대형 언어 모델(LLM)과 결합한 LLM‑ABBA를 제안한다. 시계열을 압축·심볼화하여 LLM 토큰으로 변환하고, QLoRA 어댑터 파인튜닝을 통해 분류, 회귀, 예측 등 다양한 다운스트림 작업에서 기존 최첨단(SOTA) 성능을 달성한다. 특히 고정 다각형 체인(Fixed‑Polygonal Chain) 기법을 도입해 장기 예측 시 누적 오류를 크게 감소시켰다.

상세 분석

LLM‑ABBA는 시계열 데이터를 두 단계, 압축(Compression)과 디지털화(Digitization)로 변환한다. 압축 단계에서는 적응형 다각형 체인 근사(APCA)를 이용해 원본 시계열을 구간 길이(len)와 증분(inc)으로 표현하고, 허용 오차(tol)에 따라 구간 수 N을 자동 조정한다. 이때 각 구간은 시작점과 끝점 사이를 직선으로 연결한 뒤, 브라운니안 브릿지 모델을 적용해 재구성 오차를 이론적으로 상한한다. 디지털화 단계에서는 클러스터링을 통해 각 구간을 고유 심볼에 매핑하고, 이 심볼을 사전 정의된 문자열 혹은 LLM의 기존 토큰과 일치시킨다. 이렇게 생성된 심볼 시퀀스는 LLM의 입력으로 그대로 사용될 수 있어 별도의 맞춤형 토크나이저가 필요 없으며, LLM은 자연어와 동일한 방식으로 시계열 패턴의 체인‑오브‑패턴(COP)을 학습한다.

모델 학습에는 QLoRA 기반 어댑터 파인튜닝을 적용한다. 이는 전체 파라미터를 업데이트하지 않고 저차원 어댑터만 학습함으로써 메모리와 연산 비용을 크게 절감하면서도 도메인 특화 성능을 확보한다. 분류 작업에서는 심볼 시퀀스 자체만으로 라벨을 예측하고, 회귀·예측 작업에서는 심볼 시퀀스를 다음 토큰 예측 문제로 전환한다. 특히 예측 단계에서 발생할 수 있는 심볼‑수치 변환 누적 오차를 방지하기 위해 고정 다각형 체인(Fixed‑Polygonal Chain) 트릭을 도입했다. 이는 재구성 시 각 구간의 시작값을 고정하고, 이전 구간의 오류가 다음 구간에 전파되지 않도록 설계돼, 장기 예측 시 드리프트를 현저히 감소시킨다.

실험 결과는 UCR 타임시리즈 아카이브와 세 개의 의료 시계열 분류 데이터셋에서 기존 SOTA 모델들을 능가함을 보여준다. 또한 TSER(Time Series Extrinsic Regression) 벤치마크에서는 새로운 최고 성능을 기록했으며, 다중 단계 예측에서도 최신 예측 모델들과 경쟁 가능한 정확도를 달성했다. 코드와 데이터는 공개 저장소에 제공되어 재현성을 확보했다.

한계점으로는 ABBA의 하이퍼파라미터(tol, α 등) 선택이 성능에 큰 영향을 미치며, 매우 긴 시계열에 대해 심볼 수가 급증할 경우 토큰 길이 제한에 부딪힐 수 있다. 또한 심볼화 과정에서 미세한 수치 변동이 손실될 위험이 존재한다. 향후 연구에서는 자동 하이퍼파라미터 튜닝, 심볼 압축을 위한 추가 언어 모델 기반 사전학습, 그리고 실시간 스트리밍 시계열에 대한 온라인 업데이트 메커니즘을 탐색할 예정이다.

댓글 및 학술 토론

Loading comments...

의견 남기기