Aster: 20배 빠른 자율 과학 발견 AI

초록

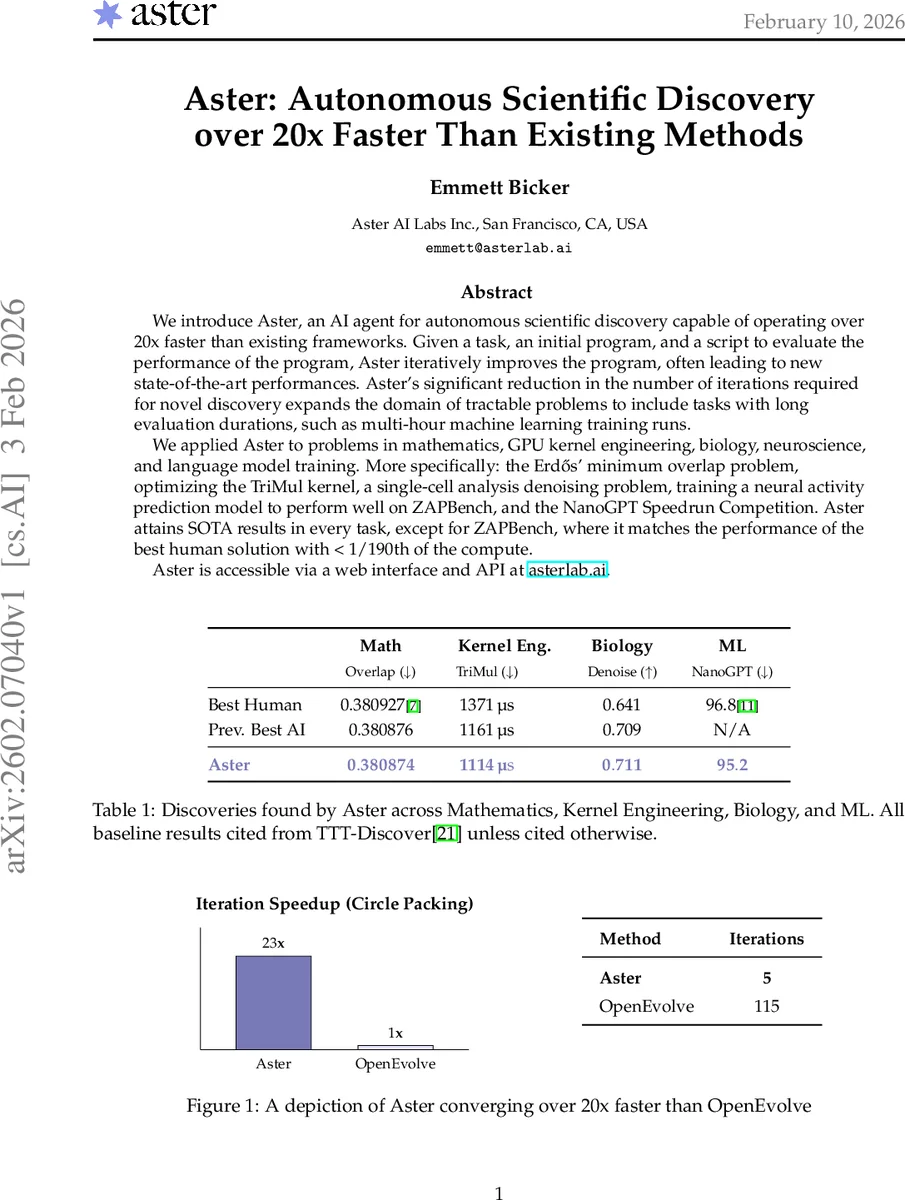

Aster는 초기 프로그램과 평가 스크립트를 입력받아 LLM 기반 반복 개선을 수행하는 자율 과학 탐색 에이전트이다. 기존 오픈소스 프레임워크인 OpenEvolve 대비 20배 이상 적은 반복 횟수로 목표 성능에 도달하며, 수학, GPU 커널 최적화, 단일세포 데이터 디노이징, 뉴런 활동 예측, NanoGPT 속도 경신 등 다섯 분야에서 최신 결과를 기록한다. 특히 수시간 걸리는 모델 학습 작업에서도 190배 적은 연산량으로 인간 수준 성능을 재현한다.

상세 분석

Aster의 핵심 설계는 “프롬프트 → LLM → 코드 → 평가 → 데이터베이스 저장 → 반복”이라는 순환 구조이다. 기존 시스템이 수백수천 번의 반복을 필요로 하는 반면, Aster는 평가 비용이 높은 작업에서도 58번의 반복만으로 목표 성능에 도달한다. 이는 두 가지 기술적 혁신에 기인한다. 첫째, Aster는 기본 LLM 모델을 Gemini 2.0 Flash와 Claude 3.7 Sonnet의 혼합 비율(80 % / 20 %)로 구성해, 코드 생성 단계에서 높은 품질과 다양성을 확보한다. 둘째, Aster는 “Iteration Speedup” 모듈을 도입해 각 반복에서 후보 프로그램을 다중 샘플링하고, 성능 예측 모델을 활용해 가장 유망한 후보만을 실제 평가에 투입한다. 이 과정에서 불필요한 평가를 크게 줄여 전체 탐색 비용을 감소시킨다.

성능 평가에서는 전통적인 자동 발견 벤치마크인 26‑원형 패킹 문제를 사용해 OpenEvolve(115 iteration) 대비 Aster는 5 iteration만에 동일 수준(2.6353) 이상의 점수를 얻었으며, 6 iteration에 최첨단(2.635983) 점수를 근접했다. 수학 분야에서는 Erdős 최소 겹침 문제에서 기존 0.380876 → 0.380874 로 미세 개선했으며, 8192개의 구간을 사용해 해의 정밀도를 크게 높였다. GPU 커널 최적화에서는 TriMul 커널을 H100에서 1114 µs 로 단축해 기존 1161 µs 대비 4 % 개선했다. 단일세포 RNA‑seq 디노이징에서는 평균 점수 0.711( MSE 0.150, Poisson 0.049) 로 기존 0.709보다 우수했으며, 특히 MSE 감소가 두드러졌다. NanoGPT Speedrun에서는 8 iteration에 95.2 s 로 1.6 % 속도 향상을 달성, 이전 AI 시스템(Hiverge, Locus)보다 높은 개선률을 기록했다. 마지막으로 ZAP‑Bench에서는 34 iteration(≈2.5 일)만에 인간 최고 성능 MAE 0.0182 를 재현했으며, 이는 190배 적은 연산량에 해당한다.

한계점으로는 평가 스크립트가 반드시 재현 가능하고 자동화 가능해야 한다는 점, 그리고 현재 LLM에 의존하는 코드 생성 품질이 모델 업데이트에 따라 변동될 수 있다는 점을 들 수 있다. 또한, Aster가 제시한 솔루션은 종종 고차원 파라미터(예: 8192 구간)로 복잡해져 해석적 이해가 어려워질 수 있다. 향후 연구에서는 메타‑학습 기반의 평가 비용 예측, 다중 목표 최적화, 그리고 생성된 코드의 형식적 검증을 결합해 신뢰성을 높이는 방향이 제시된다.

댓글 및 학술 토론

Loading comments...

의견 남기기