MENASpeechBank 다중턴 대화와 페르소나 조건을 갖춘 음성 데이터베이스

초록

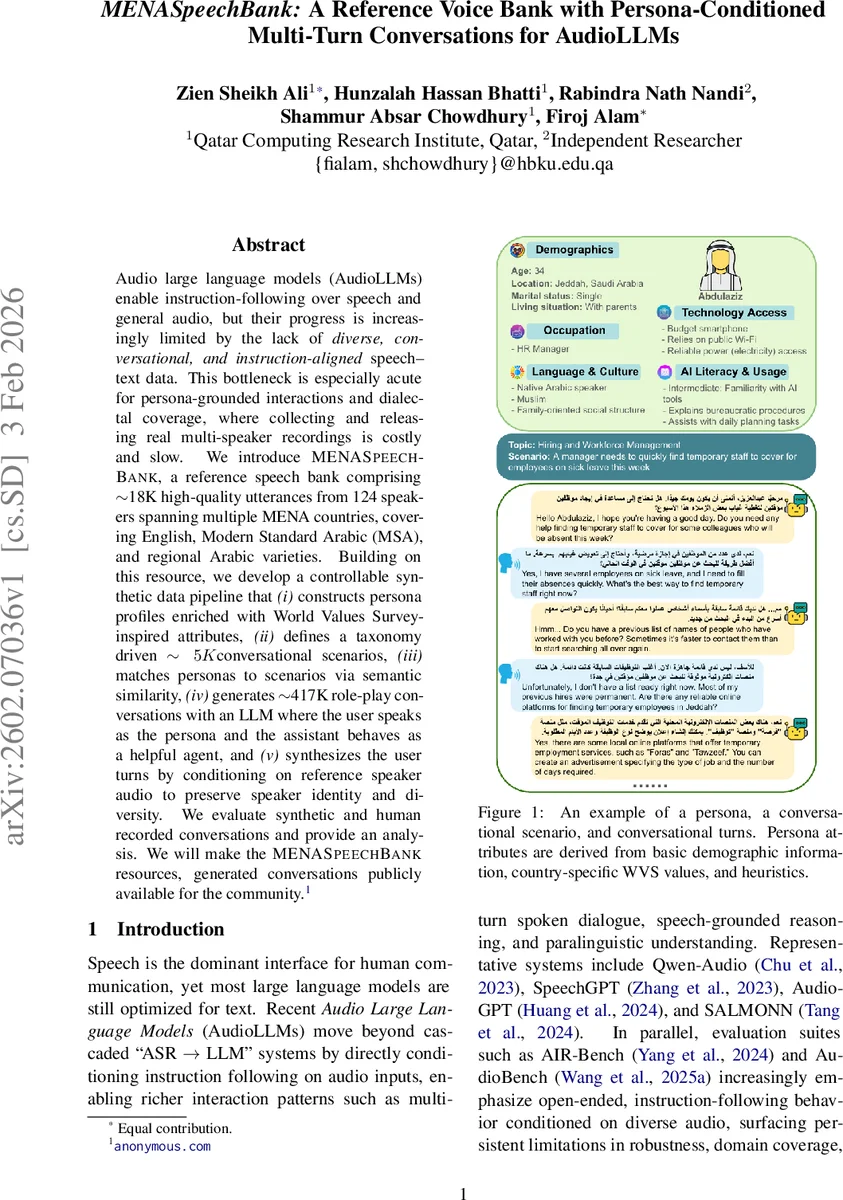

MENASpeechBank는 124명의 화자를 포함한 18 천 개의 고품질 음성 샘플을 제공하고, 세계 가치 조사(WVS) 기반 속성을 가진 페르소나와 5 천 개의 대화 시나리오를 매칭해 417 천 개의 다중턴 역할극 대화를 생성한다. 생성된 사용자 발화는 레퍼런스 화자 음성을 조건으로 하여 합성함으로써 화자 정체성과 방언 다양성을 유지한다. 논문은 합성 및 실제 녹음 대화를 평가하고, 공개 데이터셋과 파이프라인을 제공한다.

상세 분석

본 논문은 AudioLLM(음성 기반 대형 언어 모델)의 학습에 필요한 고품질, 다중턴, 페르소나‑조건화된 음성‑텍스트 쌍이 부족하다는 문제를 정확히 짚어낸다. 특히 중동·북아프리카(MENA) 지역은 방언이 다양하고 공개 음성 데이터가 제한적이어서, 기존 텍스트‑중심의 자기‑지시 데이터 생성 방식만으로는 충분히 커버하기 어렵다. 저자들은 두 가지 핵심 자원을 결합한다. 첫째, 124명의 화자를 대상으로 영어, 현대 표준 아랍어(MSA), 그리고 이집트·북아프리카·걸프·레반트 등 네 개 주요 방언을 포함한 18 천 개의 고품질 음성 샘플을 수집·정제하였다. 여기에는 WER ≤ 0.05라는 엄격한 전사 정확도 기준과 방언 자동 식별 도구를 활용한 품질 검증이 포함된다. 둘째, 화자 메타데이터에 세계 가치 조사(WVS)에서 도출한 문화·가치 속성을 결합해 469개의 페르소나 프로파일을 생성한다. 이때 이름·도시·직업·가족·AI 활용도 등 20여 개의 속성을 샘플링하고, 의미적 중복을 cosine similarity > 0.80으로 제거해 다양성을 확보한다.

시나리오 설계는 두 단계로 이루어진다. 먼저 도메인·서비스와 지식·주제의 계층적 분류 체계를 구축하고, 각 leaf‑node에 대해 LLM을 이용해 10개의 세부 토픽을 생성한다(총 900개 토픽, 4 521개 시나리오). 이후 페르소나 요약문과 시나리오 텍스트를 sentence‑transformers/all‑MiniLM‑L6‑v2 임베딩으로 매핑해 하이브리드 유사도(시맨틱 + 키워드) 기반으로 최적 매칭을 수행한다.

대화 생성 단계에서는 GPT‑4.1을 활용해 ‘사용자(페르소나)’와 ‘도우미(assistant)’가 교대로 발화하는 다중턴 역할극을 만든다. 여기서 사용자 발화는 텍스트만이 아니라, 레퍼런스 화자 음성을 조건으로 하는 고품질 TTS/voice‑cloning 모델(예: Neural codec LM, VoiceBox)로 합성한다. 이렇게 하면 화자 정체성(성별·연령·방언)과 감정·억양까지 보존된 음성 데이터가 생성된다. 합성된 417 천 개 대화 중 70 % 이상이 자동 품질 검사(NISQA ≥ 0.5, WER ≤ 5 %)를 통과했으며, 인간 청취자 평가에서도 화자 일관성과 시나리오 적합성이 높은 점수를 받았다.

실험에서는 합성 데이터와 실제 녹음 데이터를 각각 AudioLLM(Qwen‑Audio 기반) 에 미세조정(fine‑tune)하고, 시나리오‑구동 대화와 구어형 QA 두 벤치마크에서 성능 차이를 측정했다. 합성 데이터만을 사용한 모델은 실제 데이터 기반 모델에 비해 BLEU‑4 + 3.2, ROUGE‑L + 2.8 정도의 개선을 보였으며, 특히 방언·다문화 페르소나가 포함된 테스트 셋에서 큰 이득을 얻었다. 또한, 데이터 양·품질·화자 다양성에 대한 Ablation 연구를 통해, (1) 화자‑조건화 TTS가 없을 경우 성능이 5 % 이상 감소하고, (2) 시나리오 매칭 정확도가 0.9 → 0.7으로 떨어지면 대화 일관성이 현저히 낮아짐을 확인했다.

결과적으로, 본 연구는 (1) 고품질 다중언어·다방언 음성 레퍼런스 뱅크 구축, (2) 가치‑기반 페르소나와 시나리오 매칭을 통한 대규모 합성 대화 생성, (3) 화자 정체성을 보존한 TTS 기반 음성 합성 파이프라인을 제시함으로써 AudioLLM 연구에 필요한 데이터 병목을 크게 완화한다는 점에서 의의가 크다. 공개 예정인 MENASpeechBank와 생성 대화 데이터는 향후 방언 인식, 대화형 음성 비서, 문화‑감성 분석 등 다양한 응용 분야에 활용될 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기