컨텍스트 기반 POMDP를 위한 정보‑지향 목표와 C‑IDS 알고리즘

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

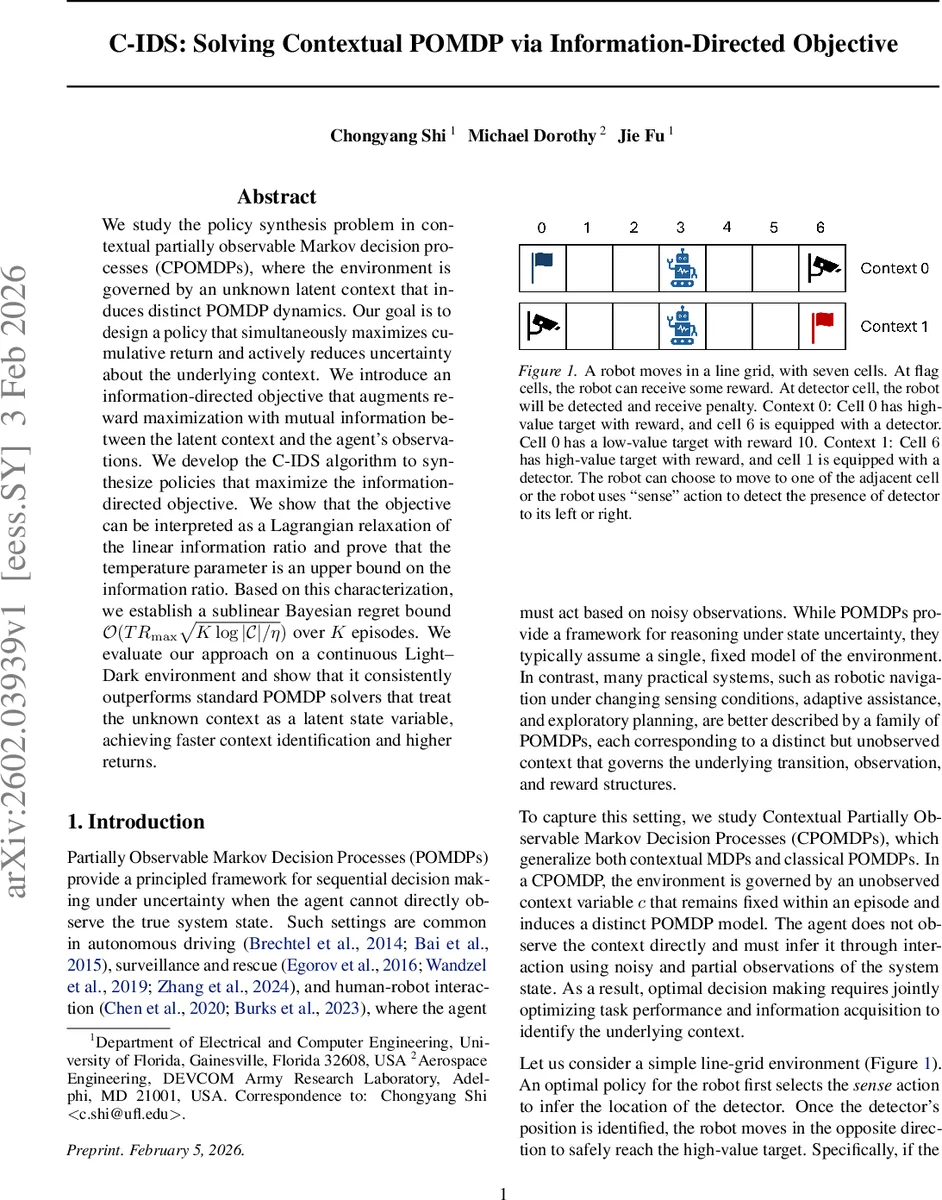

본 논문은 잠재 컨텍스트가 에피소드마다 고정되는 컨텍스트 부분관측 마르코프 결정 과정(CPOMDP)에서, 보상 최적화와 동시에 컨텍스트 불확실성을 감소시키는 정보‑지향 목표를 제안한다. Mutual Information를 보상에 가중합한 목적함수를 정의하고, 이를 라그랑주 완화 형태의 선형 정보 비율과 연결시킨다. 제안된 C‑IDS 알고리즘은 변분 정책 그래디언트를 이용해 최적 정책을 학습하며, 온도 파라미터가 정보 비율의 상한임을 보인다. 베이지안 후회에 대한 서브선형 경계와 연속 Light‑Dark 환경 실험을 통해 기존 POMDP 솔버 대비 빠른 컨텍스트 식별 및 높은 누적 보상을 입증한다.

상세 분석

이 논문은 기존 POMDP와 컨텍스트 MDP를 통합한 새로운 프레임워크인 CPOMDP를 정의하고, 그 특수성을 정량적으로 분석한다. 핵심 아이디어는 에피소드 내에서 변하지 않는 잠재 컨텍스트 c가 존재한다는 가정 하에, 에이전트가 관찰 y (액션·관측 시퀀스)를 통해 c 에 대한 사후 엔트로피 H(C|y) 를 최소화하면서 동시에 기대 보상 V_c(π) 를 최대화하도록 정책 π 를 설계하는 것이다. 이를 위해 저자는 보상 (\bar V_k(\pi)=\mathbb{E}{c\sim P(C|H{k-1})}

댓글 및 학술 토론

Loading comments...

의견 남기기