경계 인식 증거 선택으로 강인한 RAG 구현

초록

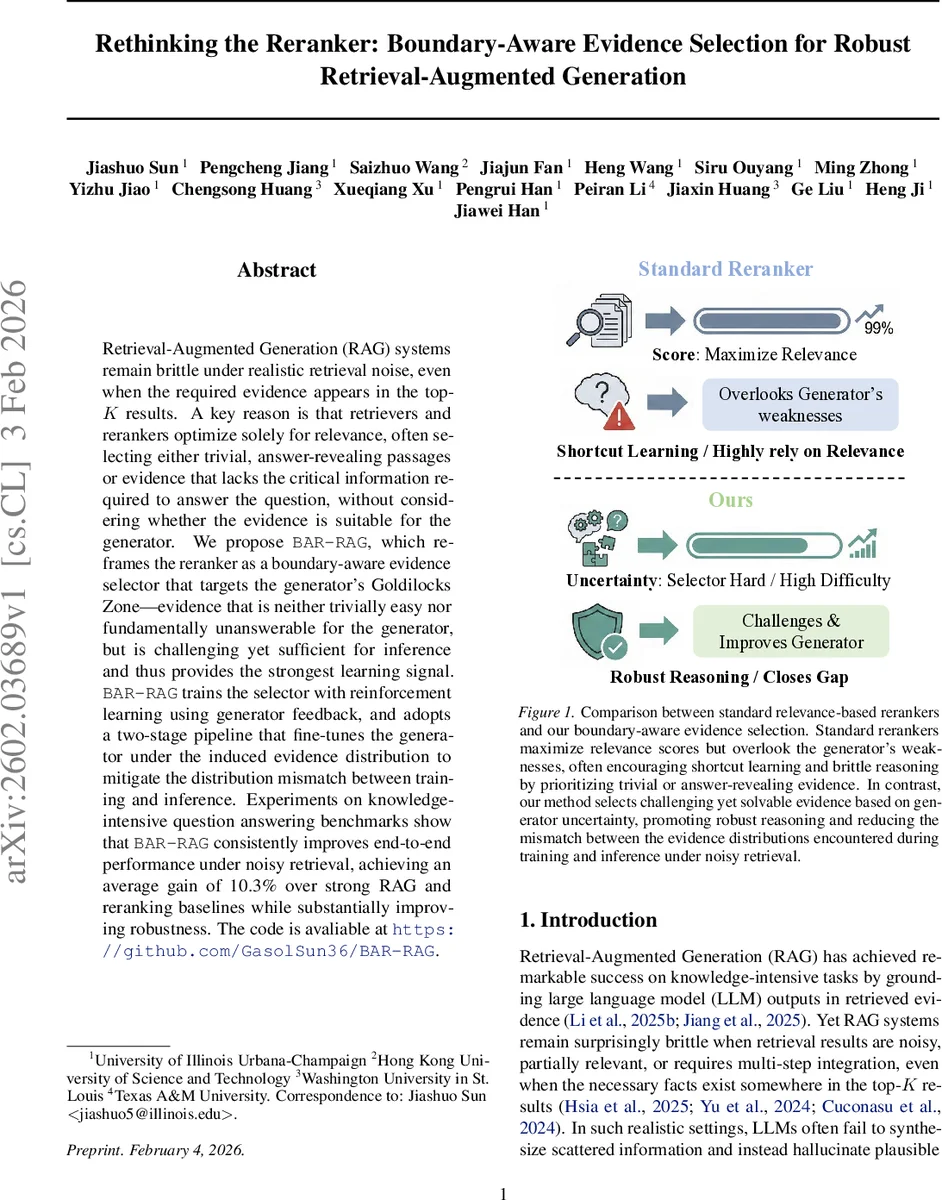

본 논문은 기존 RAG 시스템이 검색 노이즈에 취약한 원인을 재검토하고, 재랭커를 “경계 인식 증거 선택기”로 전환한다. 생성기의 학습·추론에 가장 적합한, 즉 너무 쉬워도 안 되고 완전히 풀 수 없지도 않은 ‘Goldilocks Zone’의 증거를 강화학습으로 탐색한다. 두 단계 파이프라인(증거 선택기 학습 → 선택된 증거에 대한 생성기 미세조정)으로 구성해 훈련‑테스트 불일치를 해소하고, 다양한 지식‑집중 QA 벤치마크에서 평균 10.3%p의 성능 향상과 강인성을 입증한다.

상세 분석

RAG(검색‑증강 생성) 시스템은 최근 대형 언어 모델(LLM)의 외부 지식 활용을 가능하게 했지만, 실제 서비스 환경에서는 검색 결과에 노이즈가 섞이거나 부분적으로만 관련된 문서가 상위 K에 포함되는 경우가 빈번하다. 기존의 재랭커는 “관련성 점수 최대화”라는 단일 목표에만 집중해, (1) 정답을 직접 포함하는 지나치게 쉬운 문서를 선택하거나, (2) 핵심 정보를 충분히 제공하지 못하는 불충분한 문서를 선택하는 두 가지 실패 모드를 만든다. 이러한 선택은 생성기가 “단순 패턴 매칭”에 의존하도록 만들고, 복합적인 추론 능력을 키우지 못하게 한다는 점이 본 논문의 핵심 비판이다.

BAR‑RAG는 재랭커를 “경계 인식 증거 선택기”로 재정의한다. 여기서 ‘경계’는 생성기의 현재 능력(정답을 맞출 확률)과 연관된다. 구체적으로, 증거 집합 S에 대해 생성기가 K번 롤아웃을 수행해 정답 확률 ˆp(S)를 추정하고, 목표 정확도 c(예: 0.5)와 가장 가까운 증거를 보상한다. 이때 삼각형 형태의 경계 보상 R_bdy(S)=min{ˆp(S)/c, (1‑ˆp(S))/(1‑c)}는 ˆp(S)=c에서 최대가 되며, 너무 쉬운(ˆp≈1) 혹은 너무 어려운(ˆp≈0) 경우 보상이 감소한다.

보상 설계는 네 가지 요소로 구성된다. 첫째, 경계 보상으로 위에서 설명한 난이도 조절을 수행한다. 둘째, 기존 재랭커와 동일하게 문서의 초기 검색 점수 평균을 활용한 관련성 보상 R_rel을 부여해 완전 무관한 문서가 선택되지 않도록 한다. 셋째, 선택된 증거 집합이 형식적으로 올바른지(중복, 인덱스 오류 등) 확인하는 포맷 보상 R_fmt를 도입해 비정상적인 출력에 0 보상을 부여한다. 넷째, 선택 문서 수가 사전 정의된 목표 k*와 크게 벗어나면 패널티 P_cnt를 적용해 증거 집합의 크기를 조절한다. 최종 보상은 R_fmt·(λ_bdy·R_bdy + λ_rel·R_rel – P_cnt) 형태로 결합된다.

학습 최적화는 Group Relative Policy Optimization(GRPO)을 사용한다. 한 쿼리당 M개의 증거 집합을 샘플링하고, 각 집합에 대해 위 보상을 계산해 그룹 내 평균·표준편차를 이용해 정규화된 어드밴티지를 구한다. 이 어드밴티지를 기반으로 정책 그라디언트를 업데이트함으로써, 선택기가 “생성기 불확실성 경계”에 맞는 증거를 탐색하도록 유도한다.

두 번째 단계에서는 학습된 선택기를 고정하고, 선택된 증거 분포에 대해 생성기를 미세조정한다. 여기서는 생성기 자체에 대한 복합 보상(R_fmt, R_acc, R_cite)을 설계한다. R_acc은 토큰‑레벨 F1과 Exact Match(EM)의 가중합으로 정답 정확도를 측정하고, R_cite는

실험은 NQ, TriviaQA, PopQA, HotpotQA, 2Wiki 등 다양한 단일·다중 홉 QA 데이터셋에서 수행되었다. 기본 RAG, RAG+재랭커, IRCoT, RAG SFT와 비교했을 때, BAR‑RAG는 평균 10.3%p 이상의 정확도 향상을 기록했으며, 특히 노이즈가 많은 검색 환경에서 성능 격차가 크게 줄어들었다. Ablation 연구에서는 (1) 훈련 시 필터링(트리비얼·언답가능 쿼리 제거), (2) 단계 1(선택기)·단계 2(생성기) 각각의 존재 여부, (3) 경계 보상, 관련성 보상, 인용 보상 등의 기여도를 검증했다. 각 요소를 제거하면 성능이 현저히 감소함을 확인했다.

핵심 기여는 다음과 같다. 첫째, 재랭커의 목표를 “관련성 최대화”에서 “생성기 학습에 최적화된 증거 선택”으로 전환함으로써 RAG 파이프라인의 근본적인 병목을 해소했다. 둘째, 생성기의 불확실성을 정량화하고 이를 보상에 직접 반영함으로써, 증거 선택이 생성기의 현재 능력에 맞춰 동적으로 조정되도록 설계했다. 셋째, 두 단계 학습(선택기 → 생성기)으로 훈련‑테스트 불일치를 최소화하고, 실제 배포 시 발생하는 검색 노이즈에 대한 강인성을 크게 향상시켰다. 마지막으로, 코드와 데이터가 공개되어 재현 가능성을 확보했다.

댓글 및 학술 토론

Loading comments...

의견 남기기