비대칭 계층형 앵커링을 통한 오디오 비주얼 공동 표현 학습

초록

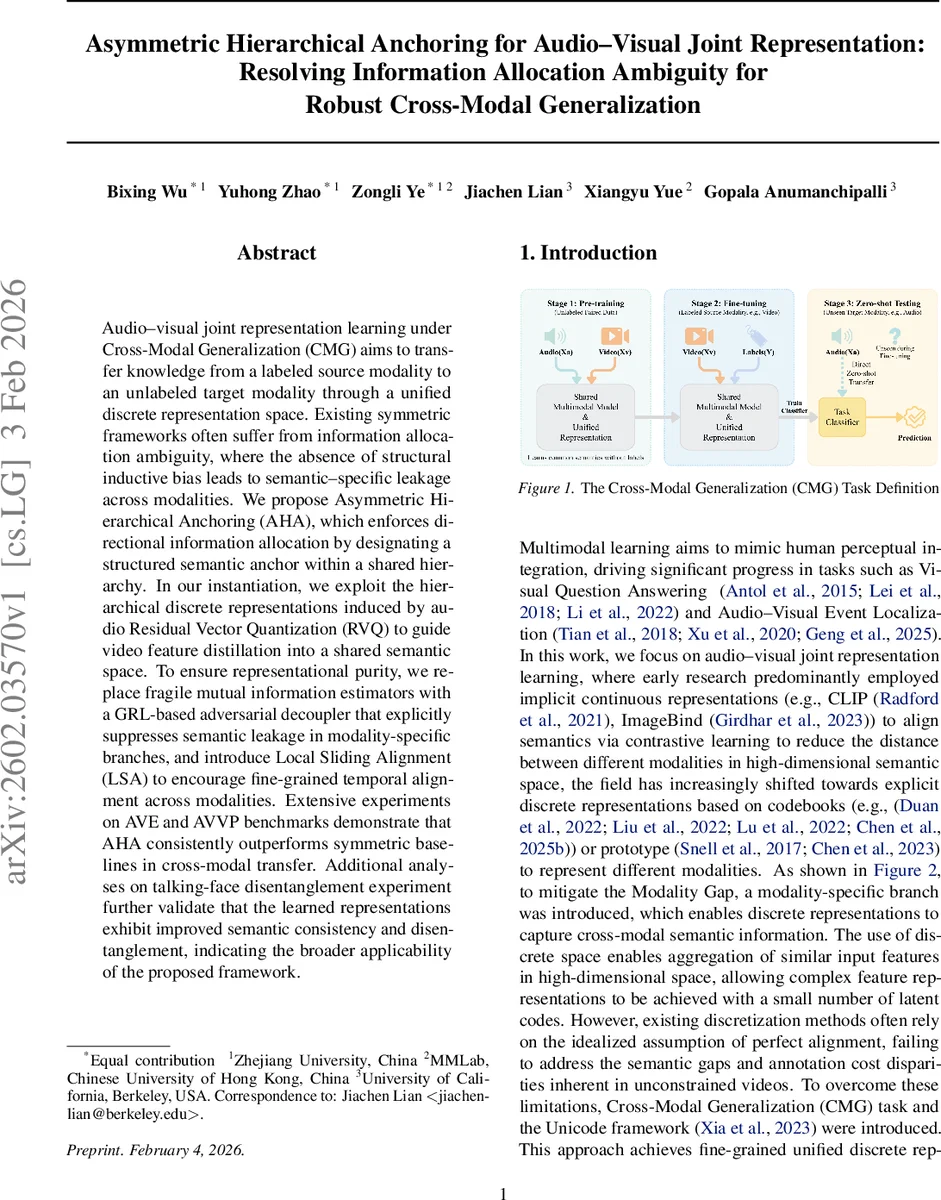

본 논문은 오디오와 비디오 사이의 교차 모달 일반화(CMG) 문제를 해결하기 위해 비대칭 구조인 Asymmetric Hierarchical Anchoring(AHA)을 제안한다. 오디오의 Residual Vector Quantization(RVQ) 계층을 의미론적 앵커로 활용해 비디오의 의미론적 정보를 강제 정렬하고, GRL 기반 적대적 디커플러와 Local Sliding Alignment(LSA)로 모달리티 특이 정보 누수를 억제한다. AVE·AVVP 벤치마크와 말하는 얼굴 분리 실험에서 기존 대칭 방식보다 일관된 성능 향상을 보인다.

상세 분석

AHA는 기존 대칭형 멀티모달 디코딩 구조가 갖는 “정보 할당 모호성”(Information Allocation Ambiguity)을 근본적으로 해소한다는 점에서 혁신적이다. 핵심 아이디어는 오디오 신호에 내재된 계층적 RVQ 코덱을 ‘의미론적 앵커’로 지정하고, 이 앵커가 공유되는 첫 k 계층(보통 1~2계층)에서 오디오와 비디오가 동일한 코드북을 사용하도록 강제한다는 것이다. 이렇게 하면 저차원 코드가 고수준 의미를 포착하고, 비디오의 의미론적 인코더(E_v^sem)는 해당 코드북에 매핑되면서 자연스럽게 오디오와 의미를 일치시킨다.

대칭 구조에서는 의미와 모달 특이 정보가 서로 섞여 코드북 붕괴(codebook collapse) 현상이 발생한다. 이를 방지하기 위해 저자는 두 가지 보조 메커니즘을 도입한다. 첫째, 기존에 널리 사용되던 Mutual Information(MI) 추정기(CLUB 등)의 불안정성을 피하고, Gradient Reversal Layer(GRL)를 이용한 적대적 디커플러를 설계하였다. 이 디커플러는 비디오 특이 인코더(E_v^spec)와 의미론적 유닛(V_t) 사이에 미니맥스 게임을 설정해, 특이 인코더가 의미론적 유닛을 예측하지 못하도록 학습한다. 특히, ‘속도 기반 앵커 샘플링’(velocity‑aware sampling)을 도입해 의미 변화가 큰 시점에 집중하도록 함으로써 정적 프레임에 대한 과적합을 방지한다.

둘째, LSA(Local Sliding Alignment)는 전역적인 정합 대신 제한된 윈도우(ℜ) 내에서 로컬 정합을 수행한다. 이는 오디오와 비디오의 시간적 비동기성을 완화하고, 각 시점 t에 대해 ±R 범위 내에서 가장 일치하는 매칭을 부드러운 확률분포(Y_t,j)로 정의한다. 교차 엔트로피 손실을 통해 양방향 정합을 동시에 최적화함으로써, 미세한 타이밍 차이까지도 효과적으로 학습한다.

실험 결과는 세 가지 측면에서 의미 있다. AVE와 AVVP 데이터셋에서 AHA는 기존 대칭 기반 SOTA 대비 평균 2~3%p의 mAP/Acc 향상을 기록했으며, 특히 제로샷 전이 상황에서 성능 격차가 더욱 두드러졌다. 말하는 얼굴(disentanglement) 실험에서는 오디오 앵커가 제공하는 고수준 의미가 비디오의 입술 움직임과 정확히 매핑되어, 시각적 특성의 분리도 정량적 지표와 시각적 사례 모두에서 개선되었다. 마지막으로, ablation study를 통해 RVQ 계층 수(k), GRL 강도(λ), LSA 윈도우 크기(R) 등이 각각 의미론적 정합과 특이 정보 억제에 미치는 영향을 정량화함으로써 제안 방법론의 설계 선택이 타당함을 입증했다.

요약하면, AHA는 (1) 오디오 RVQ를 구조적 의미론적 앵커로 활용한 비대칭 설계, (2) GRL 기반 적대적 디커플링으로 특이 정보 누수 방지, (3) 로컬 슬라이딩 정합으로 시간적 비동기성 보정이라는 세 축을 통해 CMG 문제를 효과적으로 해결한다. 이러한 설계는 향후 멀티모달 생성·제어 모델, 무감독 교차 모달 학습 등 다양한 응용 분야에 확장 가능성을 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기