언어‑기반 로봇 그립을 위한 추론·강화학습 융합 어포던스 세분화

초록

AffordanceGrasp‑R1은 체인‑오브‑생각(Chain‑of‑Thought) 기반의 고품질 코팅 데이터와 강화학습을 결합해 멀티모달 대형 언어 모델(MLLM)의 추론 능력을 강화한다. MLLM은 이미지‑명령 쌍으로부터 바운딩 박스와 포인트 프롬프트를 생성하고, 이를 SAM‑2가 고해상도 어포던스 마스크로 변환한다. 전역 장면 포인트 클라우드에서 그립 후보를 생성한 뒤, 어포던스 마스크로 필터링해 최종 그립을 선택한다. RAGNet 벤치마크와 실제 로봇 실험에서 기존 최첨단 방법들을 일관되게 앞서며, 복잡한 언어 지시에도 높은 성공률을 보인다.

상세 분석

AffordanceGrasp‑R1은 로봇 조작에서 “어포던스”와 “언어” 사이의 정합성을 확보하기 위해 세 가지 핵심 설계를 도입한다. 첫째, MLLM(여기서는 Qwen2.5‑VL‑7B)을 두 단계의 포스트‑트레이닝으로 강화한다. 초기 단계는 3,313개의 고품질 CoT(Chain‑of‑Thought) 라벨을 이용한 SFT(지도 미세조정)로, 모델이 논리적 흐름과 시각‑언어 연계를 학습하도록 한다. 두 번째 단계는 39,087개의 샘플을 활용한 강화학습(RL)이며, GRPO(Group Relative Policy Optimization)라는 가치‑함수 없이 그룹 내 보상 정규화를 이용한 정책 업데이트 방식을 채택한다. 이때 보상 함수는 논리 일관성, 시각 근거 활용도, 추론 완전성을 종합적으로 평가한다.

둘째, 어포던스 마스크 생성 파이프라인을 “프롬프트 → SAM‑2” 구조로 분리한다. MLLM은 바운딩 박스와 마스크 내부 중심점이라는 구조화된 공간 프롬프트만을 출력하고, SAM‑2는 LoRA 기반 파인‑튜닝을 통해 이 프롬프트를 고해상도 마스크로 변환한다. 이렇게 하면 MLLM이 직접 픽셀‑레벨 마스크를 생성할 때 발생하는 노이즈와 불안정성을 회피하면서, SAM‑2의 강력한 세그멘테이션 성능을 그대로 활용할 수 있다.

셋째, 기존 AffordanceNet이 마스크에 의해 포인트 클라우드를 잘라낸 뒤 그립을 생성하는 방식과 달리, 전역 장면 포인트 클라우드 전체를 입력으로 사용한다. 그 후 어포던스 마스크로 후보 그립을 필터링함으로써, 사전 학습된 그립 모델(GA‑Grasp)의 입력 분포와 일치시키고, 전역 기하학적 컨텍스트를 보존한다. 이는 복잡한 장면에서 물체 간 상호작용이나 부분 가려짐이 있을 때도 안정적인 그립 후보를 제공한다.

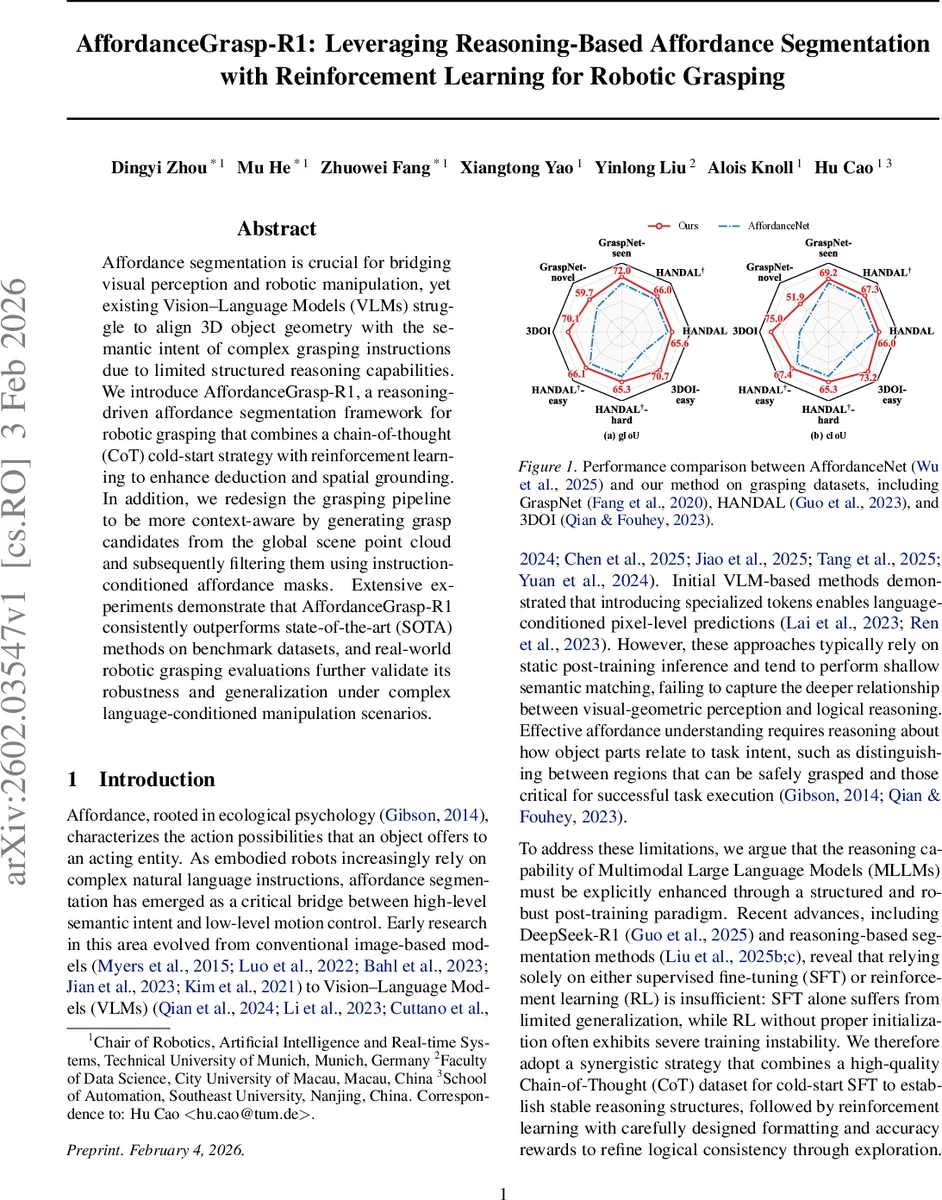

실험 결과는 세 가지 주요 벤치마크(GraspNet, HANDAL, 3DOI)와 자체 구축한 RAGNet 서브셋에서 gIoU와 cIoU 모두 기존 최고 성능을 크게 앞선다. 실제 로봇 실험에서는 “간단한 지시”(예: “컵을 잡아”)와 “복잡한 지시”(예: “컵의 손잡이를 잡고 물을 따라”)에 각각 80 %와 72 %의 성공률을 기록했으며, 이는 zero‑shot 상황에서도 모델이 언어‑시각‑기하학적 연계를 효과적으로 수행함을 증명한다.

전반적으로 이 논문은 (1) CoT 기반의 고품질 데이터로 MLLM의 논리적 기반을 다지는 방법, (2) 가치‑함수 없이 그룹 보상 정규화를 이용한 안정적인 RL 전략, (3) 프롬프트‑기반 세그멘테이션과 전역 포인트 클라우드 활용을 결합한 그립 파이프라인이라는 세 축을 통해 어포던스‑조건 그립 문제를 종합적으로 해결한다는 점에서 큰 의의를 가진다.

댓글 및 학술 토론

Loading comments...

의견 남기기