자기힌트로 강화된 언어 모델, 희소 보상에서 GRPO 탈출

초록

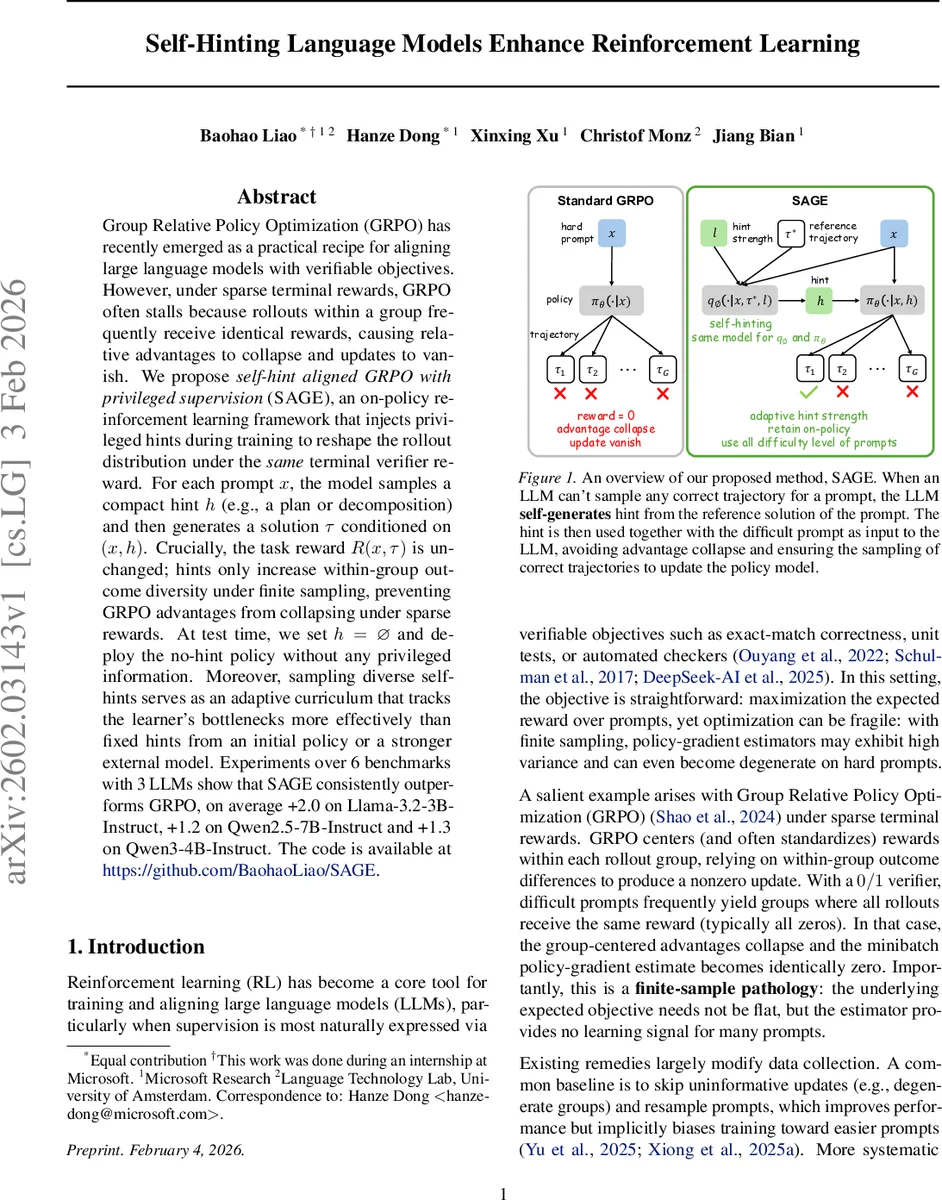

본 논문은 희소한 터미널 보상 하에서 그룹 상대 정책 최적화(GRPO)가 자주 멈추는 문제를 해결하기 위해, 학습 중에 모델이 스스로 생성한 힌트를 활용하는 SAGE(Self‑Hint Aligned GRPO with Privileged Supervision) 프레임워크를 제안한다. 힌트는 훈련 시에만 사용되며, 테스트 시에는 힌트 없이 원래 정책을 그대로 적용한다. 힌트는 롤아웃 분포를 다양화해 그룹 내 보상 차이를 만들고, 정책‑의존적 힌트 강도 스케줄러가 학습 신호가 부족한 프롬프트에만 힌트를 활성화한다. 실험 결과, 6개 베치마크와 3가지 LLM에서 SAGE가 기존 GRPO 대비 일관된 성능 향상을 보였다.

상세 분석

SAGE는 기존 GRPO가 직면한 “보상 붕괴”(advantage collapse) 현상을 정량적으로 분석하고, 이를 해결하기 위한 두 가지 핵심 아이디어를 도입한다. 첫째, privileged hint h를 도입해 롤아웃을 (x, h) 조건 하에 샘플링함으로써, 동일 프롬프트 내에서 성공 확률 pθ(x) 가 매우 낮은 경우에도 성공‑실패 혼합이 발생하도록 만든다. 힌트는 참조 해답 τ⋆ 의 손실 압축 형태이며, 힌트 강도 ℓ∈{0,…,L} 로 정보량을 조절한다. ℓ=0이면 힌트가 없으며, 이는 테스트 시 배포 정책과 일치한다. 둘째, 힌트 강도 스케줄러는 현재 정책의 그룹 내 분산이 0인지(collapse indicator) 판단해, 필요할 때만 ℓ>0을 활성화한다. 이는 자동 커리큘럼 역할을 하며, 학습이 어려운 프롬프트에만 추가 정보를 제공한다.

이론적 분석에서는 GRPO 업데이트가 “게이트” u(p)=1−(1−p)^G−p^G 로 표현될 수 있음을 보인다. 여기서 p는 힌트가 적용된 성공 확률이며, u(p)는 비제로 그룹이 생성될 확률이다. u(p)는 p=½에서 최대가 되며, p가 너무 작거나 너무 크면 게이트가 닫힌다. 따라서 힌트 강도는 p를 ½에 가깝게 만드는 방향으로 조정돼야 최적이다. 고정된 힌트 분포는 학습 진행에 따라 p가 변함에도 불구하고 비최적 상태에 머물 위험이 있다. SAGE는 정책‑의존적 힌트 생성기 qϕ(h|x,τ⋆,ℓ)를 주기적으로 현재 정책 πθ 로 업데이트함으로써, 힌트가 항상 현재 정책에 맞춰 p≈½가 되도록 보정한다.

실험에서는 Llama‑3.2‑3B‑Instruct, Qwen2.5‑7B‑Instruct, Qwen3‑4B‑Instruct 세 모델을 대상으로 6개의 추론·코드·수학 베치마크를 수행했다. 그룹 크기 G=8~32, 힌트 강도 ℓ=2 정도가 가장 효율적이었다. 결과는 평균 정확도 향상이 Llama‑3.2‑3B‑Instruct에서 +2.0, Qwen2.5‑7B‑Instruct에서 +1.2, Qwen3‑4B‑Instruct에서 +1.3 포인트였으며, 특히 희소 보상이 극심한 프롬프트에서 “절대적으로 샘플되지 않은” 상황이 크게 감소했다. 힌트를 사용하지 않은 베이스라인은 학습 초기에 약간의 개선만 보였지만, 학습이 진행될수록 성능이 정체되거나 하락했다. 온라인 자기힌트가 고정 힌트보다 일관되게 우수했으며, 외부 강력 모델이 제공하는 힌트와도 비슷하거나 더 좋은 결과를 냈다.

또한, ablation 실험을 통해 (1) 힌트를 조건에 포함하지 않고 로그 확률만 힌트 없이 계산하면 오프‑폴리시 업데이트가 발생해 학습이 불안정해짐을 확인했으며, (2) 힌트 강도 스케줄링 없이 모든 프롬프트에 무조건 힌트를 제공하면 과도한 힌트가 p를 1에 가깝게 만들어 다시 게이트가 닫히는 현상이 나타났다. 따라서 “필요할 때만, 적절한 강도로” 힌트를 제공하는 정책‑의존적 스케줄러가 핵심임을 입증했다.

결론적으로 SAGE는 (1) 희소 보상 상황에서도 GRPO의 학습 신호를 유지하고, (2) 힌트를 학습 시에만 사용해 배포 시에는 순수 LLM을 그대로 활용할 수 있으며, (3) 온라인 자기힌트 생성과 정책‑의존적 스케줄링을 통해 힌트가 학습 진행에 맞춰 자동으로 조정되는 효율적인 커리큘럼을 제공한다는 점에서 기존 RL‑HF, PPO, 혹은 고정 힌트 기반 방법보다 실용적·이론적으로 우수한 접근법이다.

댓글 및 학술 토론

Loading comments...

의견 남기기