양자화 LLM의 고정밀 미세 조정, QES로 저비용 해법을 찾다

초록

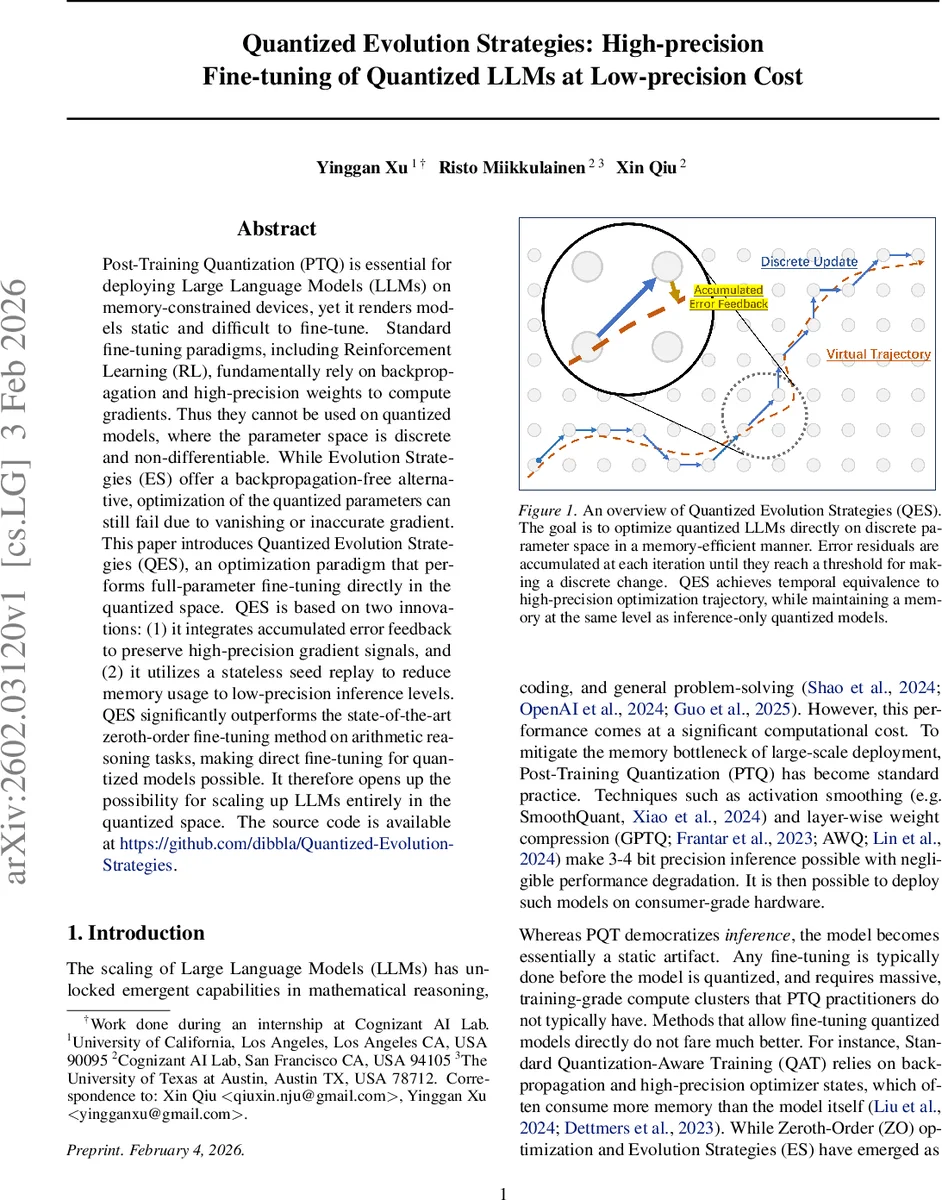

본 논문은 메모리 제약이 큰 환경에서 양자화된 대형 언어 모델(LLM)을 직접 미세 조정할 수 있는 ‘양자화 진화 전략(QES)‘을 제안한다. 기존 방법과 달리 역전파를 필요로 하지 않으며, 누적 오류 피드백과 Stateless Seed Replay 기법을 통해 고정밀 학습 신호를 유지하면서도 메모리 사용량을 추론 수준으로 낮춘다. 산술 추론 작업에서 기존 최신 방법을 크게 능가하는 성능을 입증했다.

상세 분석

이 논문이 해결하는 핵심 문제는 ‘정적 양자화 모델의 미세 조정 불가능성’이다. PTQ로 양자화된 모델은 경량화되어 배포되지만, 미세 조정을 위해서는 고정밀 가중치와 역전파가 필요해 사실상 정적 상태가 된다. 기존의 제로오더(Zero-Order) 최적화나 진화 전략(ES)도 이산화된 매개변수 공간에서 그래디언트 신호가 소실되거나 부정확해지는 ‘정체 문제(Stagnation Problem)‘로 인해 실패한다.

QES의 혁신은 두 가지다. 첫째, ‘누적 오류 피드백(Accumulated Error Feedback)‘이다. 이는 델타-시그마 변조 원리를 차용한 것으로, 각 업데이트 단계에서 발생하는 양자화 오류(소수점 이하 잔차)를 버리지 않고 누적시킨다. 이 누적된 오류가 특정 임계값을 넘으면 이산 매개변수를 한 단계 변경한다. 이를 통해 고정밀 연속 공간에서의 학습 궤적을 저비용 이산 공간에서 ‘시간 평균적으로’ 모방할 수 있다. 이는 확률적 반올림을 사용하는 기존 방법(높은 분산)과 달리 결정론적 누적으로 안정적인 수렴을 보장한다.

둘째, ‘Stateless Seed Replay’ 메커니즘이다. 누적 오류 벡터를 저장하려면 FP16 형태로 모델 가중치本身보다 큰 메모리가 필요할 수 있다. QES는 이 오류 상태를 저장하는 대신, 각 최적화 단계의 랜덤 시드와 보상 기록만 유지한다. 업데이트 시점에 이 기록을 이용해 이전 단계의 노이즈와 그래디언트 추정치를 실시간으로 재생성하고, 이를 바탕으로 현재의 오류 상태를 ‘재구성’한다. 이로 인해 GPU 메모리 사용량은 양자화된 모델을 추론할 때의 수준으로 유지된다.

실험 결과, Countdown 산술 추론 작업에서 QES는 동일한 양자화 설정(INT4, INT8)의 기본 모델 성능을 크게 향상시켰으며, 양자화 제로오더 최적화 SOTA인 QuZO를 압도적으로 능가했다. 특히 INT4와 같은 극저비트 설정에서도 유의미한 학습이 가능함을 보였다. 이는 에지 디바이스와 같은 제한된 환경에서도 양자화 모델의 지속적인 개선과 적응을 가능하게 하는 길을 열었다. 향후 동일 메모리 용량 내에서 더 많은 양자화된 매개변수를 포함하는 방식으로 LLM 스케일링을 연구할 수 있는 새로운 가능성을 제시한다는 점에서 의의가 크다.

댓글 및 학술 토론

Loading comments...

의견 남기기