뉴욕시 혼잡 요금제 시각 기반 교통 분석

초록

본 논문은 뉴욕시의 혼잡 요금제 도입 전후를 2024년 11월부터 2026년 1월까지 910대의 저해상도 교통 카메라 영상을 활용해 자동으로 분석한다. 저해상도에 최적화된 YOLO‑LR 객체 탐지 모델을 개발하고, 분산 처리 인프라와 시간‑공간 변동을 보정하는 알고리즘을 적용해 차량 밀도 변화를 정량화한다. 주요 결과는 정책 시행 후 피크 시간대 차량 밀도가 평균 8 % 감소했으며, 교통 흐름이 주변 구역으로 재분배되는 경향을 보였다는 것이다.

상세 분석

이 연구는 기존의 수동 교통 조사나 제한된 센서 네트워크에 의존하던 방식에서 벗어나, 도시 전역에 설치된 910개의 웹캠 영상을 실시간으로 처리하는 파이프라인을 구축한 점이 가장 큰 혁신이다. 저해상도(352 × 240) 영상에 대해 높은 검출 정확도를 유지하기 위해 저해상도 전용 YOLO‑LR 모델을 설계했으며, COCO 데이터셋을 동일 해상도로 재스케일링해 5가지 교통 객체(자전거, 자동차, 오토바이, 버스, 트럭)를 학습시켰다. 표 1에 제시된 바와 같이, YOLO‑LR은 동일 입력 크기에서 표준 YOLO‑v11n보다 mAP50‑95가 평균 0.05 이상 향상되었으며, 특히 버스와 트럭 클래스에서 큰 폭의 성능 개선을 보였다.

데이터 수집 인프라는 16개의 워커가 병렬로 프레임을 캡처하고, 64프레임 배치 단위로 GPU(NVIDIA A100 40 GB)에서 YOLO‑LR을 실행하도록 설계되었다. 처리된 메타데이터는 SQLite에 저장하고, 프레임 자체는 즉시 삭제해 저장 비용을 최소화하였다.

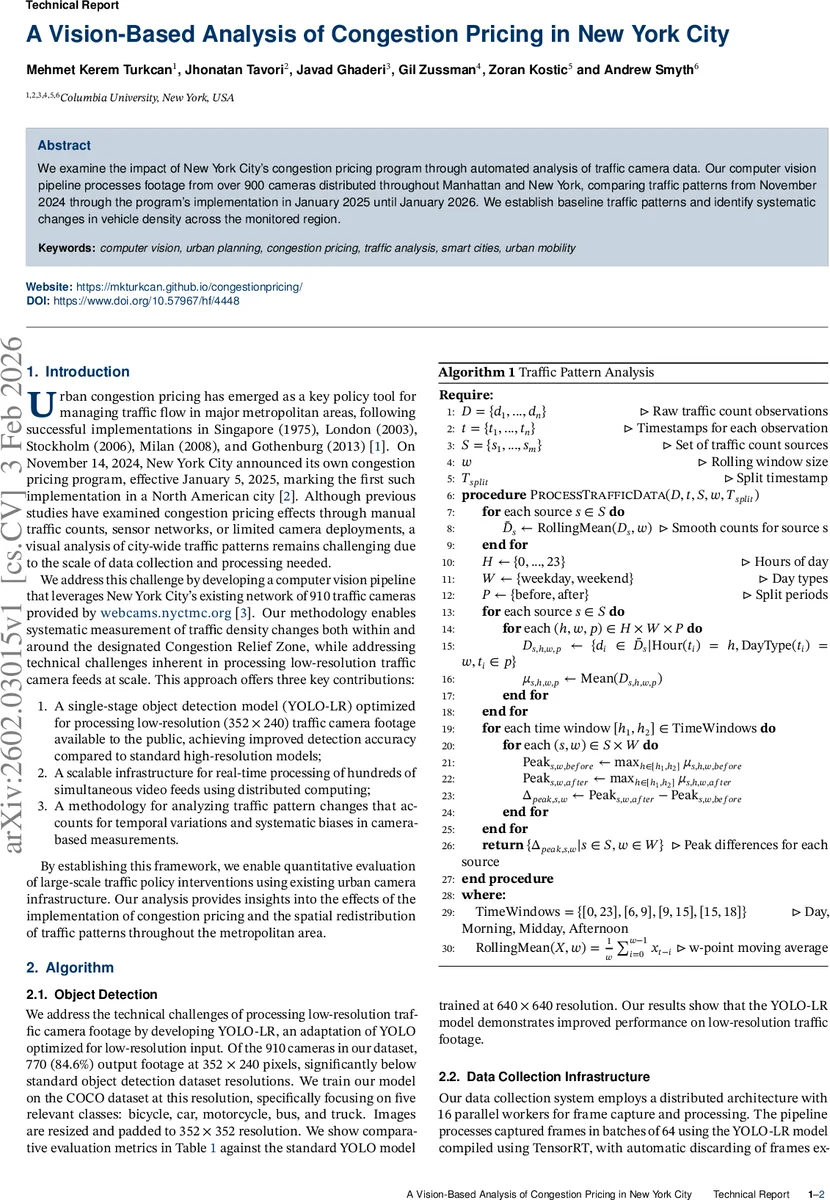

패턴 분석 단계에서는 시간‑공간 변동성을 보정하기 위해 ‘Peak Hour Differential(PHD)’이라는 지표를 도입했다. 각 카메라(소스)별로 롤링 평균(윈도우 = ω)으로 잡음과 순간 변동을 억제하고, 사전·사후 기간을 동일한 시간대와 요일 유형(주중/주말)으로 구분해 평균 차량 밀도 μ를 계산한다. 이후 지정된 시간창(

댓글 및 학술 토론

Loading comments...

의견 남기기