복잡 지형에서 견고한 인간형 로봇 인지 보행 학습

초록

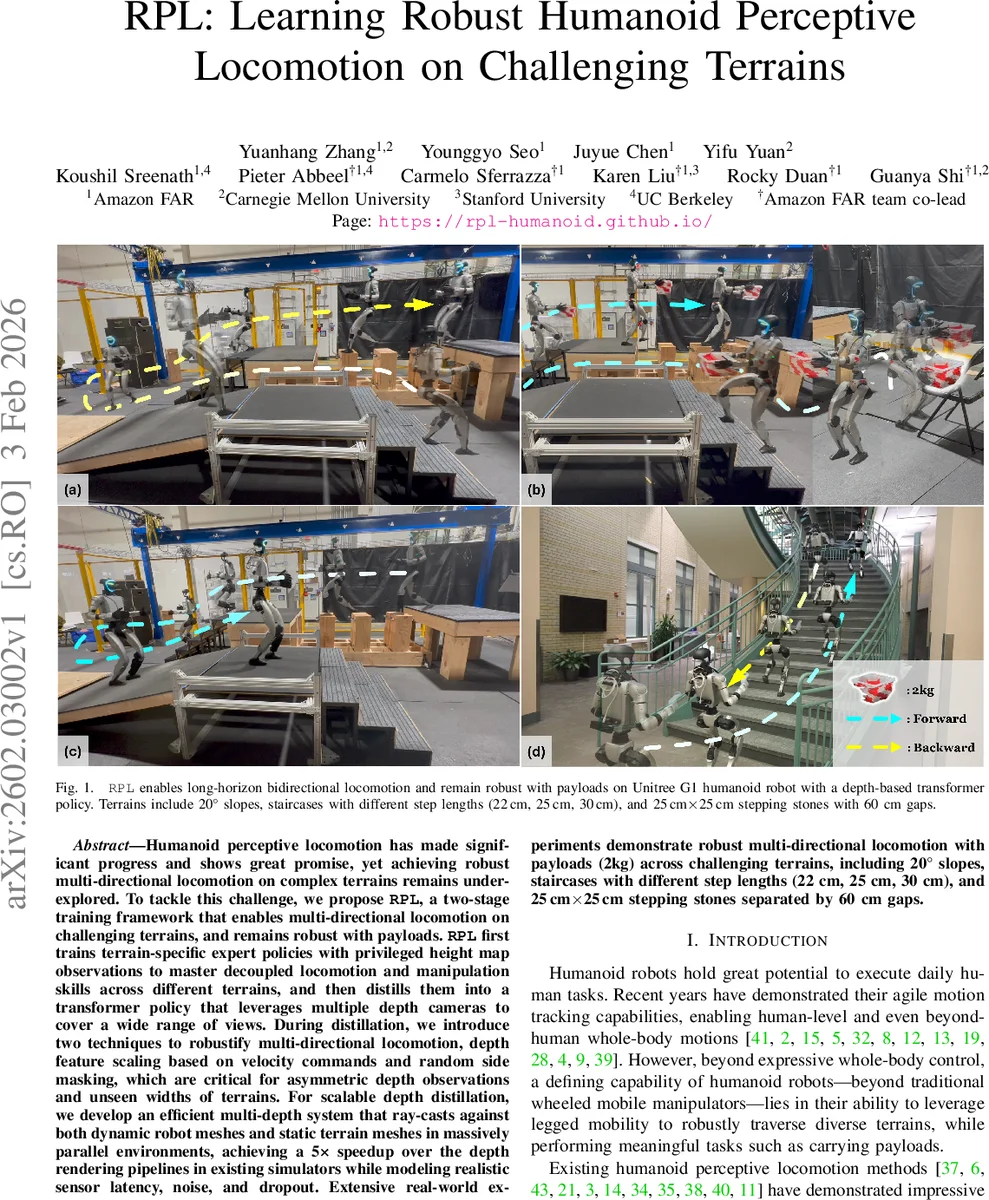

RPL은 두 단계 학습 프레임워크로, 특화된 높이맵 기반 전문가 정책을 먼저 학습하고 이를 다중 깊이 카메라 입력을 사용하는 트랜스포머 정책으로 증류한다. 깊이 특징 스케일링과 랜덤 사이드 마스킹을 도입해 비대칭 시야와 보이지 않는 지형 폭에 대한 강인성을 확보한다. 효율적인 GPU 기반 다중 깊이 렌더링 시스템을 통해 시뮬레이션 속도를 5배 가속시키며, 실제 로봇 실험에서 2 kg 페이로드를 실은 상태로 20° 경사면, 다양한 계단, 그리고 간격이 큰 스테핑 스톤을 안정적으로 양방향 보행한다.

상세 분석

RPL은 인간형 로봇의 다방향 보행을 실현하기 위해 ‘전문가‑학생’ 구조를 채택한다. 1단계에서는 각 지형(경사면, 상승·하강 계단, 스테핑 스톤)에 대해 특화된 전문가 정책을 학습한다. 여기서 사용되는 관측은 프리빌리지를 가진 로컬 높이맵(1.6 m × 1.0 m, 0.1 m 해상도)이며, PPO와 힘 커리큘럼을 결합해 엔드‑이펙터에 2 kg 페이로드가 걸린 상황을 시뮬레이션한다. 보행 안정성을 높이기 위해 ‘Foot Edge Penalty’와 ‘Foothold Penalty’를 지형별로 선택적으로 적용하고, 토르소 자세 추적 보상을 추가해 상체와 하체의 동기화를 강화한다.

2단계에서는 다중 깊이 카메라(전·후방) 입력을 이용해 하나의 통합 시각 정책을 증류한다. 증류 손실은 DAgger 기반으로, 학생 정책이 노이즈가 섞인 proprioceptive와 깊이 이미지에 대해 전문가 행동을 모방하도록 설계된다. 여기서 핵심은 두 가지 데이터 증강 기법이다. 첫째, ‘Depth Feature Scaling based on Velocity commands(DFSV)’는 현재 목표 속도에 따라 깊이 특징을 스케일링해 비대칭 시야(예: 좌우 카메라가 서로 다른 지형을 보는 경우)에서 발생하는 분포 이동을 완화한다. 둘째, ‘Random Side Masking(RSM)’은 깊이 이미지 양측을 무작위 폭으로 마스킹해 훈련 시 보지 못한 지형 폭에 대한 일반화 능력을 키운다.

시뮬레이션 효율성을 위해 NVIDIA Warp를 활용한 GPU‑레벨 레이캐스팅 파이프라인을 구현했다. 동적 로봇 메쉬와 정적 지형 메쉬를 동시에 처리하면서, 로봇 본체 메쉬는 로컬 좌표계에서 변환해 레이와 교차 검사를 수행한다. 이 설계는 매 프레임마다 메쉬를 월드 좌표계에 재배치하는 비용을 없애고, 환경·카메라·픽셀을 모두 배치 처리함으로써 기존 시뮬레이터 대비 5배 이상의 속도 향상을 달성한다. 또한 깊이 센서의 지연, 가우시안 노이즈, 드롭아웃을 모델링해 sim‑to‑real 격차를 최소화한다.

실험 결과, RPL은 2 kg 페이로드를 실은 Unitree G1 로봇이 20° 경사면, 계단(스텝 길이 22 cm, 25 cm, 30 cm), 그리고 25 cm × 25 cm 스테핑 스톤(간격 60 cm) 위에서 양방향으로 수십 초 이상 안정적으로 보행함을 보여준다. 특히, 훈련에 포함되지 않은 지형 폭이나 새로운 계단 스텝 길이에서도 성공률이 크게 떨어지지 않아, 제안된 DFSV와 RSM이 실제 환경 변동성에 대한 강인성을 제공함을 입증한다.

요약하면, RPL은 (1) 특화된 전문가 정책을 통한 고품질 행동 데이터 확보, (2) 다중 깊이 카메라 기반 트랜스포머 증류, (3) 속도 기반 깊이 스케일링과 사이드 마스킹을 통한 비대칭 시야 보강, (4) 고속 GPU 레이캐스팅을 이용한 대규모 깊이 시뮬레이션이라는 네 가지 핵심 기술을 결합해, 인간형 로봇이 복잡하고 변동성이 큰 지형을 페이로드를 들고도 견고하게 보행할 수 있게 만든다.

댓글 및 학술 토론

Loading comments...

의견 남기기