시각·언어 계층 정렬을 통한 장문 캡션 이해

초록

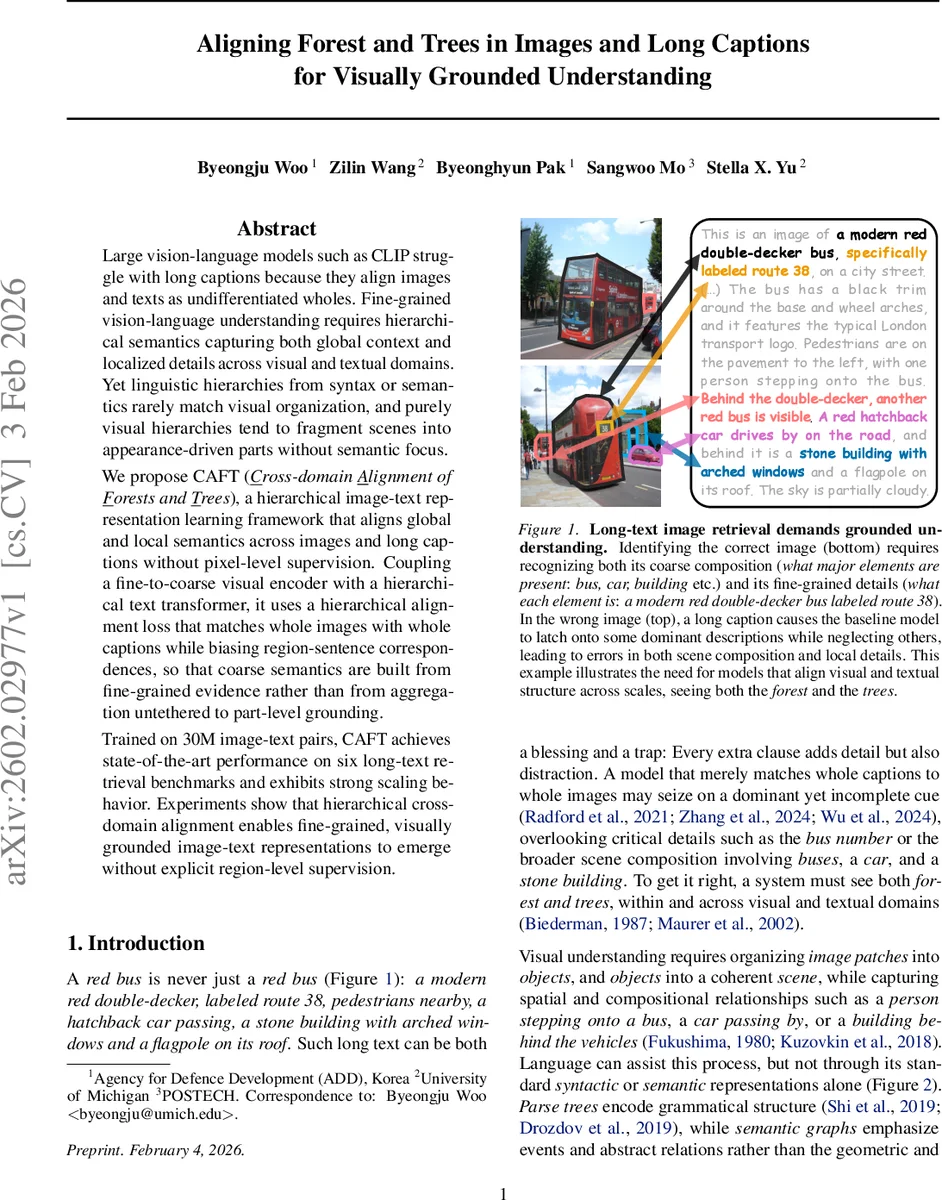

CAFT는 이미지와 장문 캡션 사이에 전역·국부 의미를 계층적으로 정렬하는 프레임워크이다. Fine‑to‑coarse 비전 인코더와 서브‑캡션 → 전체‑캡션 트랜스포머로 구성된 텍스트 인코더를 결합하고, 전체‑전체와 부분‑부분 정렬 손실을 동시에 학습한다. 3천만 이미지‑텍스트 쌍으로 사전학습한 뒤, 6개 장문 검색 벤치마크에서 최고 성능을 기록하고, 픽셀‑레벨 라벨 없이도 의미 기반 영역 분할을 획득한다.

상세 분석

본 논문은 기존 CLIP‑계열 모델이 이미지와 텍스트를 하나의 벡터로 압축하면서 장문 캡션에 포함된 세부 정보와 전역 구성을 동시에 포착하지 못한다는 한계를 지적한다. 언어적 계층(구문 트리·의미 그래프)은 시각적 공간 구조와 정렬이 어려운 반면, 순수 시각 계층은 외관 중심으로 파편화돼 의미적 일관성을 상실한다. CAFT는 이러한 불일치를 해소하기 위해 두 도메인 모두에서 “숲(전역)과 나무(국부)”를 동시에 모델링한다.

시각 측면에서는 196개의 슈퍼픽셀 토큰을 시작점으로, CAST와 유사한 그래프 풀링을 단계적으로 적용해 64‑, 32‑, 16‑개의 세그먼트 토큰으로 압축한다. 중간 단계 토큰(v_fine)은 국부 영역을, 최상위 CLS 토큰(v_coarse)은 전체 장면을 대표하도록 설계돼, 전역 의미가 국부 증거에 기반하도록 강제한다.

텍스트 측면에서는 장문 캡션을 문장 단위로 분할하고, 연속 1~3문장을 하나의 청크로 묶어 N개의 서브‑캡션을 만든다. 각 청크는 독립적인 Sub‑caption Transformer를 통해 D‑차원 임베딩(t_sub)으로 인코딩되고, 경량 Residual‑MLP 어댑터를 거쳐 정제된다. 이후 Whole‑caption Transformer가

댓글 및 학술 토론

Loading comments...

의견 남기기