멀티모달 환각 억제를 위한 내재 보상 기반 자동 정제 프레임워크 IRIS

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

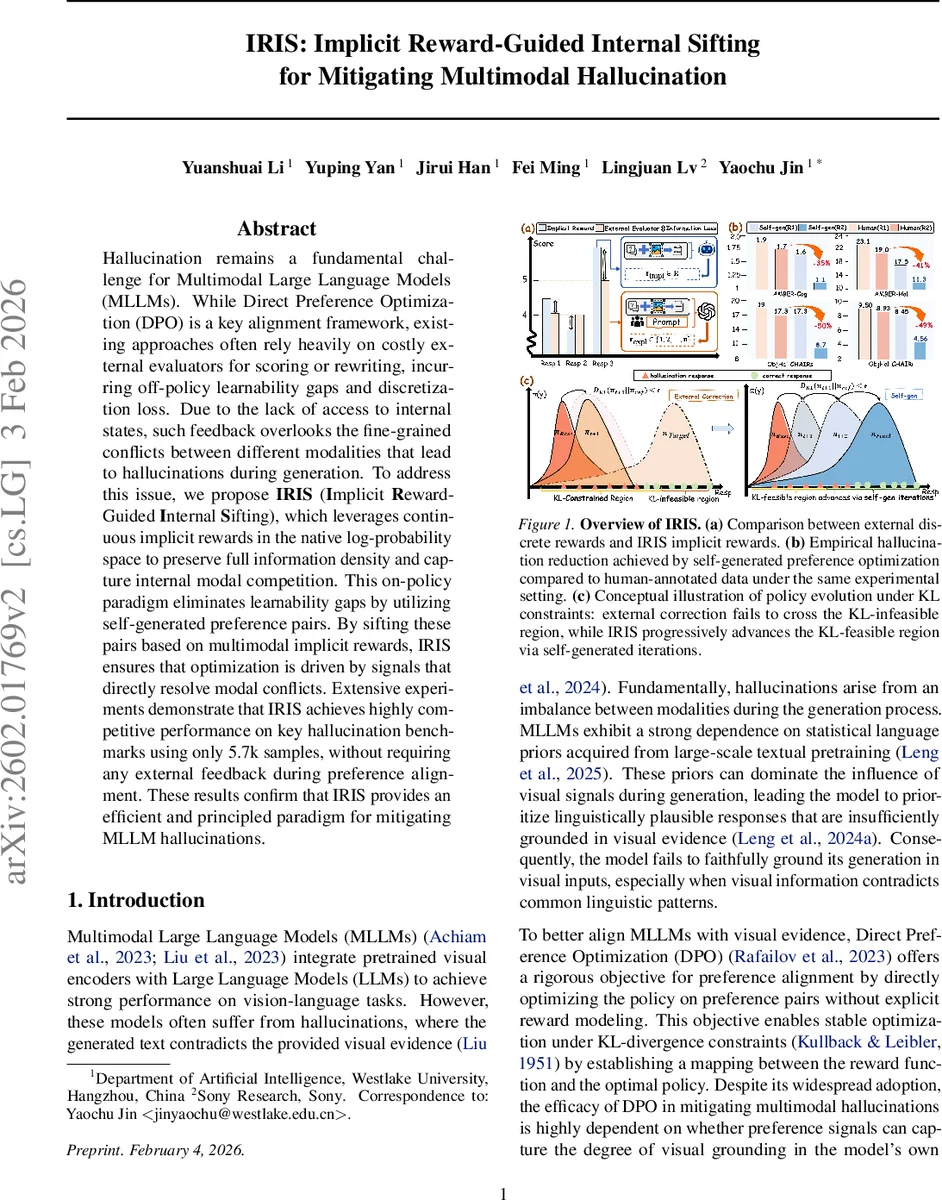

IRIS는 외부 평가자를 사용하지 않고 모델 자체의 로그확률 기반 내재 보상을 활용해 온‑policy 방식으로 선호 쌍을 생성·선별한다. 시각‑언어 모드 간 경쟁을 정량화하는 Rectified Visual Guidance(RVG) 점수를 통해 시각적 근거가 부족한 응답을 억제하고, 5.7k 샘플만으로 기존 대규모 외부 피드백 기반 방법과 동등하거나 우수한 환각 감소 성능을 달성한다.

상세 분석

본 논문은 멀티모달 대형 언어 모델(MLLM)에서 시각적 근거와 언어적 사전확률 사이의 불균형이 환각을 유발한다는 점을 명확히 짚고, 이를 해결하기 위한 새로운 정렬 프레임워크 IRIR(Implicit Reward‑Guided Internal Sifting)를 제안한다. 기존 DPO 기반 접근법은 외부 평가자(GPT‑4V 등)로부터 이산 점수를 받아 선호 쌍을 구성하는데, 이는 (1) 연속적인 확률 분포 정보를 손실하는 이산화(discretization) 문제와 (2) 오프‑policy 데이터가 KL 제약 하에서 거의 0에 가까운 로그비율을 만들어 학습이 정체되는 learnability gap을 초래한다. IRIS는 이러한 한계를 극복하기 위해 모델 자체가 생성한 로그‑확률 비율을 “내재 보상”으로 정의한다. 구체적으로 현재 정책 πθ와 이전 라운드의 레퍼런스 정책 πref 사이의 로그비율을 β로 스케일링한 r(y)=β·log

댓글 및 학술 토론

Loading comments...

의견 남기기