객체 중심 멀티모달 임베딩 ObjEmbed: 범용 객체 표현 모델

초록

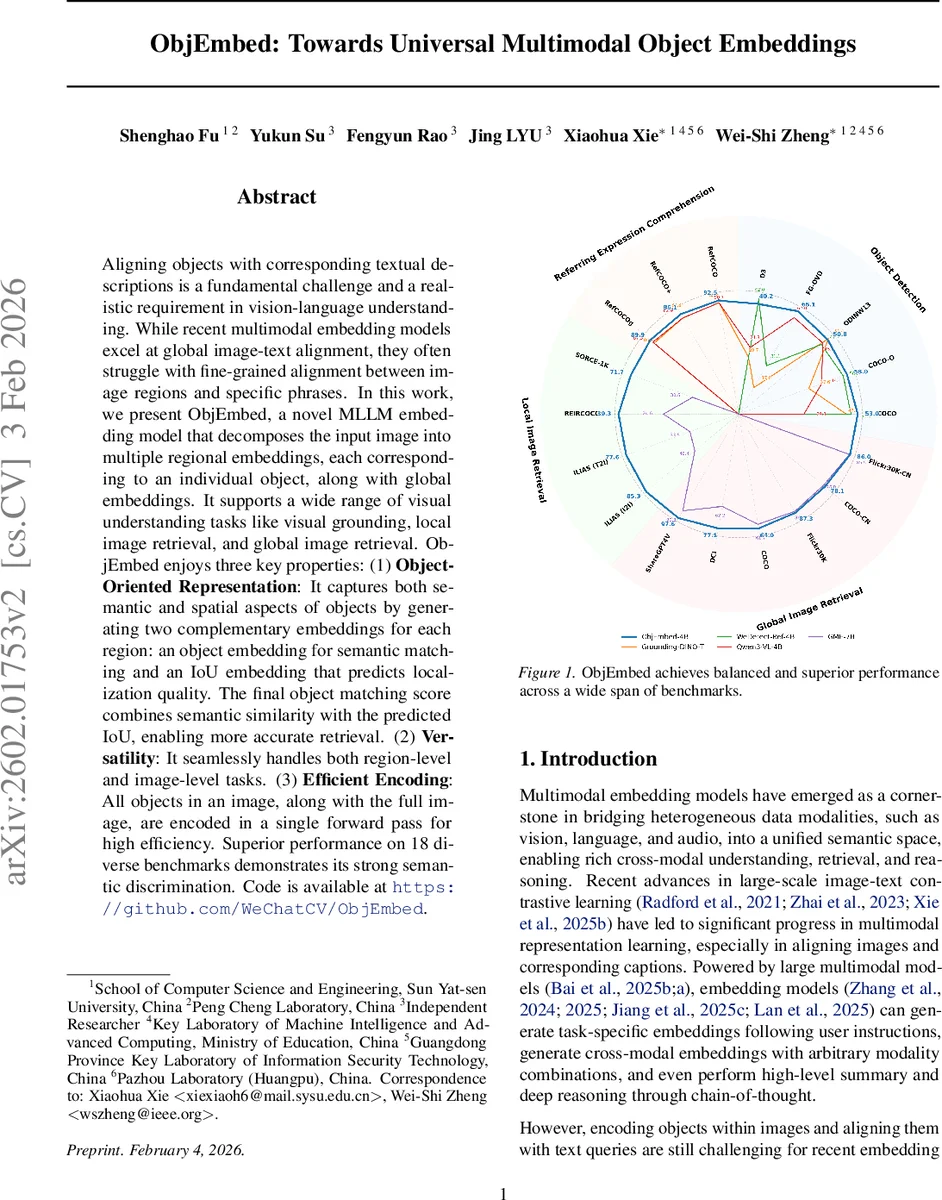

ObjEmbed은 이미지 내 모든 객체를 개별 임베딩으로 변환하고, 각 객체에 대해 의미적 임베딩과 IoU 예측 임베딩을 동시에 학습한다. 하나의 전방향 패스로 전역 이미지 임베딩과 지역 객체 임베딩을 모두 생성해 시각 정합, 로컬·글로벌 이미지 검색, 객체 검출·지시 표현 이해 등 다양한 비전‑언어 과제를 효율적으로 수행한다.

상세 분석

ObjEmbed은 최신 대형 멀티모달 언어 모델(Qwen‑3‑VL‑Instruct)을 백본으로 삼아, 이미지와 텍스트를 동일한 토크나이저와 트랜스포머 레이어를 통해 인코딩한다. 핵심 설계는 다섯 종류의 특수 토큰(⟨object⟩, ⟨iou⟩, ⟨global⟩, ⟨local text⟩, ⟨global text⟩)을 도입해 각각 객체 의미, 박스 품질, 전체 이미지, 지역 텍스트, 전역 텍스트를 표현한다는 점이다. 이미지 입력 시 사전 학습된 제안 생성기(WeDetect‑Uni)를 이용해 상위 N(논문에서는 100)개의 RoI를 추출하고, RoIAlign으로 얻은 특징을 객체 프로젝터를 통해 압축한다. 압축된 특징은 ⟨object⟩ 토큰에 매핑되고, 바로 뒤에 ⟨iou⟩ 토큰이 배치되어 객체와 박스 품질을 분리된 벡터로 학습한다. 이렇게 구성된 토큰 시퀀스는 텍스트와 동일한 LLM에 입력돼 한 번의 포워드 패스로 전역 이미지 토큰(⟨global⟩)과 모든 객체 토큰을 동시에 처리한다.

학습 목표는 세 부분으로 나뉜다. ① 지역‑레벨 대비 학습에서는 객체 설명과 제안 간의 코사인 유사도를 sigmoid focal loss로 최적화해 다중‑정답 및 불완전 라벨 상황을 완화한다. ② 전역‑레벨 대비 학습은 짧은 캡션과 긴 캡션을 각각 ⟨global⟩ 토큰에 매핑해 이미지‑텍스트 정합을 강화한다. ③ IoU 회귀는 ⟨iou⟩ 토큰에 선형 헤드를 두고, 실제 IoU와 sigmoid focal loss로 학습해 박스 품질을 정량화한다. 전체 손실은 λ₁·L_region + λ₂·L_image + λ₃·L_iou 로 가중합한다.

매칭 스코어는 의미적 유사도와 예측 IoU의 곱으로 정의돼, 의미가 일치하지만 위치가 부정확한 경우 점수가 억제된다. 로컬 이미지 검색에서는 모든 객체 스코어 중 최댓값을 사용해 “부분‑검색”을 구현하고, 글로벌 검색에서는 ⟨global⟩ 임베딩을 그대로 활용한다.

실험에서는 1.3 M 이미지‑텍스트 쌍을 포함한 13 억 개의 샘플을 수집·정제해 학습했으며, COCO, RefCOCO+/g, FG‑OVD 등 18개 벤치마크에서 기존 최첨단 모델 대비 10~20%p 향상을 기록했다. 특히 로컬 이미지 검색에서 4개 데이터셋 평균 20 p 이상의 절대적 상승을 보였고, COCO 객체 검출에서는 53.0 mAP로 전문 검출기와 근접한 성능을 달성했다. 효율성 측면에서는 전체 시퀀스 길이가 2 k 토큰 이하로 유지돼 FlashAttention‑2를 적용하면 1 GPU(RTX 4090)당 30 fps 이상을 구현한다.

한계점으로는 제안 생성기의 품질에 크게 의존한다는 점과, IoU 토큰이 박스 회귀 대신 품질 예측에만 사용돼 정확한 박스 좌표를 직접 출력하지 못한다는 점을 들 수 있다. 향후 연구에서는 제안‑프리(end‑to‑end) 방식과 박스 회귀를 통합한 다중‑헤드 구조를 탐색하고, 대규모 라벨‑프리 이미지‑텍스트 데이터로 사전 학습을 확대해 일반화 능력을 더욱 강화할 여지가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기