공중 조작을 위한 비전‑언어‑행동 벤치마크 AIR‑VLA

초록

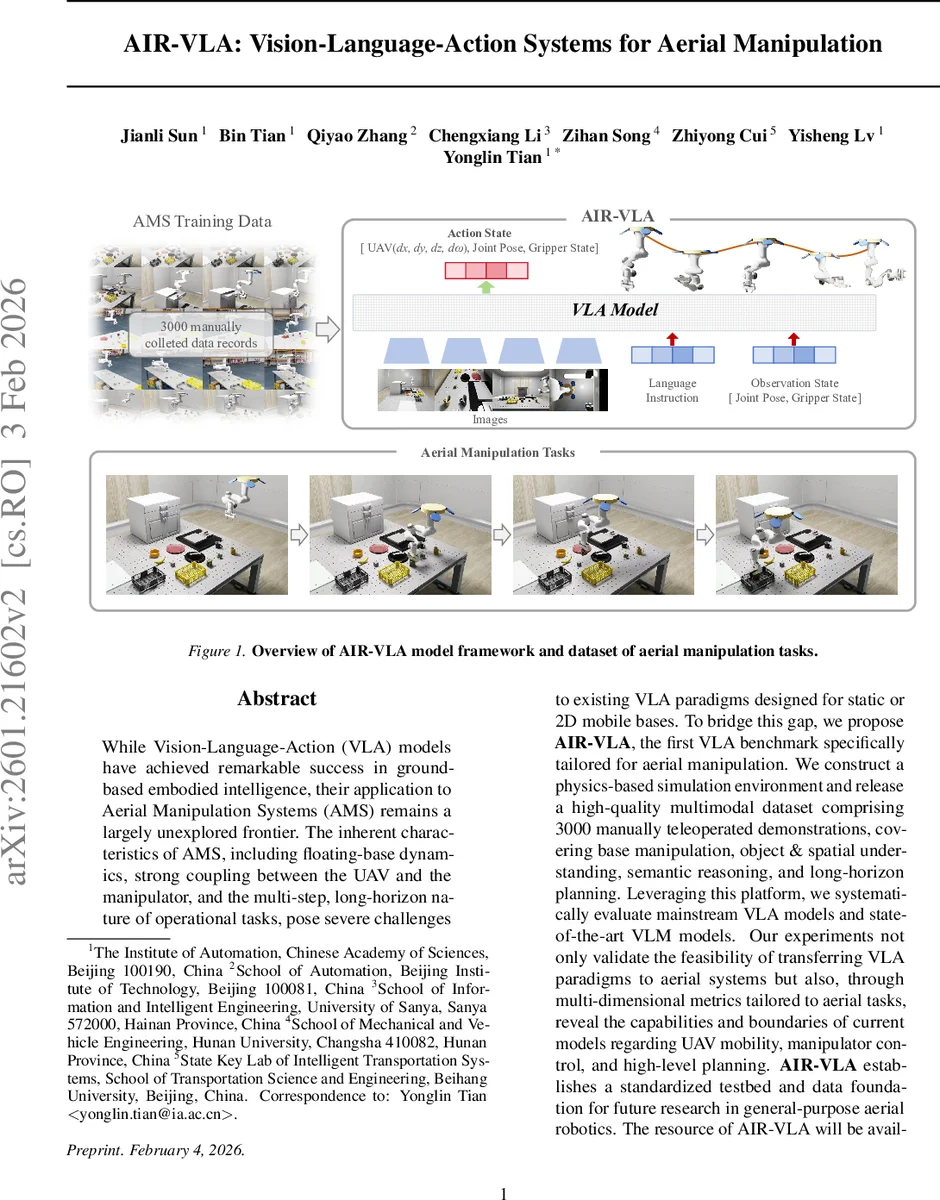

AIR‑VLA는 UAV와 7‑DoF 팔을 결합한 공중 조작 시스템을 위한 최초의 Vision‑Language‑Action 벤치마크이다. 물리 기반 시뮬레이터와 3000개의 인간 텔레오퍼레이션 시연 데이터를 제공하고, 기본 비행·조작, 객체·공간 인식, 의미 추론, 장기 계획 네 가지 작업군에 대해 다중 차원 평가 지표를 설계한다. 기존 지상 로봇용 VLA 모델들을 공중 플랫폼에 적용해 성능을 정량화함으로써 현재 모델의 한계와 향후 연구 방향을 제시한다.

상세 분석

본 논문은 공중 조작 시스템(AMS)의 특수성을 정확히 짚어낸다. 첫째, 부동 기반(UAV)의 6‑DoF 자유도와 팔의 7‑DoF 관절이 강하게 결합되어 있어, 전통적인 지상 로봇용 VLA가 가정하던 평면 이동·정적 조작 모델이 적용되기 어렵다. 이를 해결하기 위해 저자는 NVIDIA Isaac Sim 기반의 물리 엔진(PhysX 5)과 Omniverse USD 파이프라인을 활용해, 풍동·조류·조명 변동까지 포함한 고충실도 시뮬레이션 환경을 구축하였다.

둘째, 데이터 수집 단계에서 인간 텔레오퍼레이터가 게임패드로 직접 조종하도록 함으로써, 스크립트 기반 데이터가 놓치기 쉬운 비정형 협동 패턴과 비선형 동역학을 포착했다. 3000개의 시연은 평균 475 타임스텝(≈10 초)으로, 기존 테이블탑·지상 이동 벤치마크보다 3배 이상 긴 시간적 복잡성을 제공한다.

셋째, 멀티모달 센서 구성(전방‑다운 RGB‑D, 팔 손목 RGB‑D, 제3자 카메라)과 함께 UAV의 4D 포즈·속도, 관절 각도·그리퍼 상태를 모두 기록함으로써, VLA 모델이 “시각‑언어‑행동”을 학습할 때 필요한 완전한 상태‑행동 매핑을 제공한다.

넷째, 평가 프레임워크는 두 층으로 나뉜다. (1) VLA 모델에 대해 실시간 폐루프 시뮬레이션에서 UAV‑Arm 협동 제어, 위치 정확도, 조작 정밀도, 안전성 등을 정량화하는 저수준 지표; (2) VLM 기반 고수준 플래닝에 대해 서브태스크 구성, 3D 공간 인식, 객체 그라운딩, 스킬 선택 등을 다중 차원으로 평가한다. 이러한 지표는 단순 성공률을 넘어, 장기 계획의 논리적 일관성 및 동적 환경 적응력을 측정한다.

실험 결과, 기존 RT‑1, OpenVLA, π‑0 시리즈는 기본 비행·조작에서는 어느 정도 성공하지만, 복합적인 공간 관계 추론이나 장기 순차 작업에서는 급격히 성능이 저하된다. 특히, UAV의 위치 오차가 5 cm 이상이면 조작 성공률이 30 % 이하로 떨어지는 등, 부동 기반의 미세 제어가 전체 파이프라인의 병목임을 확인한다.

마지막으로, 논문은 현재 VLA 모델이 “시각‑언어‑행동” 통합은 가능하지만, “동적 물리‑제어”와 “장기 논리‑계획”을 동시에 다루기 위해서는 (i) 고차원 상태 공간에 대한 대규모 사전학습, (ii) 물리 기반 시뮬레이션과 실제 비행 간의 도메인 적응, (iii) 멀티모달 피드백(예: 힘/토크 센서) 통합이 필요하다고 제언한다.

댓글 및 학술 토론

Loading comments...

의견 남기기