CiM 기반 엣지 LLM을 위한 도메인 적응·잡음 저항 RAG 프레임워크

초록

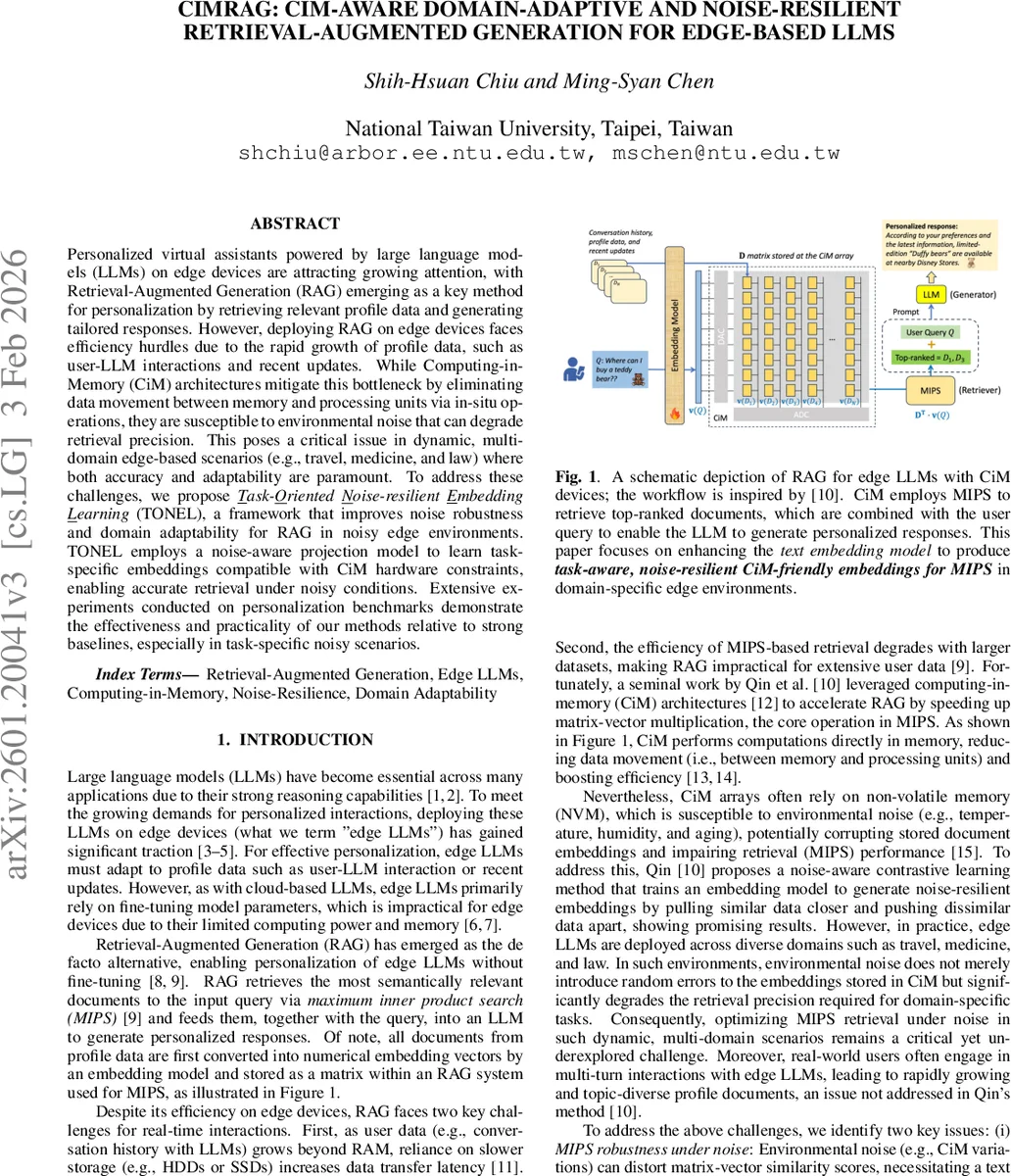

본 논문은 엣지 디바이스에서 대규모 언어 모델(LLM)을 개인화하기 위한 Retrieval‑Augmented Generation(RAG) 시스템을, Computing‑in‑Memory(CiM) 하드웨어에 최적화하고 환경 잡음에 강인하도록 설계한 TONEL 프레임워크를 제안한다. 잡음 인식 투사 모델과 라벨‑프리 의사 라벨 생성 메커니즘을 결합해 도메인별 임베딩을 학습하고, 실험을 통해 기존 PCA·RoCR 대비 MIPS 정확도와 상위‑5 검색 품질이 크게 향상됨을 입증한다.

상세 분석

TONEL은 두 가지 핵심 모듈, 즉 Noise‑aware Task‑oriented Optimization (NATO)와 Pseudo‑Label Generation Mechanism (PGM)으로 구성된다. NATO는 사전 학습된 텍스트 인코더(예: BERT‑like)에서 추출한 고차원 FP32 임베딩을 CiM 크로스바 배열의 고정된 64×64 구조와 8‑bit 정수 정밀도에 맞추어 투사한다. 이때 가짜 양자화와 스케일링을 적용해 하드웨어 친화적인 64‑dim INT8 벡터를 만든 뒤, 실제 CiM 디바이스에서 측정된 σv 값을 이용해 가우시안 잡음을 주입한다. 잡음이 섞인 임베딩은 태스크 프레딕터에 입력되고, CiM‑aware Cross‑Entropy 손실(CiMCE)로 학습한다. CiMCE는 기존 CE에 잡음 변동성을 반영해, 임베딩이 잡음 하에서도 클래스 구분력을 유지하도록 유도한다.

PGM은 라벨이 없는 대규모 프로파일 데이터를 자동으로 클러스터링(K‑means)해 K개의 잠재 토픽 라벨을 생성한다. 이렇게 얻은 의사 라벨은 NATO 학습 시 ˆy_i,c 로 사용돼, 도메인 별 특성을 반영한 임베딩을 만들면서도 인간 라벨링 비용을 제거한다. 라벨이 존재하는 경우(TONEL‑w/ TL)와 라벨이 없는 경우(TONEL‑w/ PL) 두 가지 학습 모드가 제공되며, 실험 결과 라벨이 없는 경우에도 RoCR 대비 6~12% 수준의 정확도 향상을 보인다.

실험 설계는 LaMP 벤치마크의 Movie Tagging(15‑class)과 Product Rating(5‑class) 데이터셋을 사용했다. 평가 지표는 MIPS Top‑1 정확도(Acc@1), Precision@5, nDCG@5, 그리고 최종 LLM 생성 단계에서의 분류 정확도와 F1 점수다. 다양한 CiM 디바이스(RRAM, FeFET)와 잡음 비율(0%, 50%, 100%)을 시뮬레이션했으며, TONEL‑w/ PL은 모든 디바이스와 잡음 수준에서 PCA와 RoCR을 능가했다. 특히 100% 잡음 상황에서 Movie 데이터셋의 Acc@1은 RoCR(0.3295) 대비 0.3883(+18%)을 기록했고, 라벨이 있는 경우(TONEL‑w/ TL)는 0.7034로 거의 Oracle 수준에 근접했다.

또한, 검색된 상위‑5 문서를 Gemma‑2B와 Llama‑3.2‑3B에 프롬프트로 결합해 실제 생성 성능을 평가했다. TONEL‑w/ PL은 Baseline(문맥 없이 단일 쿼리) 대비 Accuracy와 F1에서 각각 47%p, 59%p 향상을 보였으며, RoCR 대비도 일관된 개선을 나타냈다. 이는 잡음에 강인한 임베딩이 MIPS 단계에서 더 정확한 문서 순위를 제공하고, 그 결과 LLM이 보다 풍부하고 정확한 컨텍스트를 활용하게 됨을 의미한다.

기술적 의의는 다음과 같다. 첫째, CiM 하드웨어의 물리적 제약(고정 차원·정밀도)과 환경 잡음 모델을 학습 과정에 직접 통합함으로써, 메모리‑컴퓨팅 병목을 해소하면서도 정확도를 유지한다. 둘째, 라벨‑프리 클러스터링 기반 의사 라벨링은 실시간으로 늘어나는 사용자 프로파일에 대해 자동 적응성을 제공한다. 셋째, 기존 대비 단순히 차원 축소(PCA)나 잡음 인식 대비 학습(RoCR)보다 더 포괄적인 최적화 목표를 설정해, 도메인 특화와 잡음 저항을 동시에 달성한다. 향후 연구는 더 복잡한 멀티‑모달 프로파일(이미지·음성)과 동적 잡음 추정 모델을 결합하거나, 온‑디바이스 파인‑튜닝과 연계해 완전한 엣지 LLM 파이프라인을 구축하는 방향으로 확장될 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기