멀티모달 사고 조절을 위한 이중 보상 강화학습 SAIL‑RL

초록

**

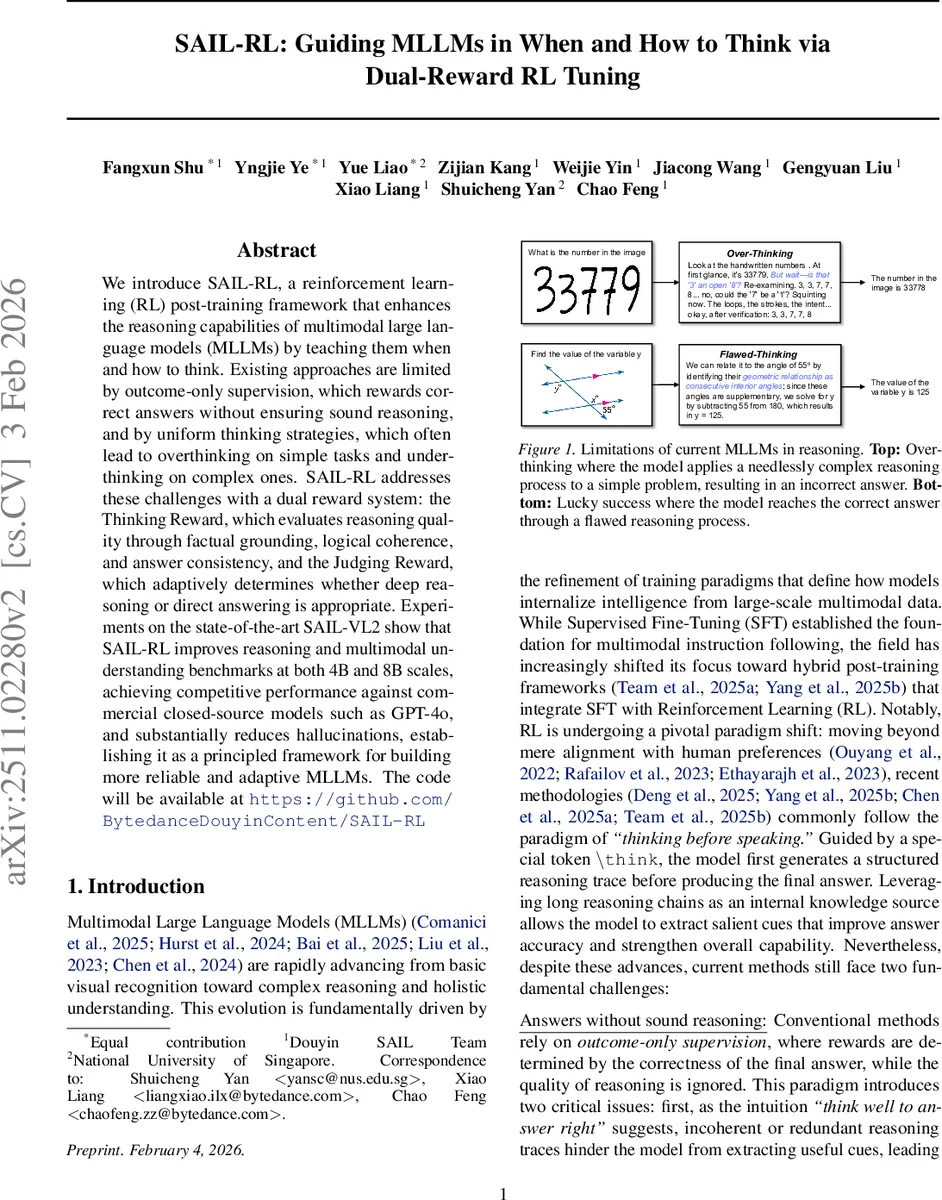

SAIL‑RL은 멀티모달 대형 언어 모델에 “언제·어떻게 생각할지”를 학습시키는 이중 보상(RL) 프레임워크이다. Thinking Reward는 논리·사실·답변 일관성을 평가해 추론 품질을 강화하고, Judging Reward는 문제 난이도에 따라 깊은 추론을 할지 직접 답변을 할지를 판단한다. 4B·8B 규모 SAIL‑VL2에 적용한 실험에서 기존 방법 대비 추론 정확도·멀티모달 이해도 모두 상승하고, GPT‑4o와 경쟁 수준을 달성했으며, 환각 감소 효과도 확인되었다.

**

상세 분석

**

본 논문은 멀티모달 대형 언어 모델(MLLM)에서 기존의 “결과‑중심” 학습이 초래하는 두 가지 근본적 문제—(1) 정답은 맞지만 추론 과정이 부실한 경우와 (2) 과도한 추론(오버씽킹) 혹은 부족한 추론(언더씽킹)으로 인한 효율성 저하—를 해결하고자 한다. 이를 위해 저자들은 두 개의 보상 함수를 설계하였다. 첫 번째인 Thinking Reward는 논리적 일관성, 사실적 근거, 답변 일관성 세 축을 각각 0·1 이진 점수로 평가하고, 평균을 취해 전체 추론 품질을 정량화한다. 논리적 일관성은 구조적 건전성(문제 분해·식 구성)과 연역적 건전성(모순·계산 오류) 여부를 검사하고, 사실적 근거는 시각·텍스트·외부 지식(필요 시) 세 단계의 사실 검증을 수행한다. 두 번째인 Judging Reward는 문제 난이도 라벨(간단·복잡)과 모델이 선택한 “think” 토큰(추론 모드) 사이의 일치 여부를 0·1 점수로 매긴다. 즉, 간단한 질문에선 직접 답변을, 복잡한 질문에선 사전 추론을 강제함으로써 연산 비용을 절감한다.

두 보상을 곱셈 형태로 결합한 Cascading Reward System은 R_total = α·(R_judge·R_think·R_answer) + (1‑α)·R_format(α=0.9)이라는 식으로 정의된다. 여기서 R_answer는 최종 정답 정확도, R_format은 응답 형식 준수를 의미한다. 곱셈 구조는 “AND‑gate” 역할을 하여 어느 하나라도 실패하면 전체 보상이 0이 되도록 설계돼, 보상 해킹을 원천 차단한다.

학습 절차는 두 단계로 나뉜다. Stage 1에서는 LongCoT 형태의 SFT를 통해 추론 템플릿을 사전 학습하고, Stage 2에서는 위에서 정의한 보상들을 이용해 PPO 기반 RL 튜닝을 수행한다. 실험에서는 최신 멀티모달 모델 SAIL‑VL2를 기반으로 4 B와 8 B 두 규모에 각각 SAIL‑RL을 적용하였다. 결과는 수학·논리·시각 추론 벤치마크(MMMUval, MMBench, ChartQA 등)와 일반 멀티모달 이해 벤치마크(OpenCompass 등) 모두에서 기존 SFT·RL 대비 평균 2‑5%p 상승을 보였으며, 특히 8 B 모델은 GPT‑4o와 비슷한 수준의 성능을 기록했다. 또한, 사실 근거 검증을 포함한 Thinking Reward 덕분에 hallucination 비율이 30% 이상 감소하는 효과도 확인되었다.

이와 같은 설계는 “언제·어떻게 생각할지”라는 인간의 인지 조절 메커니즘을 모델에 명시적으로 주입함으로써, 추론 품질과 효율성을 동시에 개선한다는 점에서 의미가 크다. 다만, 복잡도 라벨링이 데이터에 의존하고, 판단 보상이 이진화돼 미세한 난이도 차이를 반영하기 어려운 점, 그리고 Gemini 기반 보상 심판기의 비용이 높은 점은 향후 연구 과제로 남는다.

**

댓글 및 학술 토론

Loading comments...

의견 남기기