LogSumExp 최적화를 위한 안전 KL 발산 기반 확률적 근사

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

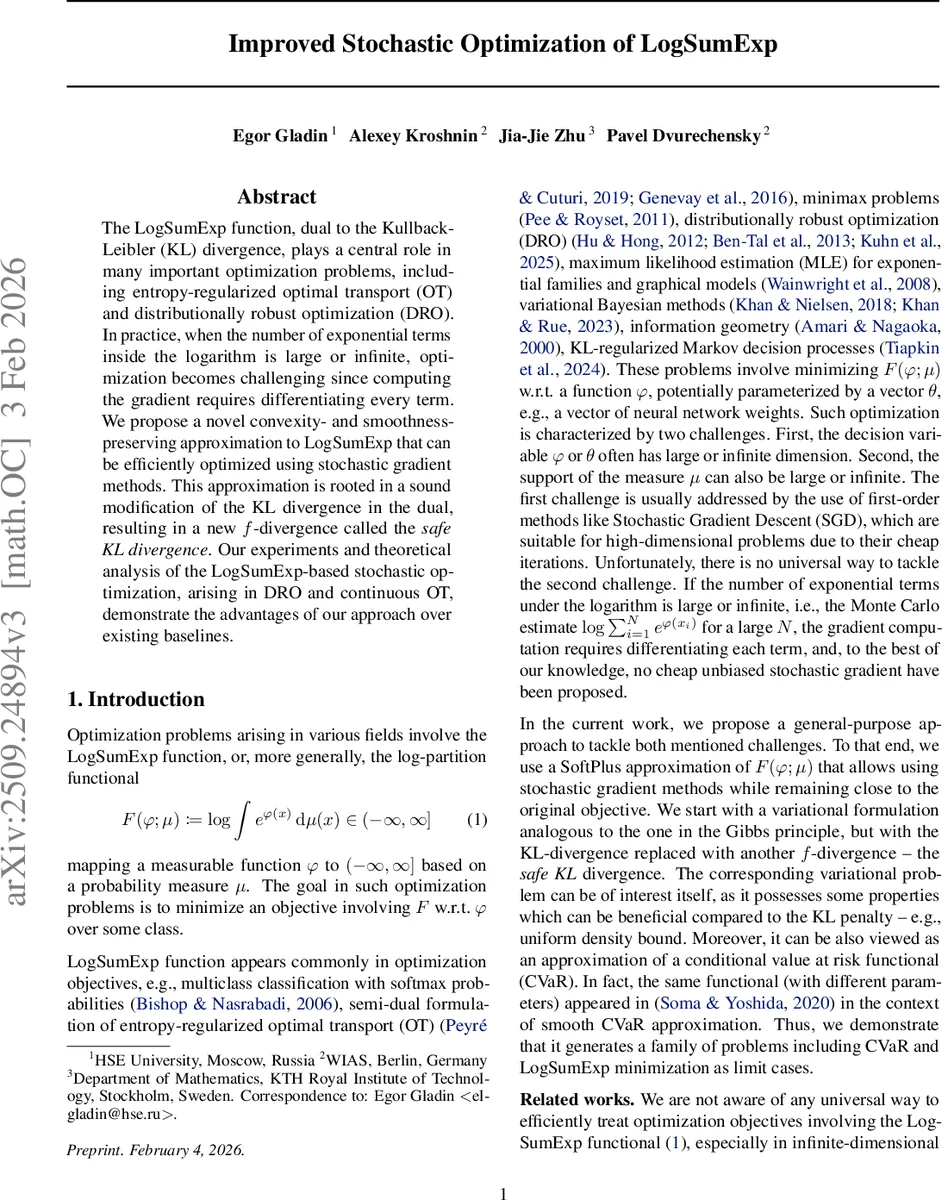

본 논문은 LogSumExp 함수의 대규모·무한 차원 상황에서의 미분 비용을 줄이기 위해, KL 발산을 변형한 새로운 f‑divergence인 Safe KL divergence를 도입하고, 이를 기반으로 SoftPlus 형태의 근사함수를 제시한다. 이 근사는 볼록성·스무스성을 유지하면서 스토캐스틱 그라디언트 방법으로 효율적으로 최적화할 수 있다.

상세 분석

LogSumExp는 확률분포의 로그 파티션 함수와 동치이며, 최적화 문제에서 흔히 등장한다. 그러나 항의 개수가 매우 많거나 연속적인 경우, 기존의 직접적인 그라디언트 계산은 모든 항을 미분해야 하므로 계산량이 폭발한다. 저자들은 Gibbs 변분 원리를 출발점으로 삼아 KL 발산 대신에 새로운 f‑divergence인 Safe KL divergence D₍ρ₎(ν,μ) 를 정의한다. 이 발산은 0<ρ<1 일 때 f₍ρ₎(t)=t log t + 1 + (1−ρt)/ρ log(1−ρt) (0≤t≤1/ρ) 로 구성되며, t가 1/ρ를 초과하지 못하도록 강제한다. 따라서 밀도 비율이 과도하게 커지는 상황을 방지하고, 특히 OT나 DRO와 같이 불균형이 심한 문제에서 유용하다.

Safe KL의 공액함수 f₍ρ₎* (s)= (1/ρ) log(1+ρ e^{s}) − 1 로 계산되며, 이는 스케일된 SoftPlus 함수와 동일하다. 이를 이용해 원래의 로그 파티션 함수 F(φ;μ) 를

F₍ρ₎(φ;μ)=inf_{α∈ℝ}

댓글 및 학술 토론

Loading comments...

의견 남기기