바이올린 연주 기법 인식 전사 모델 VioPTT

초록

VioPTT는 기존 피치·타이밍 전사에 연주 기법(데타슈, 플라제올레, 스피카토, 피치카토) 예측을 추가한 경량형 연쇄 모델이다. 고품질 합성 데이터셋 MOSA‑VPT를 공개해 라벨링 비용을 없애고, 실제 연주 녹음에서도 높은 기법 분류 정확도와 최첨단 피치·온셋 전사 성능을 달성한다.

상세 분석

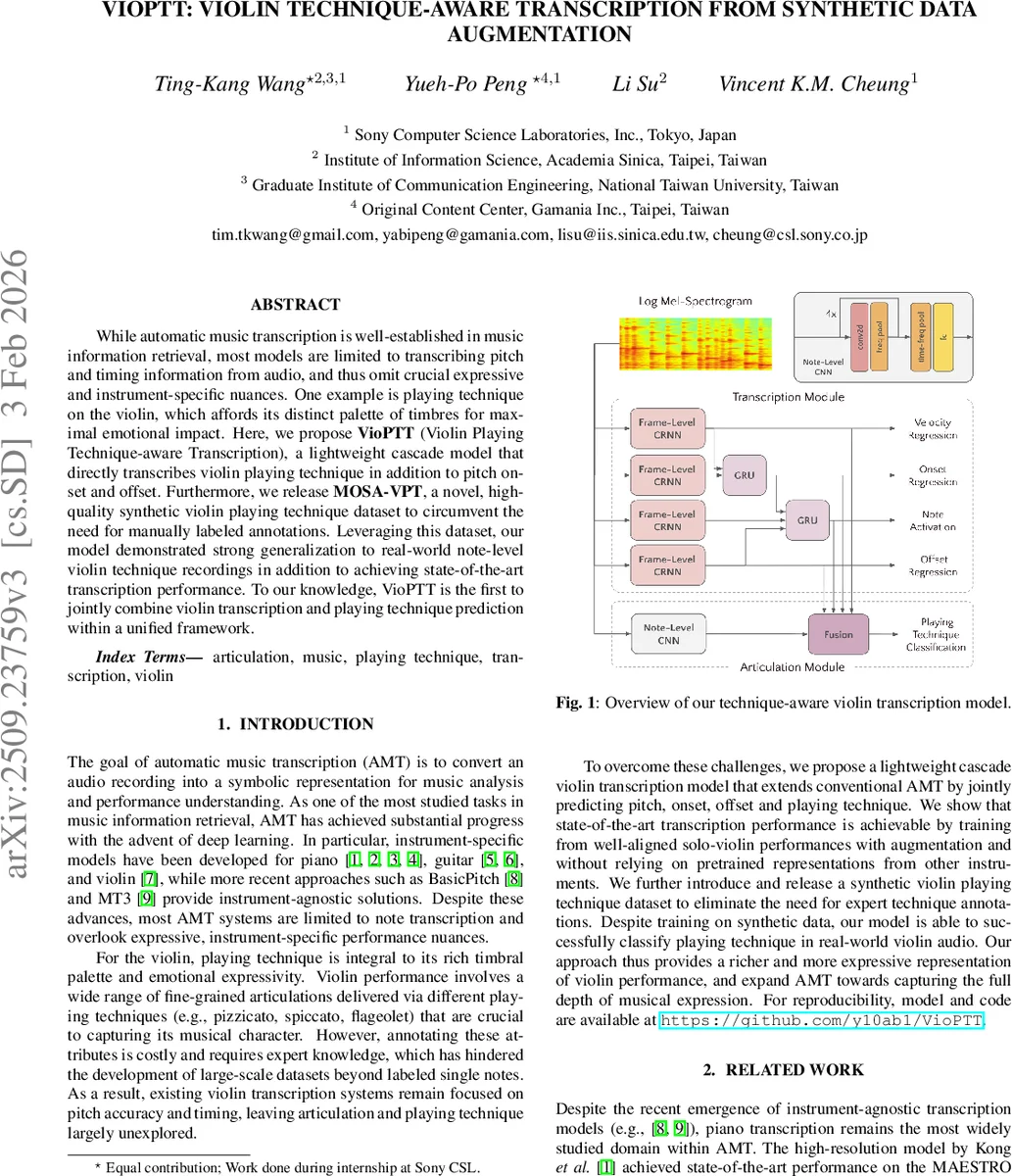

본 논문은 자동 음악 전사(AMT) 분야에서 악기별 미세 표현을 다루는 첫 시도라 할 수 있다. 기존 AMT 모델은 주로 피치와 타이밍을 프레임 단위로 예측하고, 악기의 특수한 연주 기법은 무시한다. 바이올린은 피치·진동 외에도 다양한 활·손동작에 따라 음색이 급격히 변하는데, 이러한 정보를 자동으로 추출하려면 기법 라벨이 필요하지만 라벨링 비용이 매우 높다. 저자들은 이를 해결하기 위해 두 가지 핵심 전략을 제시한다. 첫째, DAW‑Dreamer와 고품질 VST 악기(Synchron Solo Violin)를 이용해 MIDI와 일치하는 기법 라벨이 자동으로 부착된 합성 데이터 MOSA‑VPT(76시간, 4가지 기법 균형)를 구축하였다. 합성 과정에서 방음·공간 효과를 배제하고 16 kHz 모노로 렌더링함으로써 실제 녹음과의 도메인 격차를 최소화했다. 둘째, 경량 CRNN 기반 전사 모듈과 기법 분류용 아티큘레이션 모듈을 연쇄적으로 연결한 구조를 설계했다. 전사 모듈은 기존 피아노 고해상도 모델(Kong et al.)을 바이올린에 그대로 적용해 프레임‑레벨 온셋·오프셋·베로시티(회귀)와 피치(이진) 예측을 수행한다. 아티큘레이션 모듈은 전사 모듈에서 추출한 온셋·오프셋·프레임·베로시티 특징을 128‑차원 임베딩으로 변환하고, 별도의 컨볼루션 블록으로 추출한 음향 임베딩과 결합해 5‑클래스(4가지 기법+무기법) 로그잇을 출력한다. 손실 함수는 온셋·오프셋·프레임에 BCE, 베로시티에 MSE, 기법에 CE를 각각 적용한 가중합이다.

데이터 증강 측면에서도 두 단계의 변형을 적용한다. (i) 피치·타이밍 증강은 ±0.1 semitone, 5 dB 게인, 랜덤 밴드패스·리버브 등을 통해 모델의 강건성을 높였으며, (ii) 기법 합성 자체가 일종의 증강 역할을 수행한다. 실험에서는 (1) 피아노 사전학습 가중치를 이용한 전사 모듈 초기화와 (2) 증강 유무를 교차 비교했다. 결과는 도메인 차이(음색·시간 특성) 때문에 충분한 바이올린 데이터가 있으면 사전학습 효과가 제한적임을 보여준다. 또한, 전사 모듈에 온셋·오프셋·프레임 정보를 모두 활용했을 때 기법 분류 정확도가 가장 높았으며, 특히 오프셋 정보를 제외하면 매크로 정확도가 20% 이상 급락하는 등 각 특징의 기여도가 명확히 드러난다.

비교 대상인 기존 바이올린 전사 모델 MUSC와 멀티라벨 기법 분류 모델 MERTech와의 실험에서도 VioPTT는 피치·온셋 F1 점수와 기법 매크로 정확도 모두 우수한 성능을 기록한다. 특히 실제 녹음 기반 RWC 데이터셋에서 77.2%의 매크로 정확도를 달성했으며, 이는 라벨이 전혀 없는 합성 데이터만으로 학습한 모델이 실제 환경에서도 강인함을 입증한다. 전체 파이프라인은 10 000 스텝(전사)·1 000 스텝(기법) 학습으로 1 GPU(RTX 4090)에서 수시간 내에 수렴한다.

이 논문의 주요 기여는 (1) 라벨링 비용을 크게 낮춘 대규모 합성 기법 데이터셋 공개, (2) 전사와 기법 예측을 하나의 연쇄 구조로 통합한 경량 모델 설계, (3) 전사 특징이 기법 분류에 미치는 영향을 정량적으로 분석한 점이다. 향후 다른 현악기나 관악기에 동일한 파이프라인을 적용하면 연주 표현을 포괄적으로 이해하는 새로운 AMT 패러다임을 구축할 수 있을 것으로 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기