AI 생성 영상 탐지를 위한 지각 직선화 기반 ReStraV

초록

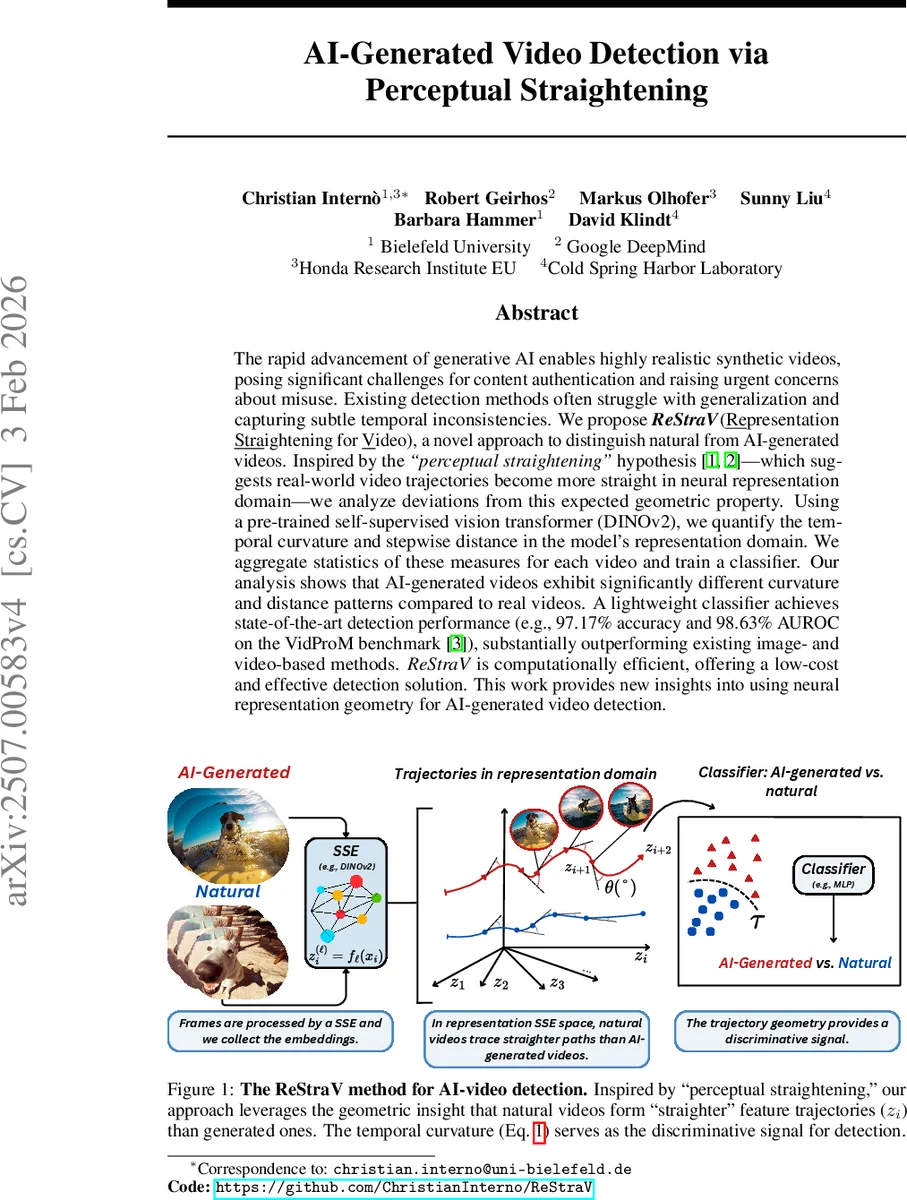

본 논문은 인간 시각 시스템에서 제안된 “지각 직선화(perceptual straightening)” 가설을 인공 신경망에 적용해, 자연 영상과 AI‑생성 영상의 시간적 특징을 차별화한다. 사전 학습된 DINOv2 비전 트랜스포머의 표현 공간에서 프레임 간 이동 벡터의 거리와 곡률을 계산하고, 이들의 통계량을 이용해 경량 MLP 분류기로 진위 여부를 판별한다. 실험 결과 VidProM 등 주요 벤치마크에서 97% 이상의 정확도와 98% 이상의 AUROC를 달성하며, 기존 이미지·비디오 기반 탐지기들을 크게 앞선다.

상세 분석

ReStraV는 “지각 직선화”라는 신경과학적 현상을 인공 신경망에 전이시킨 혁신적인 접근법이다. 인간 시각 피질은 동적 자극을 처리할 때 원본 픽셀 공간에서 복잡하게 휘어지는 궤적을 내부 표현 공간에서는 가능한 한 직선에 가깝게 변환한다는 가설에 기반한다. 논문은 이 가설을 DINOv2와 같은 자기지도 학습 비전 트랜스포머에 적용해, 자연 영상은 표현 공간에서 낮은 곡률과 일정한 프레임 간 거리(스텝와이즈 디스턴스)를 보이는 반면, AI‑생성 영상은 인위적인 노이즈와 비일관적인 움직임으로 인해 곡률이 크게 증가하고 거리 변동성이 높아진다고 주장한다.

구현 단계는 다음과 같다. 1) 각 비디오는 2초 구간을 24프레임으로 샘플링하고, 224×224 크기로 정규화한다. 2) DINOv2 ViT‑S/14 모델의 최종 트랜스포머 블록에서 CLS 토큰과 196개의 패치 임베딩을 추출해 75,648 차원의 벡터로 결합한다. 3) 연속 프레임 임베딩 사이의 차이 벡터 Δz_i를 구하고, 그 L2 노름을 거리 d_i, 두 연속 차이 벡터 사이의 코사인 유사도로부터 각도 θ_i(곡률)를 계산한다. 4) 각 비디오에 대해 거리와 곡률의 평균, 최소, 최대, 분산 네 가지 통계량을 구해 8차원 특징 벡터를 만든다. 5) 이 특징 벡터를 입력으로 하는 단순 MLP(또는 로지스틱 회귀) 분류기를 학습한다.

실험에서는 5가지 주요 AI 영상 생성 모델(Pika, VideoCrafter2, Text2Video‑Zero, ModelScope, Sora)과 자연 영상(DVSC2023) 각각 50,000개씩을 사용해 대규모 학습·평가를 수행했다. DINOv2를 사용했을 때 자연 영상과 AI 영상의 곡률 차이가 가장 크게 나타났으며(Δθ≈45°), 이는 다른 감독·자기지도 모델들보다 월등히 큰 신호를 제공한다. 또한, 절대적인 직선화 정도(모델 자체의 곡률 감소량)와 탐지 성능 사이에는 부정적인 상관관계가 없으며, 오히려 “상대적 직선화”—자연 영상은 더 직선화되고 AI 영상은 그렇지 않은 현상—가 핵심임을 확인했다.

성능 측면에서 ReStraV는 VidProM 벤치마크에서 97.17% 정확도와 98.63% AUROC를 기록했으며, 기존 이미지 기반 탐지기(CNNSpot, Gram‑Net 등)와 최신 비디오 기반 탐지기(TimeSformer, DeMamba 등)를 모두 능가한다. 연산 효율성도 뛰어나, DINOv2 전방 패스와 특징 추출·분류까지 전체 파이프라인이 약 48 ms(단일 GPU) 내에 처리된다. 이는 대규모 실시간 모니터링 시스템에 적용하기에 충분히 가볍다.

한계점으로는 현재 2초 짧은 클립에 최적화돼 있어 긴 영상이나 복잡한 장면 전환이 많은 경우 성능 변동이 있을 수 있다. 또한 DINOv2 자체가 자연 이미지에 최적화돼 있기 때문에, 향후 비디오‑특화 자기지도 모델이나 멀티모달 프레임워크와 결합하면 더욱 강력한 탐지기가 될 가능성이 있다.

전반적으로 ReStraV는 신경과학적 직관을 딥러닝에 성공적으로 매핑함으로써, 복잡한 시각적 위조를 탐지하는 새로운 차원의 기하학적 신호를 제공한다는 점에서 학술적·실용적 의의가 크다.

댓글 및 학술 토론

Loading comments...

의견 남기기