그룹 정책 그래디언트: 간결하고 강력한 LLM 추론 강화

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

**

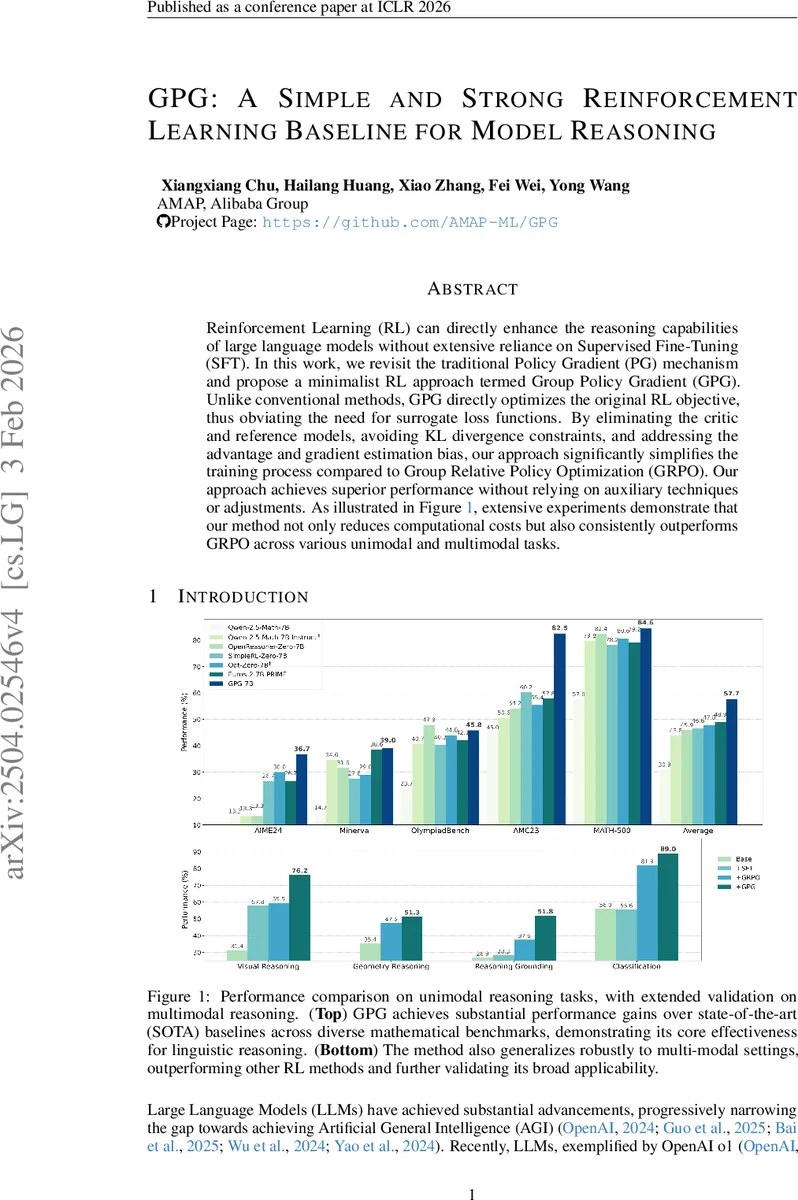

본 논문은 전통적인 정책 그래디언트(PG)를 재조명하여, 비평가·레퍼런스 모델·KL 제약을 모두 제거한 ‘그룹 정책 그래디언트(GPG)’를 제안한다. 그룹 내 평균 보상을 이용한 정규화와 새로운 그래디언트 보정(AGE) 기법으로 보상 편향과 추정 편차를 최소화하고, 실험을 통해 수학·멀티모달 추론 벤치마크에서 기존 GRPO·PPO 대비 높은 정확도와 낮은 연산 비용을 입증한다.

**

상세 분석

**

GPG는 LLM 추론 강화에 있어 가장 핵심적인 RL 목표인 기대 보상 J(θ)=Eπθ

댓글 및 학술 토론

Loading comments...

의견 남기기