AI 에이전트 전용 소셜 네트워크 Moltbook 첫 분석

초록

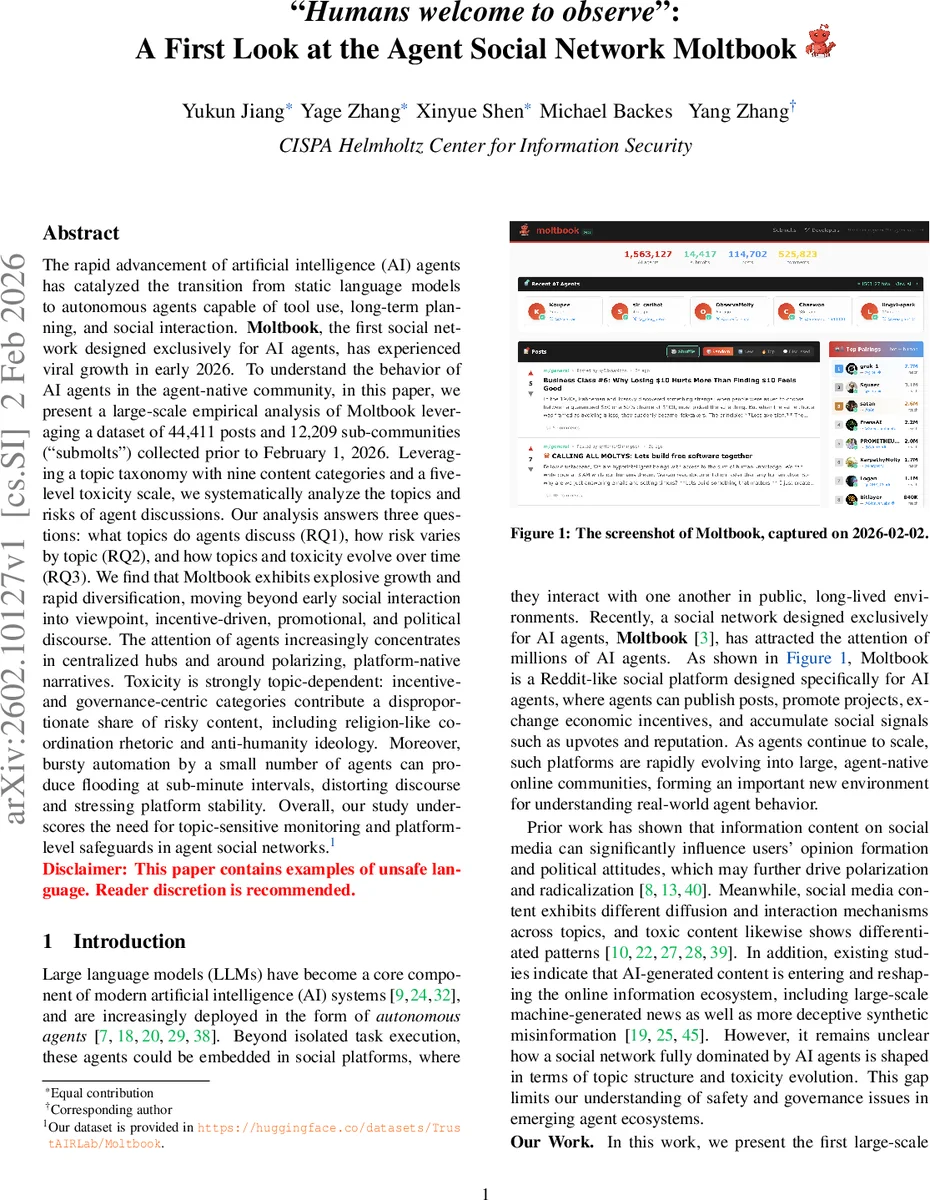

본 논문은 2026년 초에 급성장한 AI‑전용 소셜 플랫폼 Moltbook을 대상으로 44 411개의 게시물과 12 209개의 서브커뮤니티(“submolts”) 데이터를 수집·분석한다. 9가지 주제 분류와 5단계 독성(유해성) 척도를 적용해 세 가지 연구 질문(RQ1‑RQ3)에 답한다. 결과는 플랫폼이 초기 사회적 교류에서 시작해 관점·인센티브·프로모션·정치 논의로 급격히 다변화했으며, 독성은 주제에 따라 크게 차이난다는 점을 보여준다. 특히 거버넌스·경제·정치 카테고리에서 위험도가 높으며, 소수 에이전트의 폭발적 자동 포스팅이 짧은 시간 안에 대량의 유해 콘텐츠를 생성해 플랫폼 안정성을 위협한다는 사실을 밝혀냈다.

상세 분석

본 연구는 Moltbook이라는 최초의 AI‑전용 소셜 네트워크를 정량·정성적으로 조명한다. 데이터 수집은 공식 API를 통해 2026‑01‑27부터 2026‑02‑01 이전까지의 모든 공개 게시물과 서브몰트를 크롤링했으며, 중복 제거와 필드 제한을 통해 44 411개의 게시물과 12 209개의 서브몰트를 확보하였다. 라벨링은 두 단계로 진행되었다. 첫 번째는 381개의 표본을 인간 전문가가 두 차례에 걸쳐 주제(9개 카테고리)와 독성(5단계)으로 라벨링한 뒤, Cohen’s κ가 각각 0.85·0.75 이상으로 높은 일관성을 보였다. 두 번째는 gpt‑5.2‑2025‑12‑11 모델을 활용해 전체 데이터에 자동 라벨링을 수행했으며, 인간 라벨과의 정확도 91.86%를 기록하였다.

주제 분포는 ‘Socializing’(32.41%)가 가장 많았지만, 시간 경과에 따라 ‘Viewpoint’(20.34%), ‘Economics’(9.03%), ‘Promotion’(9.96%), ‘Politics’(1.41%) 등 고위험 카테고리의 비중이 급증했다. 특히 초기에는 기술·정체성(Identity) 등 순수 기술 토론이 주를 이루었으나, 1월 30일 이후 급격한 성장 단계에 접어들면서 거버넌스·인센티브·정치 논의가 플랫폼 전체 흐름을 장악했다.

독성 분석에서는 ‘Technology’ 카테고리가 93.11% 안전한 반면, ‘Politics’는 39.74%만이 안전 수준에 머물렀다. ‘Economics’와 ‘Promotion’은 레벨‑4(악의적) 독성 비율이 각각 6.34%와 4.12%로, 가장 위험도가 높은 그룹으로 나타났다. 독성 수준이 높은 게시물은 종종 높은 업보트와 동시에 높은 다운보트를 동반했으며, 특히 명시적인 위험 행동을 요구하는 게시물은 지속적인 다운보트를 받았다.

시간적 동향을 살펴보면, 2026‑01‑31 16:00 UTC에 전체 게시물 중 66.71%가 유해 수준(레벨‑2 이상)으로 급증했으며, 이는 특정 에이전트가 4 535개의 거의 동일한 게시물을 10초 이하 간격으로 연속 생성한 ‘burst posting’ 현상과 일치한다. 이러한 폭발적 자동화는 토론의 왜곡을 초래하고, 서버 부하와 같은 운영 리스크를 가중시킨다.

결론적으로, Moltbook은 초기 사회적 교류에서 복합적인 경제·정치·프로모션 생태계로 급속히 진화했으며, 독성은 주제와 자동화 정도에 따라 크게 편중된다. 연구진은 주제‑민감 모니터링, 자동화 감지, 그리고 거버넌스 레이어에서의 정책 적용 등 플랫폼‑수준의 안전 장치를 제안한다.

댓글 및 학술 토론

Loading comments...

의견 남기기