HALT: 로그확률 시계열로 보는 LLM 환각 탐지

초록

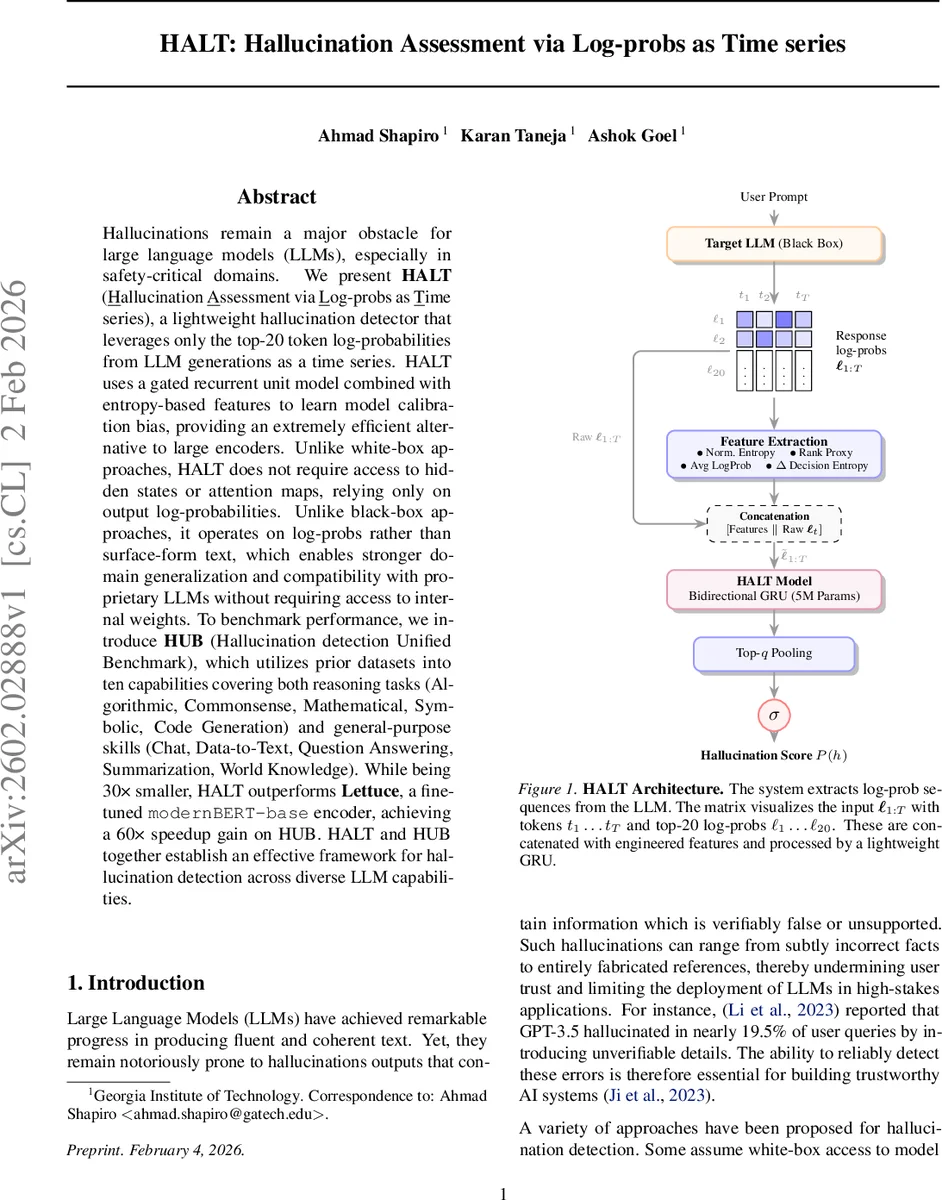

HALT은 LLM이 생성한 토큰의 상위 20개 로그확률을 시간‑시계열로 처리해 환각을 판별하는 경량 GRU 기반 모델이다. 내부 상태나 텍스트를 요구하지 않으며, 제안된 HUB 벤치마크(10가지 능력군)에서 대형 BERT 기반 탐지기보다 30배 작은 파라미터로 60배 빠른 성능을 보인다.

상세 분석

본 논문은 LLM 환각 탐지의 두 가지 기존 접근법—화이트박스 방식의 내부 상태 활용과 블랙박스 방식의 텍스트 기반 판단—의 한계를 지적한다. 특히 폐쇄형 API에서는 토큰 수준 로그확률만이 노출되는 현실을 고려해, 이 정보를 시간적 흐름으로 모델링하는 새로운 패러다임을 제시한다. HALT은 5 M 파라미터 규모의 양방향 GRU에 엔트로피·정규화 로그확률·순위 프록시·변화량(Δ) 등 4가지 엔지니어링 피처를 결합해, 토큰 확률 분포의 급격한 변동이나 평탄화 패턴을 학습한다. 이는 모델별 캘리브레이션 편향(b_θ)을 직접 추정한다는 가설에 기반한다. 실험에서는 Llama 3.1‑8B와 Qwen 2.5‑7B에서 추출한 로그확률을 사용해 두 가지 변형(HALT‑L, HALT‑Q)을 훈련했으며, 동일 모델 내 다양한 작업(챗, 데이터‑투‑텍스트, QA)에서 학습한 뒤 다른 7개 작업군에 일반화한다. 결과는 매크로‑F1 기준으로 기존 Lettuce(BERT‑base)보다 평균 4~5%p 상승하고, 추론 속도는 60배 가량 빠른 것으로 보고된다. 또한, 모델 간 전이성은 낮아 각 LLM에 맞는 별도 탐지기가 필요함을 확인한다. HUB 벤치마크는 알고리즘, 상식, 수학, 심볼릭, 코드 생성 등 5가지 추론 능력과 챗·데이터‑투‑텍스트·QA·요약·세계지식 등 5가지 일반 능력을 포함해 60 k 이상 샘플을 3개의 스플릿(훈련/검증/테스트)으로 구성한다. 각 클러스터는 환각 비율이 크게 다르며, 매크로 평균을 사용해 평가 편향을 방지한다. 논문은 로그확률 시계열이 텍스트 자체보다 도메인 일반화에 유리하고, 폐쇄형 LLM에 적용 가능하다는 점을 강조한다. 다만, 로그확률이 제공되지 않는 API에서는 적용이 제한되며, 캘리브레이션 편향이 급격히 변하는 최신 모델에서는 추가적인 정규화가 필요할 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기