출력 길이 예산을 활용한 차세대 LLM 라우팅

초록

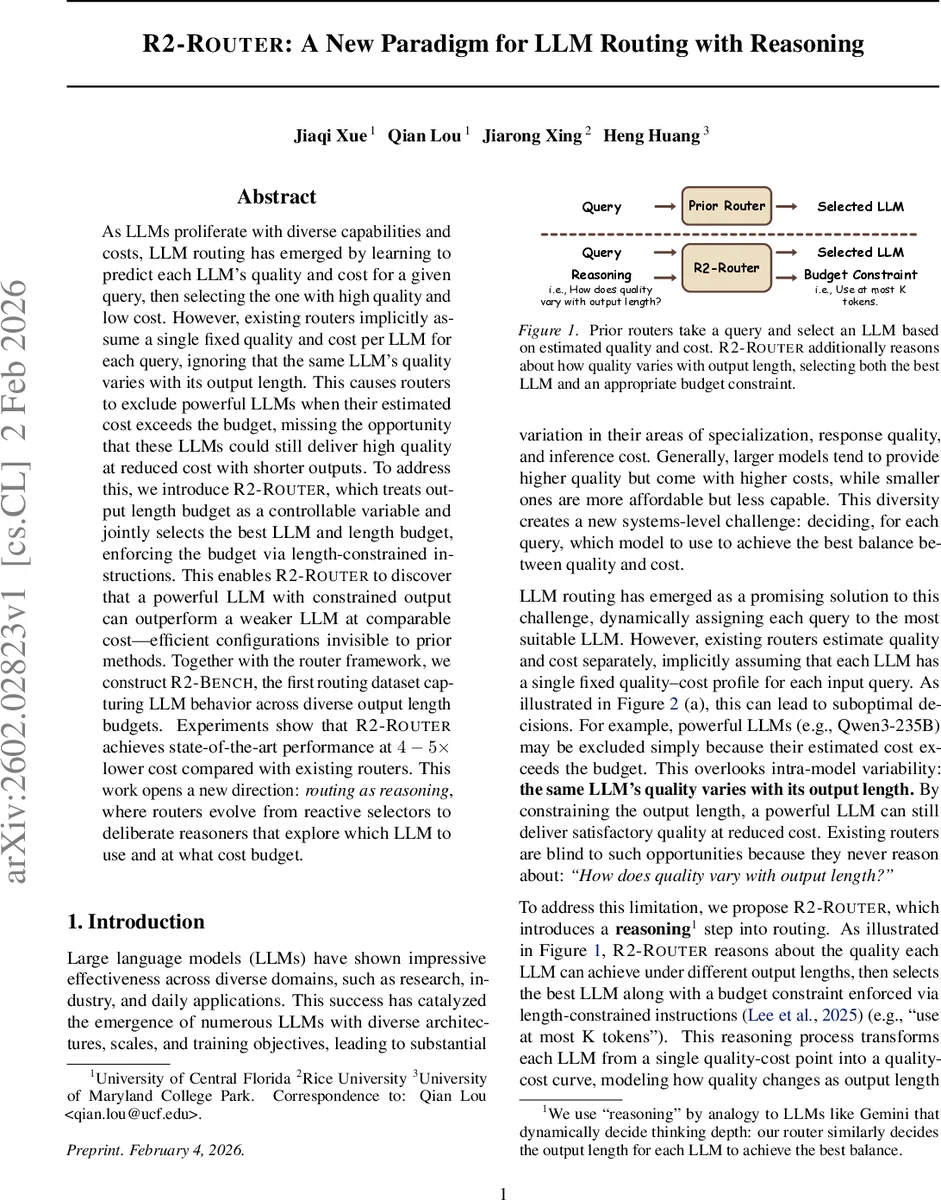

본 논문은 기존 라우터가 모델별 고정된 품질·비용을 가정하는 한계를 극복하고, 출력 토큰 길이를 조절 가능한 변수로 삼아 최적의 모델과 길이 예산을 동시에 선택하는 R2‑Router를 제안한다. 이를 위해 다양한 길이 예산에서 모델 응답을 수집한 R2‑Bench 데이터를 구축하고, 품질‑비용 곡선을 학습해 4~5배 낮은 비용으로 기존 라우터 수준의 품질을 달성한다.

상세 분석

R2‑Router는 라우팅 문제를 “반응형”에서 “추론형”으로 전환한다는 점에서 혁신적이다. 기존 라우터는 각 모델에 대해 단일 품질‑비용 점을 예측하고, 예산 초과 시 해당 모델을 배제한다. 그러나 LLM의 출력 품질은 토큰 수에 따라 비선형적으로 변한다는 사실을 간과한다. R2‑Router는 토큰 예산 집합 B 를 정의하고, 각 모델 M 에 대해 Q(x,M,b) 와 C(b) 를 함수 형태로 예측한다. 이를 통해 (모델, 토큰 예산) 쌍을 탐색하는 최적화 문제 (1) 을 설정하고, “Optimization Dominance” 정리를 통해 탐색 공간이 확대되면 최소 성능은 기존 방법을 능가함을 이론적으로 보인다.

핵심 구현은 세 단계로 구성된다. 첫째, 품질‑비용 예측기(Q‑C Predictor)를 학습해 다양한 b 값에 대한 Q̂ 와 Ĉ 를 추정한다. 여기서 Ĉ 는 토큰 수와 모델당 토큰당 비용의 곱으로 계산된다. 둘째, 예산 제약을 명시적으로 전달하는 “use at most K tokens” 프롬프트를 활용해 실제 모델 호출 시 길이를 강제한다. 셋째, 예측된 Q̂ 와 Ĉ 를 기반으로 사용자 정의 λ에 따라 스코어 S = (1‑λ)·Q̂‑λ·Ĉ 를 최대화하는 (M,b) 쌍을 선택한다.

데이터 측면에서 R2‑Bench은 6개 벤치마크(예: GPQA, MMLU‑Pro 등)와 15개 오픈소스 LLM을 사용해 각 쿼리‑모델 조합에 대해 6가지 토큰 예산을 적용, 총 수십만 개의 응답을 수집한다. 품질 평가는 인간 라벨링과 LLM‑as‑judge(선정된 Qwen3‑80B‑Instruct) 방식을 결합해 Pearson 0.82의 상관성을 확보하였다. 이러한 곡선형 데이터는 기존 단일‑응답 데이터와 달리 Oracle이 (모델, 예산) 전역에서 최적 선택을 할 수 있게 하여, AU‑DC가 0.85→0.98으로 크게 상승한다.

실험 결과 R2‑Router는 UniRouter와 같은 최신 라우터에 플러그인 형태로 통합될 수 있으며, 새로운 모델이 추가될 때도 5% 수준의 AU‑DC 향상과 비용 80% 감소를 달성한다. 또한, 6개의 앵커 예산만으로 연속적인 품질‑비용 곡선을 근사해 20분 내 GPU 한 대에서 학습·추론이 가능해 데이터·연산 효율성도 뛰어나다.

요약하면, R2‑Router는 출력 길이라는 조절 가능한 차원을 도입해 라우팅을 “추론” 문제로 재정의하고, 이를 뒷받침하는 R2‑Bench 데이터셋을 제공함으로써 비용 효율성을 크게 향상시키는 동시에 라우팅 시스템을 보다 유연하고 확장 가능하게 만든다.

댓글 및 학술 토론

Loading comments...

의견 남기기