시간 시계열 예측을 위한 자동회귀 최적화 기법

초록

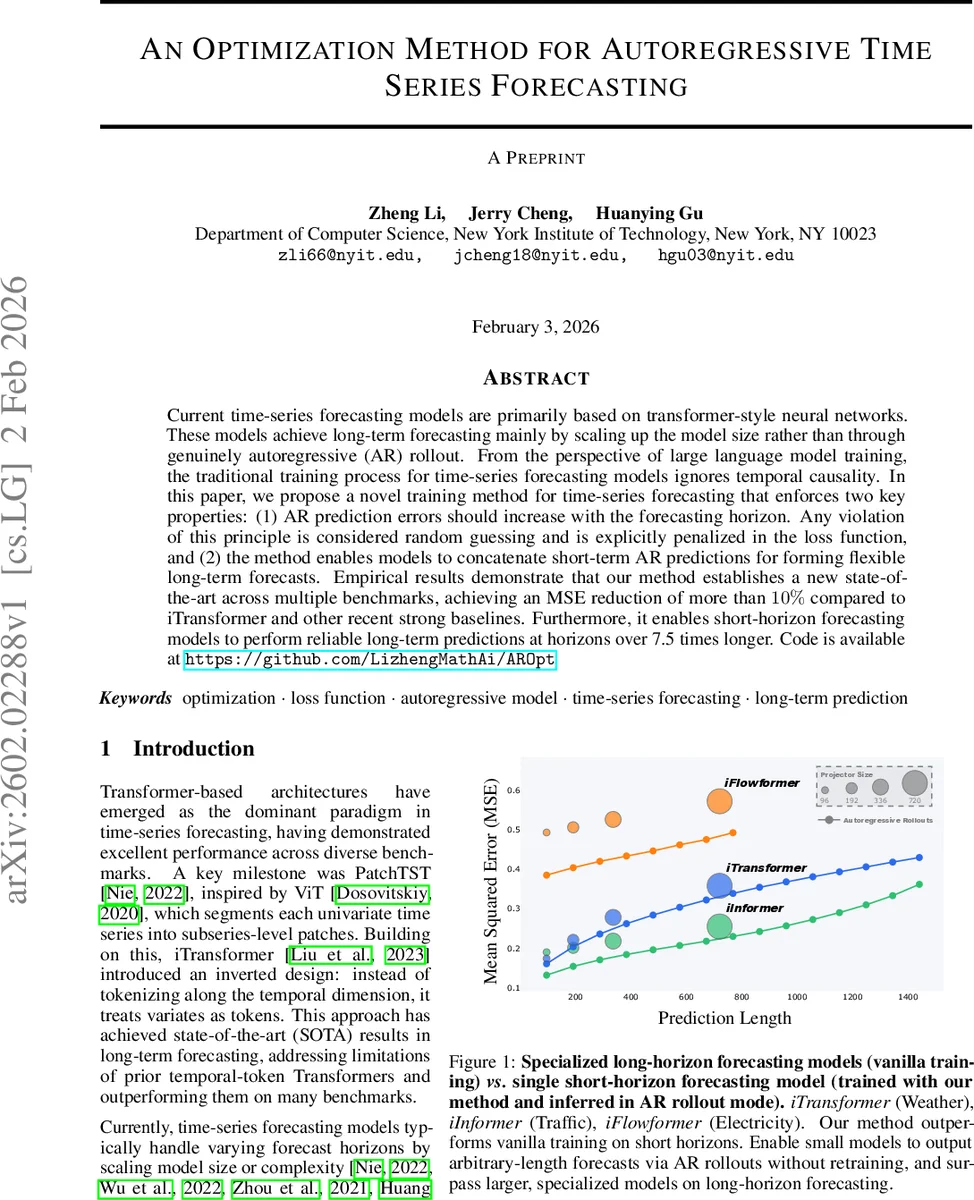

본 논문은 시계열 예측 모델이 장기 예측 시 발생하는 오류 누적 문제를 해결하고자, 예측 오차가 시간에 따라 단조 증가하도록 강제하는 새로운 손실 함수를 제안한다. 짧은 시계열 예측 모델을 자동회귀(AR) 롤아웃 방식으로 연결해 임의 길이의 장기 예측을 수행할 수 있게 하며, iTransformer 등 기존 최첨단 모델 대비 10% 이상 MSE를 감소시킨다. 코드와 데이터는 공개되어 재현 가능성을 확보하였다.

상세 분석

이 논문은 현재 시계열 예측 분야에서 Transformer 기반 모델이 “스케일 업”에 의존해 장기 예측 성능을 끌어올리는 한계를 지적한다. 특히, 전통적인 학습 방식은 입력‑출력 윈도우가 겹치거나, 출력이 입력 뒤 바로 이어지는 구조라서 시간적 인과관계(temporal causality)를 충분히 반영하지 못한다. 저자들은 두 가지 핵심 원칙을 손실 함수에 명시한다. 첫째, 자동회귀(AR) 롤아웃 시 예측 오차는 예측 시점이 멀어질수록 반드시 증가해야 하며, 이를 위반하면 ‘무작위 추측(random guessing)’으로 간주해 패널티를 부여한다. 둘째, 짧은 시계열 모델이 만든 여러 단계의 AR 예측을 순차적으로 연결(concatenate)함으로써 임의 길이의 장기 예측을 구현한다.

구현 측면에서는 Algorithm 1에 제시된 바와 같이, 기본 모델 f(·;θ)를 사용해 첫 번째 T‑step 예측을 만든 뒤, 그 출력을 다음 입력으로 재사용해 k‑step까지 롤아웃한다. 각 단계 k에서 얻은 MSE e_k에 대해 할인 계수 γ와 스무딩 가중치 β를 적용해 손실 ℓ = Σ_{k=0}^{n-1} γ^k

댓글 및 학술 토론

Loading comments...

의견 남기기