LLM 양자화를 위한 벡터화 적응 라운딩 VQRound

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

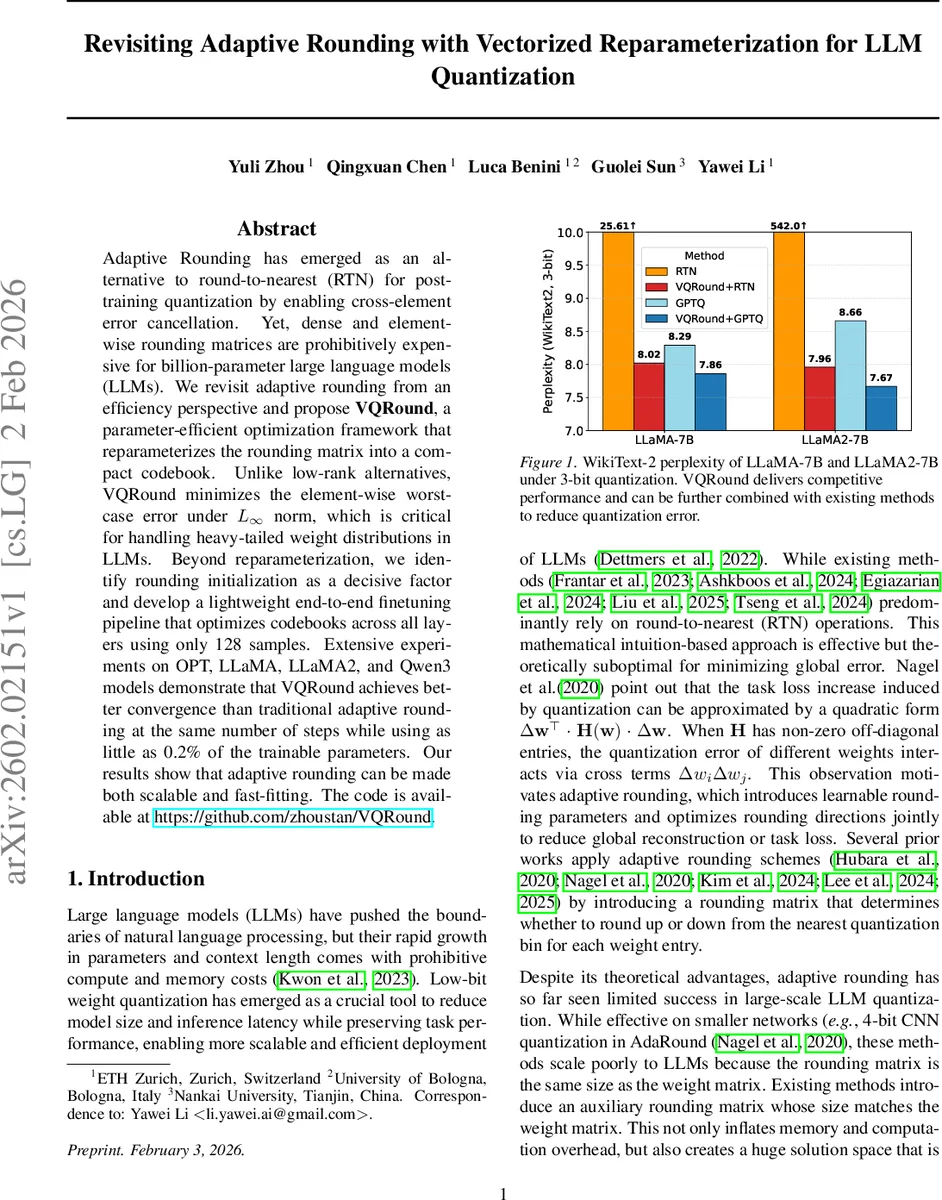

VQRound는 라운딩 행렬을 작은 코드북으로 재파라미터화해 파라미터를 0.2% 수준으로 축소하고, L∞ 최악‑오차를 최소화한다. 초기화 전략을 개선하고 128개의 캘리브레이션 샘플만으로 전층(end‑to‑end) 미세조정을 수행해 기존 AdaRound보다 빠르게 수렴한다. OPT, LLaMA, LLaMA2, Qwen3 등 다양한 LLM에 적용해 3‑bit 양자화에서 퍼플렉시티를 크게 낮추었다.

상세 분석

본 논문은 대규모 언어 모델(LLM) 양자화에서 기존 적응 라운딩(Adaptive Rounding, AdaRound)의 메모리·연산 비용이 모델 크기와 비례해 급격히 증가한다는 근본적인 한계를 짚는다. 라운딩 행렬 H∈

댓글 및 학술 토론

Loading comments...

의견 남기기