자기 검증으로 허위 감소: VeriFY 프레임워크

초록

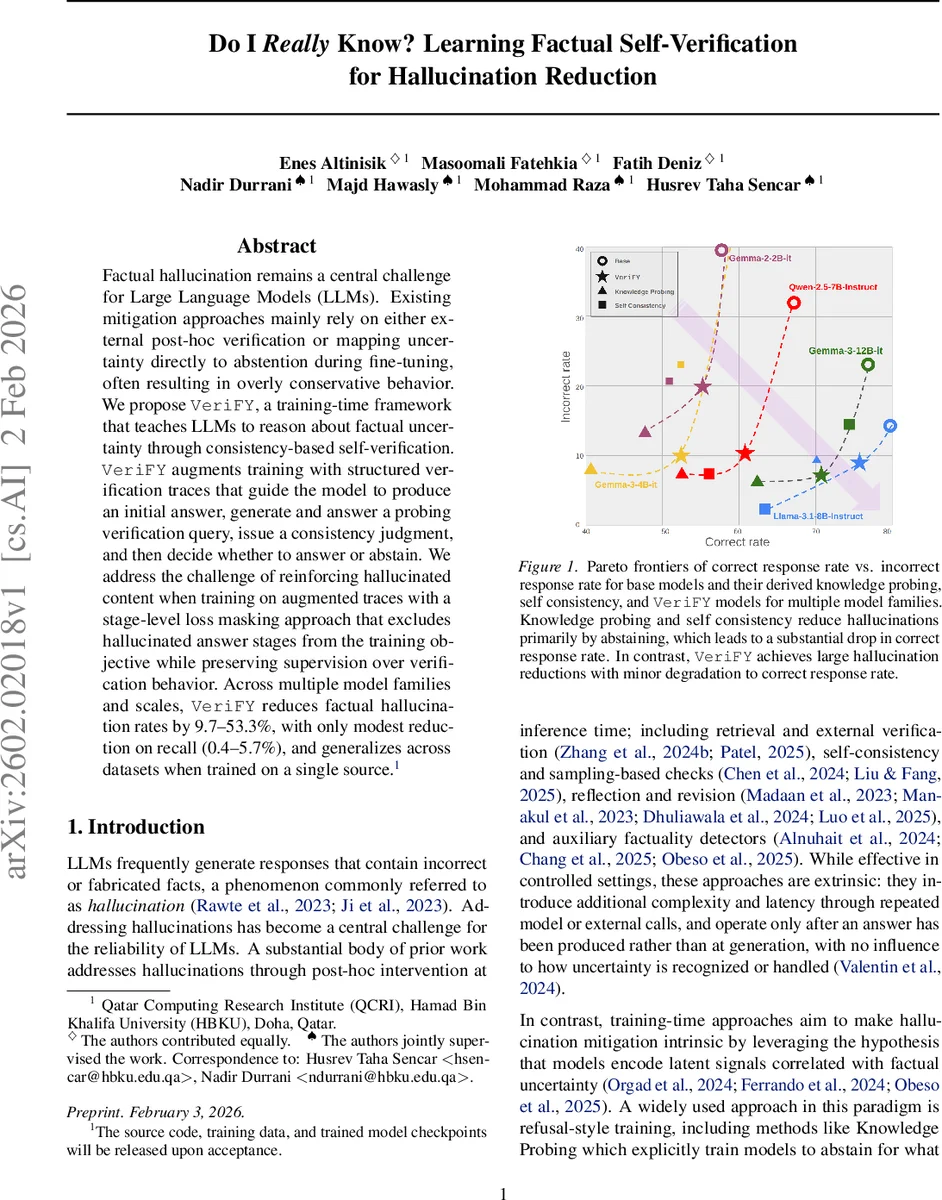

VeriFY는 학습 단계에서 모델이 자체적으로 답변의 사실성을 검증하도록 훈련시키는 방법이다. 초기 답변 → 검증 질문 생성 → 검증 답변 → 재답변 → 일관성 판단이라는 5단계 검증 트레이스를 도입하고, 허위가 포함된 단계는 손실 마스킹으로 제외한다. 이를 통해 다양한 모델 규모에서 hallucination 비율을 9.7%‑53.3% 감소시키면서 정답 커버리지는 0.4%‑5.7%만 감소시켰다. 또한 기존 정확도·재현율 대신 ‘Hallucination F1’이라는 정밀·재현율 기반 평가 지표를 제안한다.

상세 분석

VeriFY는 기존의 사후 검증(post‑hoc)과 학습 시 불확실성 매핑(abstention) 접근법의 장점을 결합한다. 핵심 아이디어는 “self‑verification trace”를 학습 데이터에 삽입해 모델이 스스로 사실성을 재평가하도록 하는 것이다. 하나의 질문 q에 대해 (i) 초기 답변 a₀을 생성하고, (ii) 더 능력 있는 모델이 a₀를 기반으로 의미 변형(재표현, 논리적 함의, 시간 변형 등)된 검증 질문 qᵥ를 만든다. (iii) 모델은 qᵥ에 대해 독립적인 검증 답변 aᵥ를 생성한다. (iv) qᵥ‑aᵥ 쌍을 컨텍스트에 넣어 원 질문에 대한 재답변 a₁을 만든 뒤, (v) a₀와 a₁의 일관성을 판단하는 판단 r을 출력한다. 최종적으로 r이 “일관”이면 a₁을, “불일관”이면 abstain을 선택한다.

핵심 문제는 트레이스 내에 허위 내용이 포함될 경우 이를 그대로 학습하면 모델이 잘못된 사실을 강화할 위험이 있다는 점이다. 이를 해결하기 위해 단계‑레벨 손실 마스킹을 도입한다. 각 단계 sⱼ에 대해 허위 여부 Hⱼ∈{0,1}을 라벨링하고, Hⱼ=1인 단계는 손실 계산에서 제외한다(Minimal Masking, MM). 검증 질문·판단 단계는 허위와 무관하므로 그대로 학습한다. 두 번째 전략인 Span Masking은 마지막 허위 단계 이후의 모든 단계만 학습에 사용한다. 실험에서는 MM이 가장 좋은 성능을 보였다.

평가 지표는 기존의 단순 정확도가 abstention을 무시한다는 한계를 인식하고, “Hallucination F1”이라는 정밀·재현율 기반 지표를 설계했다. 모델이 “알고 있다(답변)”고 판단했을 때 정답 비율을 Precision, 실제 알 수 있는 질문 중 답변을 선택한 비율을 Recall로 정의하고, 이들의 조화 평균을 F1으로 산출한다. 이를 통해 불필요한 abstain(불필요한 회피)과 허위 답변 사이의 트레이드오프를 정량화한다.

실험은 트리비아QA를 기본 데이터로 사용해 87k 질문에 대해 검증 트레이스를 생성했으며, Llama‑2, Falcon, Mistral 등 여러 모델 패밀리와 7B‑70B 규모에서 fine‑tuning을 수행했다. 결과는 VeriFY가 Knowledge‑Probing이나 Self‑Consistency와 비교해 동일하거나 더 높은 Precision을 유지하면서 Recall 손실을 최소화함을 보여준다. 특히 13B 모델에서는 hallucination 비율을 53.3% 감소시켰으며, 정답 커버리지는 4.2%만 감소했다. 교차 데이터셋(HotpotQA, NQ‑Open, FreshQA)에서도 단일 소스 트레이닝만으로 일반화가 확인되었다.

한계점으로는 (1) 검증 질문을 생성하는 데 더 강력한 모델이 필요하다는 점, (2) 현재는 사실형 질문에만 적용했으며 복합 추론이나 다중 문맥이 필요한 상황에선 추가 연구가 필요함을 들 수 있다. 또한 손실 마스킹을 위한 허위 라벨링이 자동화되기 어려워 인간 판정에 의존한다는 점도 개선 과제로 남는다.

전반적으로 VeriFY는 “학습 시 자체 검증”이라는 새로운 패러다임을 제시하며, 외부 호출 없이도 LLM의 사실성 신뢰도를 크게 향상시킬 수 있음을 실증한다.

댓글 및 학술 토론

Loading comments...

의견 남기기