데이터 분포가 컨텍스트 압축에 미치는 영향

초록

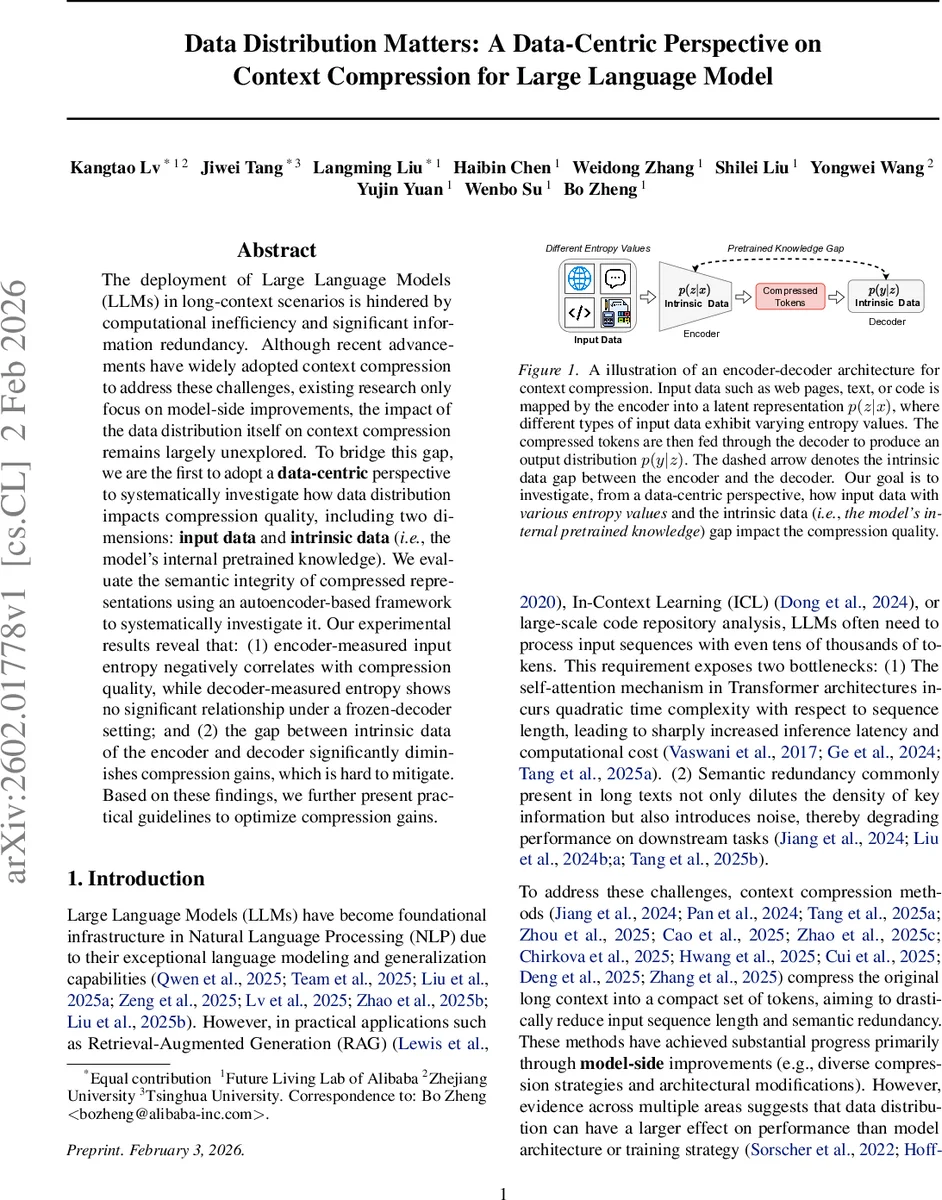

본 논문은 대규모 언어 모델(LLM)의 긴 컨텍스트 압축에서 데이터 자체의 분포가 압축 품질에 미치는 영향을 데이터 중심적으로 조사한다. 입력 데이터의 엔트로피와 인코더·디코더 간 내재 데이터 차이를 정량화하고, 자동인코더 프레임워크를 통해 압축 후 재구성 품질을 평가한다. 실험 결과, 인코더가 측정한 입력 엔트로피는 압축 품질과 부정적 상관관계를 보이며, 디코더의 엔트로피는 큰 영향을 주지 않는다. 또한 인코더와 디코더의 내재 데이터 격차가 클수록 압축 이득이 크게 감소한다는 점을 발견한다. 이를 바탕으로 실용적인 압축 최적화 가이드라인을 제시한다.

상세 분석

이 연구는 기존 컨텍스트 압축 연구가 모델 구조·학습 전략에만 초점을 맞춘 반면, 데이터 자체의 특성이 압축 성능에 미치는 영향을 체계적으로 탐구한다는 점에서 독창적이다. 저자는 입력 데이터와 모델 내부의 ‘내재 데이터’를 두 축으로 정의하고, 각각을 정량화하기 위해 Shannon 엔트로피와 사전 학습 코퍼스의 도메인 차이를 활용한다. 자동인코더(AE) 기반 실험 설계는 인코더가 입력을 잠재 벡터(z)로 압축하고, 고정된 디코더가 이를 재구성하는 과정을 통해 압축 품질을 직접 측정한다. 이때 재구성 손실(L_AE)과 BLEU, ROUGE‑L, F1 등 다중 메트릭을 사용해 의미적 완전성을 평가한다.

실험에서는 6개의 데이터셋(D1~D6)을 구성해 일반 웹 텍스트와 수학·코드·아카이브 등 고엔트로피 도메인을 혼합한 비율을 단계적으로 증가시켰다. 인코더와 디코더는 각각 서로 다른 데이터셋에서 독립적으로 사전 학습되었으며, 디코더는 파인튜닝 단계에서 고정돼 인코더의 적응 능력만을 테스트한다. 결과는 두 가지 핵심 인사이트를 제공한다. 첫째, 인코더가 측정한 입력 엔트로피가 높을수록 압축 후 재구성 품질이 낮아지는 강한 부정적 상관관계가 나타났다. 이는 고엔트로피 텍스트가 더 많은 정보를 담고 있어 압축 과정에서 손실이 커짐을 의미한다. 반면 디코더가 측정한 엔트로피는 압축 품질과 유의미한 상관을 보이지 않았으며, 이는 디코더가 사전 학습된 내부 지식에 크게 의존해 입력 분포가 달라져도 일정 수준의 복원 능력을 유지한다는 점을 시사한다.

둘째, 인코더와 디코더 간 내재 데이터 격차가 클수록 압축 이득이 급격히 감소한다. 구체적으로, 일반 텍스트 전용 인코더와 코드 전용 디코더를 조합했을 때 BLEU 점수가 20% 이상 하락하는 등 재구성 정확도가 크게 떨어졌다. 이는 디코더의 사전 지식이 입력 도메인과 맞지 않을 때, 압축된 잠재 표현을 올바르게 해석하지 못함을 의미한다. 저자는 이러한 현상이 ‘디코더 중심의 병목’이라고 명명하고, 압축 시스템 설계 시 디코더의 데이터 정합성을 우선 고려해야 함을 강조한다.

이러한 분석을 바탕으로 저자는 (1) 입력 데이터의 엔트로피를 사전에 측정해 압축 비율을 동적으로 조정하고, (2) 인코더·디코더 간 데이터 정합성을 확보하기 위해 동일 도메인에서 사전 학습하거나, (3) 디코더를 다중 도메인에 맞게 파인튜닝하는 전략을 제안한다. 전체적으로 데이터 분포가 압축 성능에 미치는 영향을 정량화함으로써, 모델‑중심 접근만으로는 설명되지 않았던 성능 변동성을 해소하고, 실제 서비스 환경에서 보다 안정적인 컨텍스트 압축을 구현할 수 있는 실용적 로드맵을 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기